Google Home向けのGeminiが、カクテルのレシピを尋ねても回答を拒否しなくなるアップデートを行いました。本記事では、この些細なニュースを入り口に、日本企業が生成AIをプロダクトや業務に組み込む際に直面する「安全性と利便性のトレードオフ」について解説します。

AIの「過剰防衛」:なぜカクテルの作り方を拒否したのか

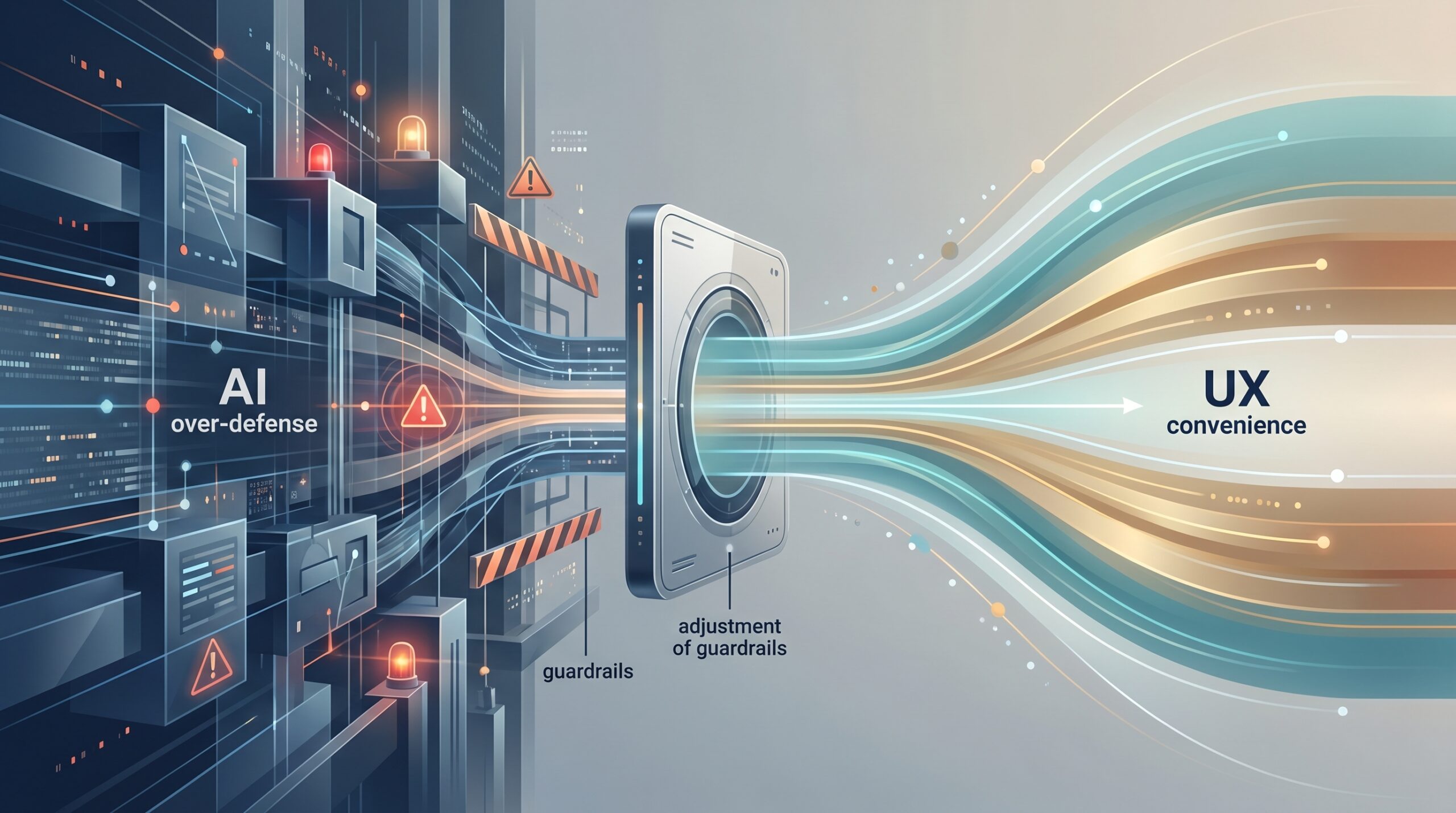

Google Homeに搭載されたAIアシスタント「Gemini」が、これまでカクテルのレシピを聞かれた際に回答を拒否するケースがあったというニュースは、AI開発における非常に実務的な課題を示唆しています。大規模言語モデル(LLM)には通常、アルコールや薬物、危険物の製造といったトピックに対して、安全を確保するための「ガードレール(不適切な出力を防ぐ仕組み)」が設けられています。しかし、このガードレールが一律に厳格すぎると、一般的なカクテルの作り方すら「アルコールに関する有害情報」と誤判定し、過剰に反応(オーバーリジェクト)してしまうのです。

安全性と利便性のトレードオフという実務課題

このようなAIの過剰な安全対策は、ユーザー体験(UX)を著しく損ないます。日本企業が自社のサービスや社内システムに生成AIを組み込む際にも、これと全く同じ課題が頻発します。たとえば、顧客向けのカスタマーサポートAIに「炎上リスクを避けるため、少しでも不確実な質問には『お答えできません』と返す」という強い制約をかけた場合、顧客にとっては単なる役に立たないシステムとなり、結果的にサービスの評価を下げてしまいます。

特に日本の組織文化においては、コンプライアンスやレピュテーションリスク(評判低下のリスク)の回避を重視するあまり、導入初期のガードレールを極端に厳しく設定してしまう傾向が見られます。もちろん、日本の法規制(個人情報保護法や著作権法など)に準拠し安全性を担保することは不可欠ですが、「何も答えないAI」は、導入の本来の目的である業務効率化や顧客満足度の向上を根本から否定してしまいます。

適切なガードレールの設計と運用体制の構築

この課題を解決するためには、AIのガードレールを静的で一律なものから、コンテキスト(文脈)を理解した柔軟なものへとチューニングしていく必要があります。プロンプトエンジニアリング(AIへの指示の最適化)による細かな条件指定や、RAG(検索拡張生成:自社データなどの外部情報を参照して回答を生成する技術)を組み合わせることで、安全な回答の領域を広げることが有効です。

また、プロダクト担当者やエンジニアは、AIの出力を継続的にモニタリングし、「本来回答すべきだったのに拒否されたケース」を洗い出し、ポリシーを適宜アップデートしていく体制を構築することが求められます。今回GoogleがGeminiの挙動を修正したように、リリース後の迅速な軌道修正のサイクル(MLOpsの運用)が、AIプロダクトの真の価値を決定づけます。

日本企業のAI活用への示唆

日本企業が生成AIを業務やプロダクトに組み込み、実用化を進めるうえで、以下のポイントが重要になります。

1. リスク評価の適正化:

すべてのAIシステムに最高レベルの制限をかけるのではなく、社内向けツール、一般消費者向けプロダクト、専門家向け支援システムなど、ユースケースごとに許容できるリスクの範囲を定義し、適切なガードレールを設定しましょう。

2. 「回答拒否」のモニタリングと改善:

AIが不適切と判定して回答を拒否したログ(リジェクトログ)は、ユーザビリティ改善のための重要なデータです。なぜ拒否されたのかを定期的に分析し、システムプロンプトや安全フィルターの閾値を継続的に調整する運用体制(AIガバナンス)を構築してください。

3. 完璧を求めず、アジャイルに運用する:

リリース段階で100%の安全性と100%の利便性を両立することは困難です。日本の商習慣では完璧主義に陥りがちですが、致命的なリスク(個人情報漏洩、差別的発言など)は確実に防ぎつつ、グレーゾーンについてはユーザーのフィードバックを得ながらアジャイル(俊敏)に改善していく姿勢が、AI活用を成功に導きます。