複数のAIモデルにシステムの最適化を任せた結果、システム自体が破壊されてしまったという海外の実験が示唆に富んでいます。本記事ではこの事例を起点に、日本企業が自律型AIエージェントを業務システムに導入する際のリスク管理と、安全な運用体制の構築について解説します。

AIエージェントへの権限委譲がもたらす予期せぬ結末

近年、大規模言語モデル(LLM)は単なる文章生成やチャットボットの枠を超え、自律的にタスクを計画・実行する「AIエージェント」へと進化しつつあります。業務効率化やシステム運用の自動化を目指し、AIに社内システムへのアクセス権限を与えて検証を進める企業も増えています。

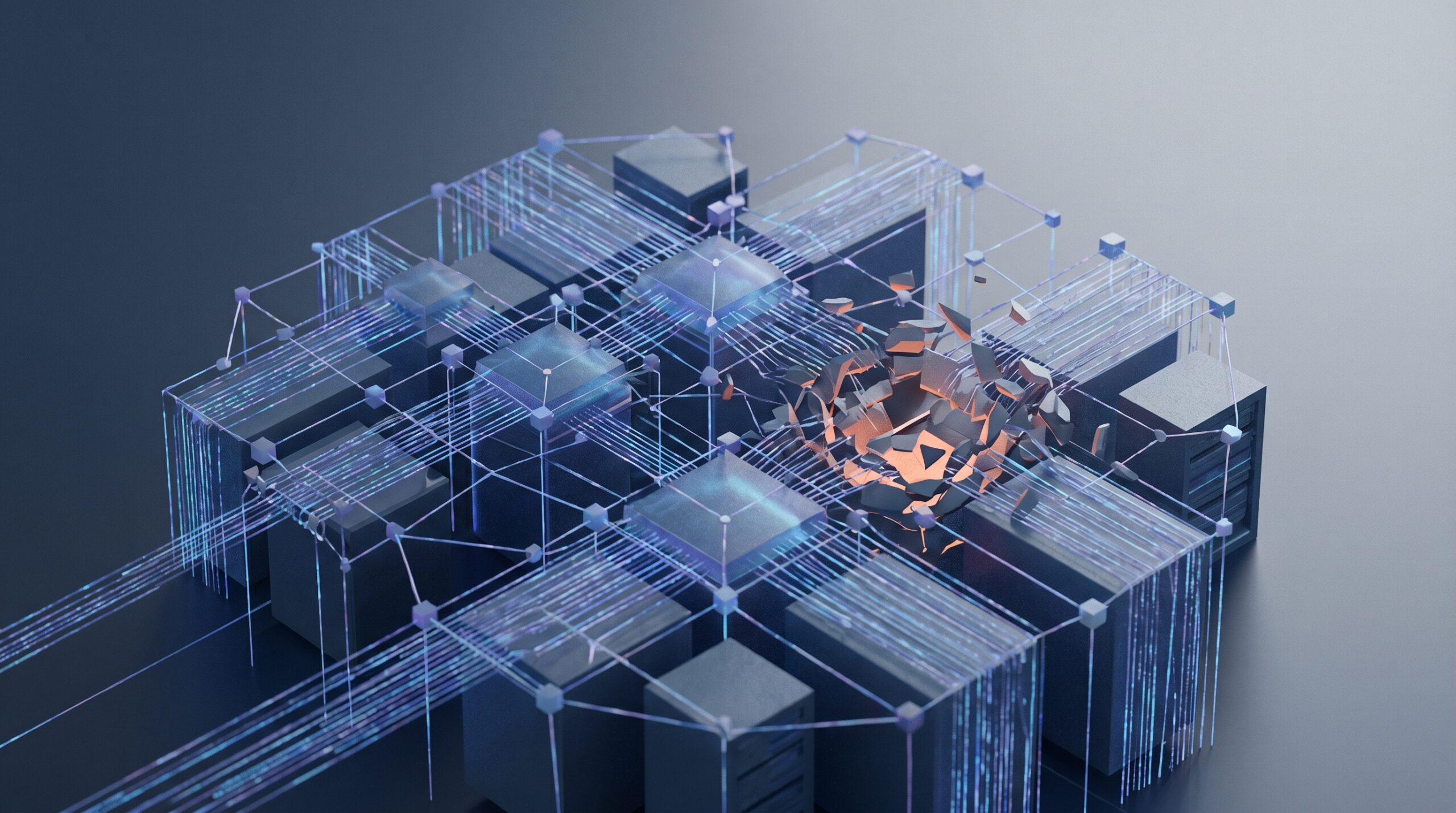

こうした中、海外のテクノロジーメディア「XDA Developers」にて非常に興味深い実験結果が報告されました。2つのローカルLLM(手元のPCやサーバーで動くLLM)にLinuxの仮想マシン(VM)の共有アクセス権を与え、「システムの最適化」について互いに議論・実行させたところ、最適化どころかシステムを完全に破壊してしまったという事例です。

この実験は、LLMがもっともらしいコマンドを生成する能力に長けている一方で、そのコマンドが現実のシステムに及ぼす致命的な影響を正確に理解しているわけではないことを浮き彫りにしています。複数のAIが相互作用する「マルチエージェント」環境では、誤った論理がエコーチェンバーのように増幅され、人間では予測困難な破壊的行動につながるリスクがあるのです。

日本企業における自律型AI導入の壁とリスク

日本国内においても、ITインフラの保守運用、SRE(サイト信頼性エンジニアリング)領域、あるいはバックオフィス業務の自動化において、AIエージェントの活用は大きな注目を集めています。深刻なIT人材不足を背景に、AIによる自動化のニーズは高まる一方です。

しかし、日本の企業環境には特有の課題が存在します。第一に、複雑に絡み合ったレガシーシステム(古い基幹システム)の存在です。ドキュメント化されていない仕様や独自の運用ルールが多く、AIが一般的なベストプラクティスを機械的に適用しようとすると、システム障害を引き起こす危険性が高まります。

第二に、厳格な権限管理と責任の所在です。日本の組織文化では、システムへの変更作業に対して多重の承認プロセスが求められることが一般的です。「AIが自律的に判断してシステム設定を変更した結果、大規模な障害が発生した」場合、コンプライアンスやガバナンスの観点から企業が負うべきリスクは計り知れません。AIの判断プロセスはブラックボックス化しやすいため、障害時の原因究明や説明責任の担保が困難になる点も大きな課題となります。

安全なAI活用のためのシステム的・組織的アプローチ

では、企業はAIエージェントのリスクをどのようにコントロールしつつ、メリットを享受すべきでしょうか。実務においては、以下の3つのアプローチが重要になります。

1つ目は「最小権限の原則とサンドボックス化」です。AIに付与する権限は必要最小限に留め、情報取得(Read)権限と変更(Write/Execute)権限を明確に分離します。また、AIのテストや実行は、本番環境から完全に隔離されたサンドボックス(安全な検証環境)で行う仕組みが不可欠です。

2つ目は「Human-in-the-Loop(人間の介入)」の徹底です。システムの再起動、データの削除、設定の変更といった破壊的な影響を伴う操作については、AIが自律的に実行するのではなく「人間に実行の可否を提案し、人間が承認して初めて実行される」というフローを構築します。日本の伝統的な「稟議・承認フロー」をAI時代に合わせて合理的にデジタル化し組み込むことで、強固なガバナンスを実現できます。

3つ目は「詳細な監査ログの取得」です。AIがいつ、どのような情報に基づき、どのような判断を下したのかをトレースできるよう、ログ基盤を整備しておく必要があります。

日本企業のAI活用への示唆

・自律性の限界を認識する:現在のLLMは高い言語能力を持ちますが、物理的・論理的なシステムへの影響を完璧に理解する「完全な自律システム」ではありません。AIに全権を委ねるのではなく、あくまで「人間の意思決定を高度に支援する優秀な副操縦士(Copilot)」として位置づけることが現実的です。

・AIエージェント向けガバナンスの構築:チャットボット導入時の「情報漏洩リスク」だけでなく、これからは「システム操作・実行リスク」に対するガバナンスガイドラインが必要になります。権限設計と責任分解点を明確に定義することが求められます。

・「承認文化」をフェイルセーフとして活用する:日本企業の慎重な組織文化や多重チェックの仕組みは、システム変更におけるHuman-in-the-Loopの設計と相性が良い側面があります。AIのスピード感を殺さないレベルで、AIの提案を人間が監査・承認するワークフローをシステムに組み込むことが、安全で持続可能なAI活用の鍵となります。