大規模言語モデル(LLM)の実業務への導入が進む中、推論時のインフラコストとメモリ消費が大きな課題となっています。本記事では、注目を集める「KVキャッシュ圧縮」の技術動向を紐解き、日本企業が自社専用環境でAIを低コストかつ安全に活用するためのポイントを解説します。

LLM運用における「見えないコスト」とKVキャッシュ

大規模言語モデル(LLM)を自社のプロダクトや業務システムに組み込む企業が増加する一方で、運用フェーズにおいて想定以上のインフラコストに直面するケースが少なくありません。その大きな要因の一つが、AIがテキストを生成(推論)する際に消費するGPUメモリ(VRAM)の容量です。

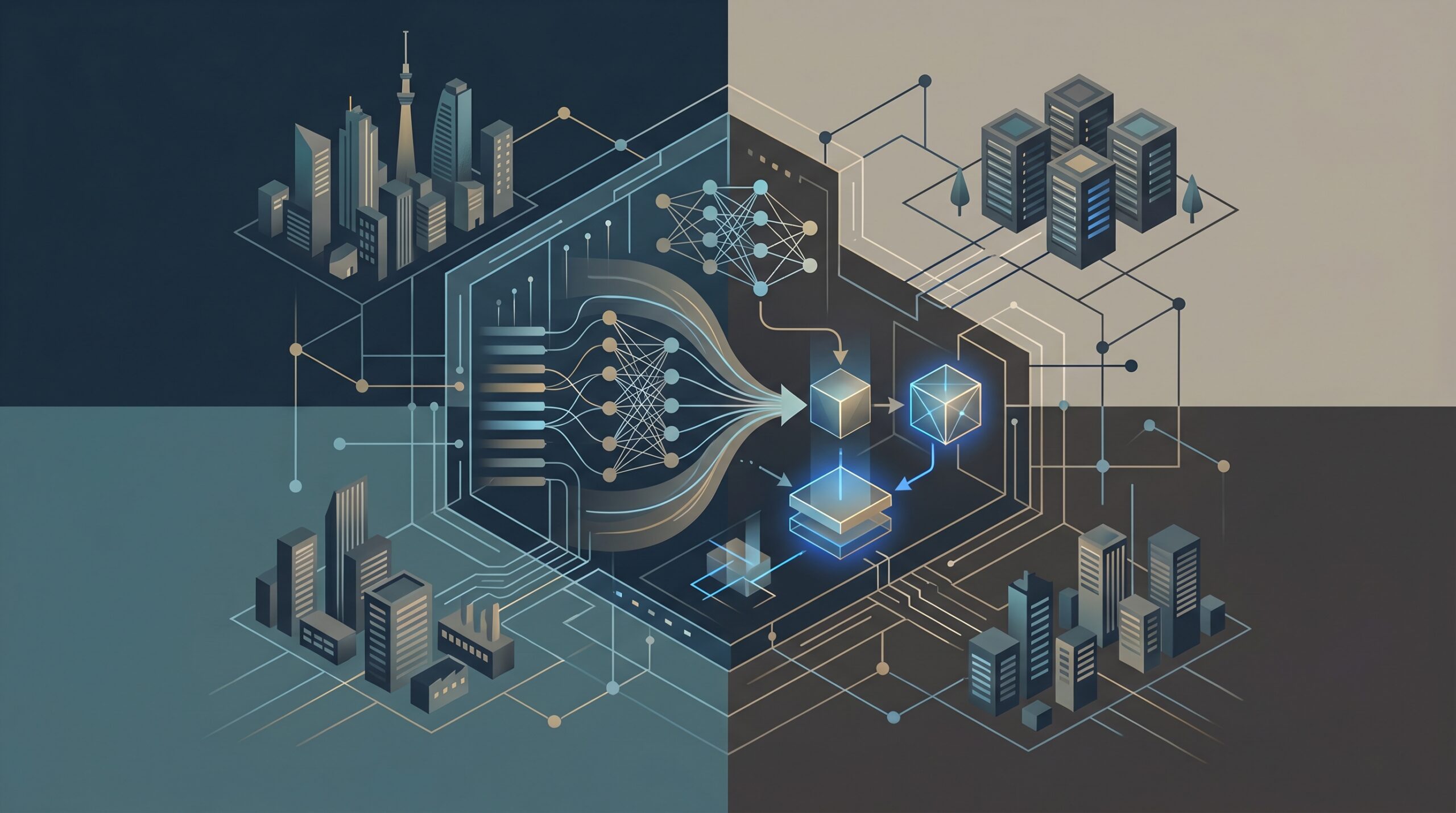

LLMは、過去に入力・生成したテキストの文脈を保持しながら次の単語を予測します。この際、計算の重複を避けて高速化を図るために「KV(Key-Value)キャッシュ」と呼ばれる仕組みが使われます。しかし、入力されるテキスト(コンテキスト)が長くなればなるほど、このKVキャッシュは肥大化し、膨大なメモリを占有してしまいます。限られたGPUリソースの中で同時に処理できるユーザー数が減少し、結果として運用コストの増大やレスポンスの遅延を招くのです。

KVキャッシュ圧縮を支える3つの主要アプローチ

このメモリオーバーヘッドの課題を解決するため、グローバルのAI研究やMLOps(機械学習の運用管理)の領域では、「KVキャッシュ圧縮」の技術開発が急速に進んでいます。主に以下の3つのアプローチが代表的です。

1つ目は「Eviction(退避・削除)」です。これは、文脈の理解において重要度の低いトークン(単語の断片)のキャッシュを意図的に捨て、重要な情報だけを保持する手法です。メモリ消費を一定に保つことができますが、どの情報を捨てるかの判断が難しく、文脈の一部をAIが忘れてしまうリスクがあります。

2つ目は「Quantization(量子化)」です。数値を表現する際のデータ精度(ビット数)を意図的に下げることで、データサイズそのものを圧縮します。メモリ消費を劇的に削減でき、計算速度の向上も見込めますが、精度を下げすぎるとAIの回答の正確さや表現力が劣化するトレードオフが存在します。

3つ目は「Low-Rank(低ランク近似)手法」です。複雑な行列計算を数学的に簡略化し、計算量とメモリ使用量を抑える高度なアプローチです。高い効果が期待できる一方で、モデルのアーキテクチャや推論エンジンの実装に対する深い専門知識が求められます。

日本企業における自社ホスティングとRAGへの影響

これらの技術動向は、日本企業がAIを活用する上で極めて重要です。日本の商習慣や組織文化においては、機密性の高い顧客データや社内の技術文書を扱う際、パブリッククラウドのAPIにデータを送信することを避け、オンプレミス環境や閉域網(プライベートクラウド)内でオープンモデルを自社ホスティングするニーズが根強くあります。

特に、社内規程やマニュアルなどの大量の文書をAIに読み込ませて回答させる「RAG(検索拡張生成)」の仕組みでは、一度に処理するテキスト量が非常に長くなります。KVキャッシュ圧縮技術を適切に導入することで、高価な最新GPUを大量に調達しなくても、既存の限られた計算資源で実用的なレスポンス速度のRAGを構築・運用することが可能になります。

ただし、圧縮による精度の低下は、コンプライアンスや業務品質に直結する懸念事項です。例えば、法務チェックや医療データの分析など、厳密な正確性が求められるタスクにおいては、過度な圧縮が致命的なハルシネーション(もっともらしいが事実と異なる回答)を引き起こす可能性があるため、慎重な検証が必要です。

日本企業のAI活用への示唆

これらを踏まえ、日本企業がLLMのプロダクトへの組み込みや業務活用を進める際の実務的な示唆を以下に整理します。

第一に、「コストと精度のトレードオフの可視化」です。KVキャッシュ圧縮をはじめとする推論最適化技術を導入する際は、業務要件に照らし合わせて「どこまでの精度低下なら許容できるか」を事前に定義し、定量的に評価するテスト環境(AIガバナンスの一環)を整備することが不可欠です。

第二に、「自社のインフラ戦略とAIモデル選定の連携」です。データセキュリティの観点から自社ホスティングを選択する場合、GPUの調達コストと運用コストはビジネスの採算性に直結します。プロダクトマネージャーやエンジニアは、単に「性能が良いモデル」を選ぶのではなく、今回紹介したような圧縮技術が適用しやすいか、推論エンジンとの相性は良いかという「運用効率」の視点を持つ必要があります。

第三に、「MLOps人材の育成・確保」です。LLMの運用はモデルを作って終わりではなく、推論効率の最適化という継続的なインフラチューニングが求められます。AIの最新研究をキャッチアップし、それをインフラ基盤に実装できるエンジニアリング体制を構築することが、中長期的なAI事業の成否を分けるでしょう。