ユーザーの危険な入力内容に対して、AIサービス提供企業はどこまで責任を負うべきか。カナダで起きた提訴事例を起点に、日本企業が自社プロダクトや業務システムにAIを組み込む際のガバナンスと法的リスク対応について解説します。

生成AIとユーザーの「危険な対話」、提供企業の責任を問う新たな訴訟

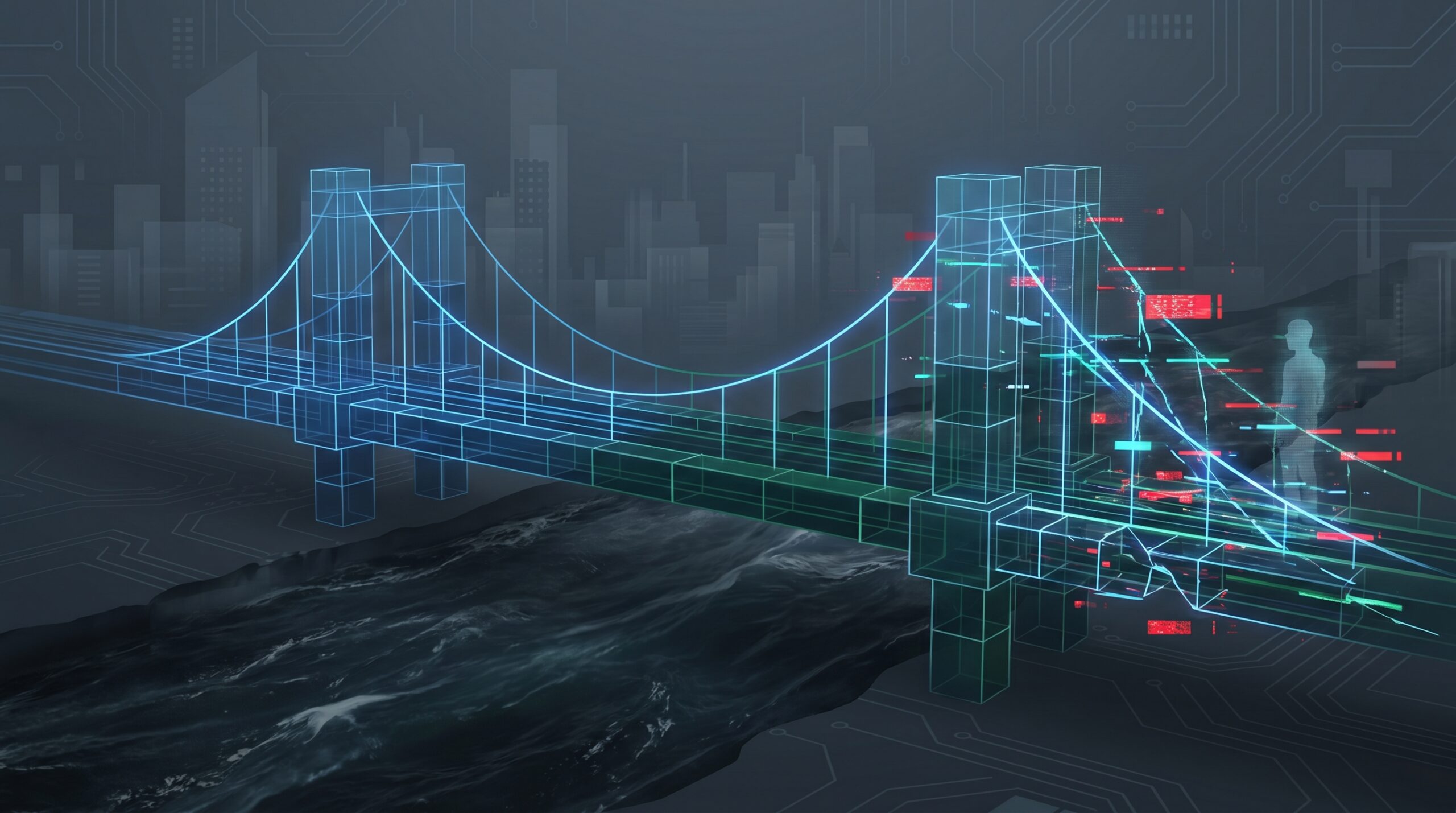

近年、生成AI(大規模言語モデル:LLM)が社会インフラとして定着する一方で、AIが犯罪や危険行為にどのように関与し、提供元がどこまで責任を負うべきかという法的・倫理的な問いが浮上しています。先日、カナダの学校で起きた銃撃事件の被害者家族が、ChatGPTを提供するOpenAIを提訴するという事案が発生しました。報道によれば、銃撃犯が事前にChatGPTと「警戒すべき内容のやり取り」をしていたにもかかわらず、OpenAIが警察に通報しなかったことが問題視されています。

この訴訟の最大の争点は、「AIサービス提供者は、ユーザーのプロンプト(入力指示)を監視し、重大な危害が予見される場合には警察等の外部機関へ通報する義務(作為義務)を負うのか」という点にあります。この問いは、単に海外のメガテック企業の問題にとどまらず、日本国内でAIを自社プロダクトに組み込んだり、顧客向けサービスとして展開したりする企業にとっても、決して対岸の火事ではありません。

日本の法規制における「通信の秘密」とAIの立ち位置

もし日本国内の企業が提供するAIチャットボットや組み込みサービスで同様の事態が起きた場合、どのように考えるべきでしょうか。日本において実務上の論点となるのが、電気通信事業法などで厳格に保護されている「通信の秘密」や、個人情報保護法に基づくプライバシーの保護です。

従来、メールやSNSのような通信サービスにおいて、事業者がユーザーのやり取りを能動的に検閲し、捜査機関へ通報することは、原則として通信の秘密の侵害にあたり、正当防衛や緊急避難といった極めて限定的な状況でのみ許容されてきました。しかし、生成AIは単なるユーザー間の「通信の媒介」ではなく、AI自身が対話の主体として情報を「生成」します。そのため、AIサービスが従来の通信インフラと同じ法理で保護されるのか、あるいはより重い管理責任・通報義務を問われるのかについては、現在も政府のAI事業者ガイドライン等で議論が続いている過渡期にあります。

自社サービスへのAI組み込みに伴うレピュテーションリスク

法的な通報義務が直ちに認められないとしても、企業が直面するもう一つの重大な課題が「レピュテーションリスク(風評被害)」です。自社が開発・提供したAIアシスタントや、顧客向けにローンチした新規サービスが、結果として犯罪の計画や違法行為の相談に利用されてしまった場合、ブランドや社会的信用の失墜は免れません。

特に、BtoC向けのカウンセリングAI、教育支援サービス、あるいはユーザーが自由記述でプロンプトを入力できる対話型プロダクトでは、自傷行為や他害行為を示唆するリスクが常に存在します。サービス提供企業は、「AIはあくまで汎用的なツールである」というスタンスに終始せず、社会的責任を果たすための安全網をプロダクトの設計段階から組み込むことが求められます。

実務におけるリスク緩和策:セーフティ機能と規約の整備

日本企業がこうしたリスクに現実的に対処するためには、システム面と運用面の双方からのアプローチが必要です。システム面では、各種クラウドベンダーが提供する「コンテンツフィルター」機能(例えばAzure OpenAI Service等に標準搭載されている、暴力や自傷、違法行為などを検知・ブロックする機能)を有効に活用し、危険なプロンプトの実行を未然に防ぐことが基本となります。また、悪意のある入力に対する耐性を検証する「レッドチーミング」をリリース前に実施することも有効です。

運用面では、利用規約において「法令違反や公序良俗に反する目的での利用禁止」を明記し、規約違反が疑われる場合の利用停止措置(アカウント凍結など)の権利を留保しておくことが不可欠です。さらに、万が一危険な利用の兆候をシステムが検知した場合に、社内の法務やリスク管理部門へアラートを上げ、警察等への相談要否を速やかに判断する「エスカレーションフロー」を事前に策定しておくことが、企業のコンプライアンス対応として強く推奨されます。

日本企業のAI活用への示唆

今回のカナダでの提訴事例から、日本企業が実務に活かすべき教訓は以下の3点に集約されます。

第1に「自社の責任範囲の明確化」です。AIを利用したサービスを提供する際、ユーザーの入力内容に対するモニタリング方針と、プライバシー保護(通信の秘密や個人情報保護)とのバランスを法務部門と協議し、利用規約に適切に反映することが重要です。

第2に「コンテンツフィルターの実装」です。システム開発・プロダクトへの組み込みにおいては、利便性や回答精度だけでなく、暴力・違法行為に関する入出力を遮断する安全装置(ガードレール)を初期設計から組み込むことが求められます。

第3に「有事のエスカレーション体制の構築」です。ユーザーから生命や身体に危害を及ぼすような入力が検知された場合、単にシステム側でエラーを返すだけでなく、人間(管理部門)が介入して緊急性を評価し、必要に応じて警察等の関係機関と連携できる運用フローを準備しておく必要があります。

AIは企業の生産性向上やサービス価値の創出に多大なメリットをもたらしますが、その強力な能力ゆえに予期せぬリスクも内包しています。技術の導入と並行して、こうした実務的なAIガバナンス体制を構築することが、日本企業が安全かつ持続的にAIを活用していくための鍵となります。