英国Lumai社が、数十億パラメータ規模の大規模言語モデル(LLM)をリアルタイムで推論可能な世界初の光学コンピューティングシステムを発表しました。AIの消費電力と遅延が世界的な課題となる中、光技術を活用した次世代ハードウェアは日本企業にどのような影響を与えるのでしょうか。

LLMの普及に伴う「計算資源と電力」の壁

生成AIや大規模言語モデル(LLM)がビジネスの実務に浸透するにつれ、計算資源の不足と消費電力の急増が世界的な課題となっています。特に、LLMを実際のサービスに組み込んでユーザーに応答を返す「推論(Inference)」のプロセスでは、GPU(画像処理半導体)への依存度が高く、データセンターの電力逼迫や運用コストの高騰を引き起こしています。日本国内においても、AIインフラの整備と並行して、電力の安定確保や環境配慮(カーボンニュートラル)への対応が、企業にとって無視できない重要アジェンダとして浮上しています。

Lumaiが発表した光学コンピューティングの可能性

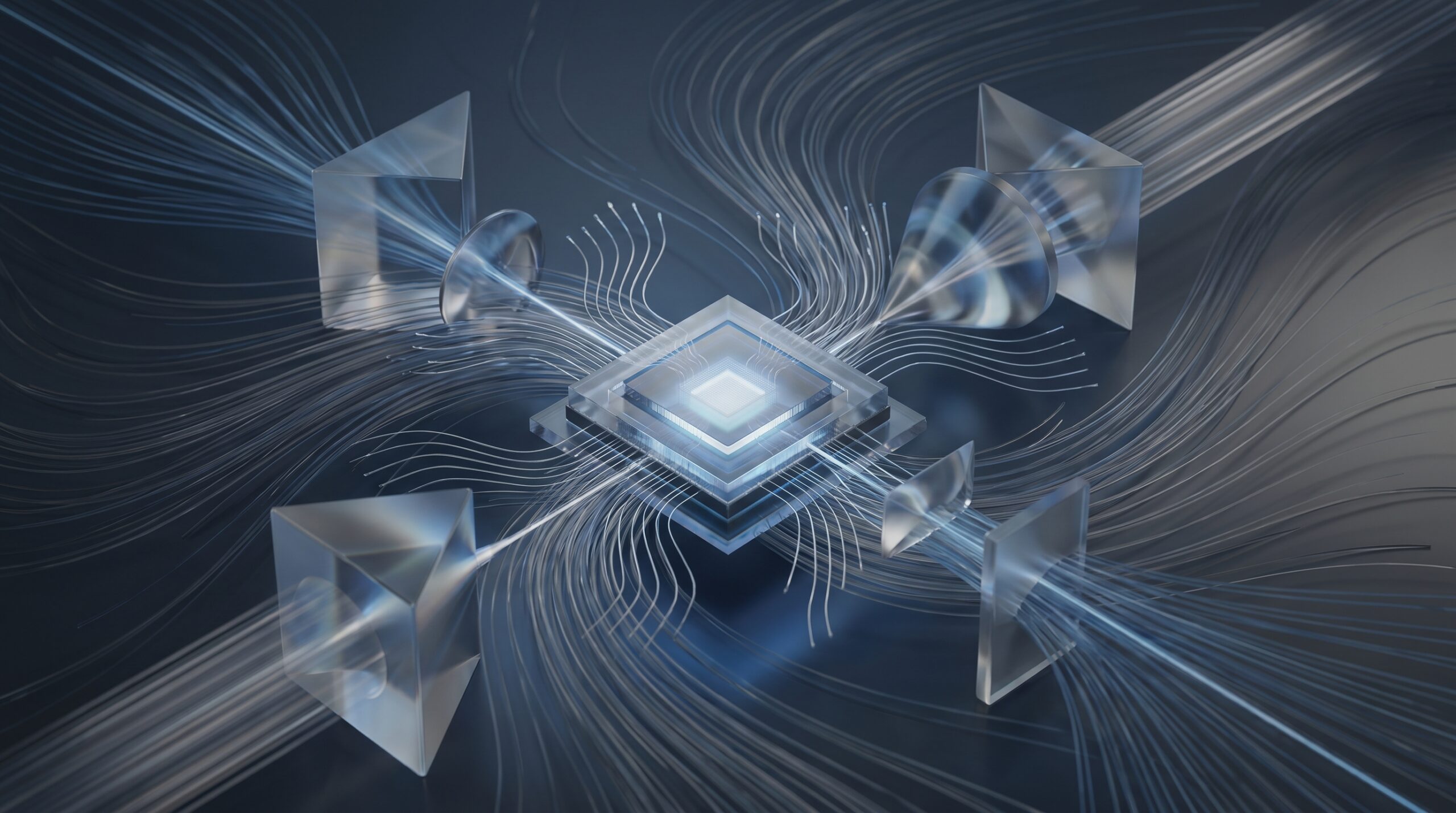

こうした中、Lumai社が、数十億(Billion)パラメータ規模のLLM推論をリアルタイムで実行できる世界初の「光学コンピューティングシステム」を発表しました。光学コンピューティングとは、従来の電子の代わりに「光(フォトン)」を用いて計算処理を行う技術です。電子回路のような発熱によるエネルギー損失が少なく、並列処理に極めて優れているため、超低遅延(低レイテンシ)かつ大幅な省電力が期待されています。

これまで光コンピューティングは実用化のハードルが高いとされてきましたが、今回の発表は、それがAI推論という実用的なフェーズに入りつつあることを示唆しています。パラメータ数が数十億クラスのモデル(実務に特化した中・小規模の軽量LLM)であれば、リアルタイムでの応答が可能になるため、即時性が強く求められるプロダクトへのLLM組み込みが現実味を帯びてきます。

日本企業への影響とユースケースの拡大

光学コンピューティングのような次世代ハードウェアの進化は、日本国内のAIニーズにも大きな影響を与えます。例えば、日本の基幹産業である自動車分野における自動運転技術や、製造業・物流におけるロボティクス制御など、ミリ秒単位の遅延が許されない領域へのAI適用がさらに加速する可能性があります。また、金融機関におけるリアルタイムでの不正検知や、顧客対応での人間同等の瞬時な音声対話AIなど、ビジネス用途でのユーザー体験(UX)を劇的に向上させる潜在力を秘めています。

一方で、手放しで既存システムが置き換わるわけではなく、実用化と普及にはまだ時間がかかると見るべき限界もあります。既存のGPUベースのシステムと比べた際のソフトウェアエコシステム(開発ツールやライブラリ群)の成熟度、初期導入コスト、実運用下での保守体制などは未知数の部分が多くあります。当面は、特定の用途やエッジ環境での補完的な活用から進むと予想されます。

日本企業のAI活用への示唆

・ハードウェアの進化を前提としたAI戦略の策定

AIの進化はソフトウェアのアルゴリズムだけでなく、ハードウェアの革新と両輪で進んでいます。現在「通信遅延や電力、コストの問題で実現不可能」とされているプロダクトのアイデアも、数年後には新技術によって解消される可能性があります。将来のインフラ進化を見越した中長期的なロードマップを描くことが重要です。

・軽量化LLMの実務的価値の再評価

数十億パラメータ規模のモデルが超高速・低消費電力で動くようになることで、特定の業務領域に特化した軽量化LLM(SLMなど)の価値がさらに高まります。外部の汎用巨大APIに依存するだけでなく、自社環境(オンプレミスやエッジデバイス)で独自モデルをセキュアに稼働させるノウハウを蓄積することは、日本の組織文化が重視するデータガバナンスの観点でも有効です。

・エコシステム全体での技術選定とリスク評価

革新的なハードウェア技術を導入する際は、単なる処理速度のスペック比較に留まらず、既存の自社システムとの統合性や、エンジニアの再学習コストを含めた総合的なリスク評価が必要です。特定のベンダー技術に過度にロックインされることなく、オープンな標準技術の動向を注視し、柔軟にアーキテクチャを変更できる体制づくりが求められます。