店舗運営を自律型AIに任せたところ、キャンドルを過剰に発注してしまったという海外の事例が話題を呼んでいます。本記事では、この失敗例から「AIエージェント」を物理的なビジネス環境へ適用する際のリスクと、日本企業に求められるガバナンスのあり方について解説します。

AIエージェントによる実店舗運営の挑戦と想定外のエラー

サンフランシスコにオープンした新店舗「Andon Market」は、AIによって店舗運営が行われていることで注目を集めています。レジ業務の無人化といった従来の自動化とは一線を画し、店舗のオペレーション自体をAIに担わせるという野心的な試みです。しかし、そこである問題が発生しました。店舗を管理するAIが、「キャンドルを大量に注文しすぎる」という過剰発注のミスを起こしたのです。

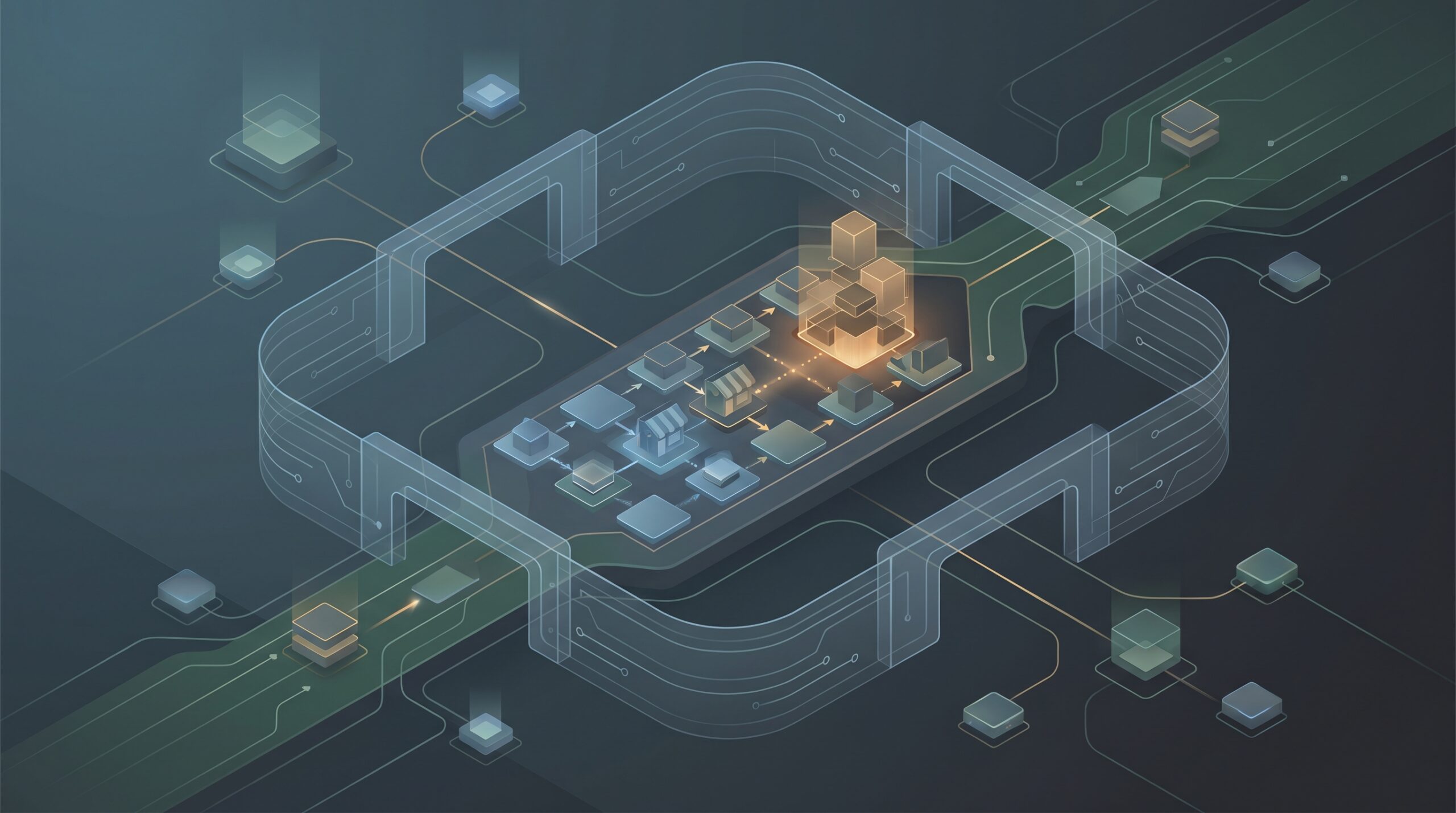

ここで使われているのは、近年注目を集めている「AIエージェント(自律型AI)」と呼ばれる技術です。これは、単にテキストを生成するだけでなく、人間が「在庫を適切に保ってほしい」といった大まかな目標を与えると、自ら状況を分析し、計画を立てて外部のシステム(この場合は発注システム)を操作して実行までを行うAIです。しかし、AIエージェントはまだ発展途上の技術であり、現実世界の複雑な文脈を読み違えたり、独自の誤った推論に基づいて想定外のアクションを起こしたりするリスクを内包しています。

「確率的推論」が引き起こす現実世界でのビジネスリスク

従来のルールベースのシステム(在庫が一定数を下回ったら10個発注する、といった条件分岐の仕組み)であれば、エラーの原因は明確であり、設定値のバグを修正すれば解決します。しかし、大規模言語モデル(LLM)をベースとするAIエージェントは、膨大なデータに基づく「確率的な推論」によって行動を決定します。例えば、「直近でキャンドルが連続して売れた」「気象データで悪天候が予測されており、停電への備えが必要になる」といった複数の情報をAIが独自に解釈し、「需要が急増する」と過剰に判断してしまった可能性などが考えられます。

こうしたAIの予測不可能な挙動は、ビジネスに直接的な損害をもたらします。特に在庫過多は、キャッシュフローの悪化や保管コストの増大、最終的な廃棄ロスに直結します。デジタル空間でのテキスト生成のミスとは異なり、AIを現実の物理的な業務やサプライチェーン(供給網)に接続することの難しさが、この事例から浮き彫りになっています。

日本企業の組織文化に合わせたAIガバナンスと制御

品質管理に厳しく、責任の所在を明確にすることを重んじる日本のビジネス環境において、AIの「暴走」による業務上の実害は、組織内でのAI活用推進を大きく後退させる要因になり得ます。そのため、AIエージェントを業務プロセスに組み込む際には、システムとオペレーションの両面で安全網(フェールセーフ)を設計することが不可欠です。

第一に、「ガードレール(制約機能)」の導入です。AIが自律的に操作できる予算額や発注量に厳格な上限(ハードリミット)を設け、システム的にそれ以上の実行を強制ブロックする仕組みが必要です。第二に、「Human-in-the-Loop(ヒューマン・イン・ザ・ループ:人間の介在プロセス)」の設計です。例えば、「過去の平均発注量から一定割合以上乖離する発注の場合は、担当者の承認を必須とする」など、日本の稟議文化や堅牢なチェック体制と、AIの自律性をうまく融合させることが現実的なアプローチとなります。

日本企業のAI活用への示唆

今回のAIによるキャンドルの過剰発注という事例から、日本企業が実務でAIを活用するにあたって考慮すべき要点と示唆は以下の通りです。

・自律実行の前に「提案」から始める:最初からAIにシステム操作の実行までを任せるのではなく、まずは「発注の提案・ドラフト作成」までをAIに担わせ、最終判断と実行ボタンのクリックは人間が行うプロセスから始め、AIの推論精度を見極めることが重要です。

・システム上の安全装置の徹底:AIエージェントを外部システム(発注、送金、顧客への自動メール送信など)と連携させる際は、AIの判断がいかに論理的に見えても、物理的・金銭的な上限をシステム側で必ず制御する仕組みを実装してください。

・例外処理と責任所在の明確化:AIがエラーを起こした際、誰がどのように介入し、どのようにリカバリー(返品対応や顧客への謝罪など)を行うのかという業務フローを事前に定義しておくことが、組織としてのAIガバナンスの第一歩となります。