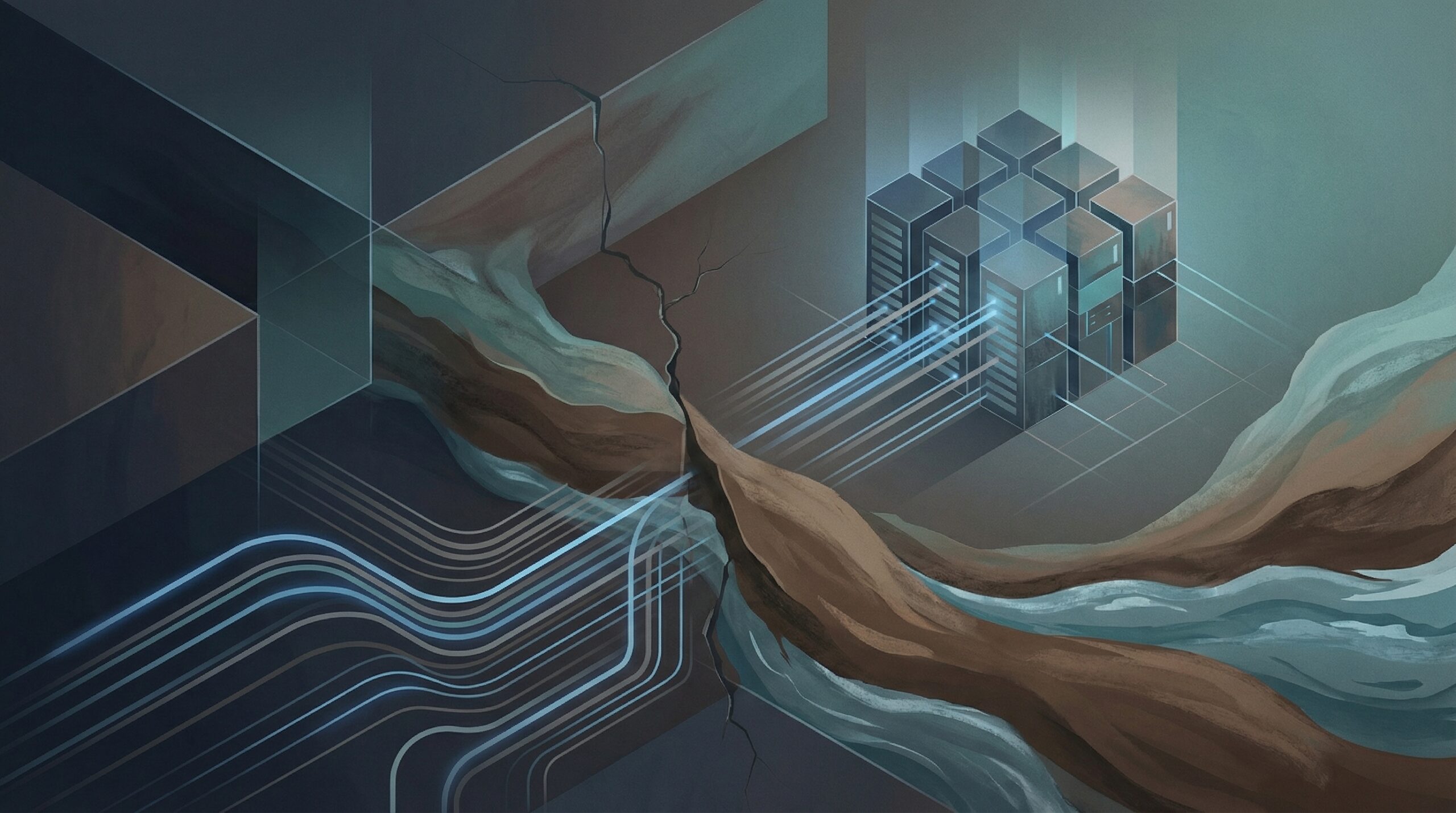

米国アリゾナ州チャンドラー市で、AI向けデータセンターの建設計画が地域住民の反対により却下されました。ロビイング活動の末のこの決定は、急速なAI需要の拡大に対し、電力や水資源といった物理インフラと地域社会の許容度が限界に達しつつあることを示しています。日本企業にとっても対岸の火事ではない、AIインフラの課題と向き合い方を解説します。

止まらないAI需要と「場所がない」という現実

生成AIブームに伴い、世界中でGPUを大量搭載したデータセンターの建設ラッシュが続いています。しかし、米国のアリゾナ州チャンドラー市で起きた事例は、この拡大路線に「待った」がかかる象徴的な出来事となりました。報道によれば、元上院議員などの有力者によるロビイング活動が行われたにもかかわらず、市議会はデータセンター建設のための土地利用区分の変更(リゾーニング)を却下しました。

この背景には、AIモデルの学習や推論に必要な莫大な電力消費、冷却システムが消費する水資源、そして施設からの騒音に対する地域住民の根強い懸念があります。特にアリゾナのような水資源が貴重な地域では、テック企業の成長よりも生活環境の維持を優先する「地域主権(Local Control)」の動きが強まっています。

日本国内のAIインフラ事情とリスク

この問題は、日本企業にとっても決して他人事ではありません。日本国内でも千葉県印西市や北海道、九州などでデータセンターの建設が進んでいますが、以下の3つの観点から同様のリスクや制約が顕在化しつつあります。

第一に「電力供給の制約」です。AIサーバーは従来のサーバーに比べて桁違いの電力を消費します。日本の電力需給は逼迫しており、新たなデータセンター建設が地域の電力網を圧迫する懸念があります。これにより、電力コストの上昇や、最悪の場合は新規稼働の遅延といったリスクが考えられます。

第二に「環境負荷とESG」です。サステナビリティ(持続可能性)を重視する今日のビジネス環境において、大量の電力を消費するAI活用の在り方が問われ始めています。株主や顧客から「そのAIサービスは環境に配慮されているか」という説明責任を求められるケースが増えてくるでしょう。

第三に「土地と受容性」です。日本は平地が少なく、住宅地と産業地域が近接しています。騒音や熱排気の問題は、米国以上にセンシティブな地域課題となり得ます。

日本企業のAI活用への示唆

米国の事例と国内事情を踏まえ、日本の意思決定者やエンジニアは以下の点を考慮してAI戦略を構築すべきです。

1. クラウドコストの上昇を見越した設計

データセンターの建設難航は、長期的にはコンピュートリソース(計算資源)の供給不足と価格高騰を招く可能性があります。無尽蔵にLLM(大規模言語モデル)を叩くのではなく、コスト対効果を見極めた利用や、必要最小限のモデルサイズを選定する設計思想が重要になります。

2. 「グリーンAI」視点の導入

AIモデルの開発・運用において、エネルギー効率を指標(KPI)に組み込むことが推奨されます。学習コストを下げるための転移学習の活用や、推論時のエネルギー消費が少ない小規模モデル(SLM)の採用は、コスト削減と環境対応の両面でメリットがあります。

3. ハイブリッド・エッジAIの検討

すべての処理をクラウドの巨大データセンターに依存するリスクを分散するため、機密性の高いデータや低遅延が求められる処理はオンプレミス(自社運用)やエッジデバイス側で行う「ハイブリッド構成」の重要性が増しています。

AIはソフトウェアの革新ですが、それを支えるのは物理的なインフラです。「どこで、どのようなエネルギーを使って計算させるか」という視点は、今後のAIガバナンスにおいて不可欠な要素となるでしょう。