生成AIの導入において最大の壁となるのが「もっともらしいウソ(ハルシネーション)」です。本記事では、AI自身に回答の不確実性を問わせるシンプルなプロンプト手法を起点に、高い品質要求を持つ日本企業がどのようにAIの精度管理とリスク対応を進めるべきかを解説します。

生成AI導入の障壁となるハルシネーションと日本の品質基準

大規模言語モデル(LLM)のビジネス活用がグローバルで進む中、日本企業の多くが直面しているのが「ハルシネーション(もっともらしいウソ)」の問題です。AIが事実と異なる情報を自信満々に出力してしまうこの現象は、業務効率化や顧客向けサービスへのAI組み込みにおいて、重大なコンプライアンスリスクやブランド毀損につながる恐れがあります。

特に日本市場は、世界的に見ても製品やサービスに対する品質要求が非常に高い傾向にあります。「わずかでも間違える可能性があるなら導入を見送るべきだ」という減点方式の組織文化や厳格な法務チェックにより、実証実験(PoC)から先のフェーズへ進めないケースも散見されます。したがって、ハルシネーションをいかにコントロールするかが、日本企業におけるAI活用の成否を握っていると言えます。

「不確実性を疑わせる」自己検証プロンプトの有効性

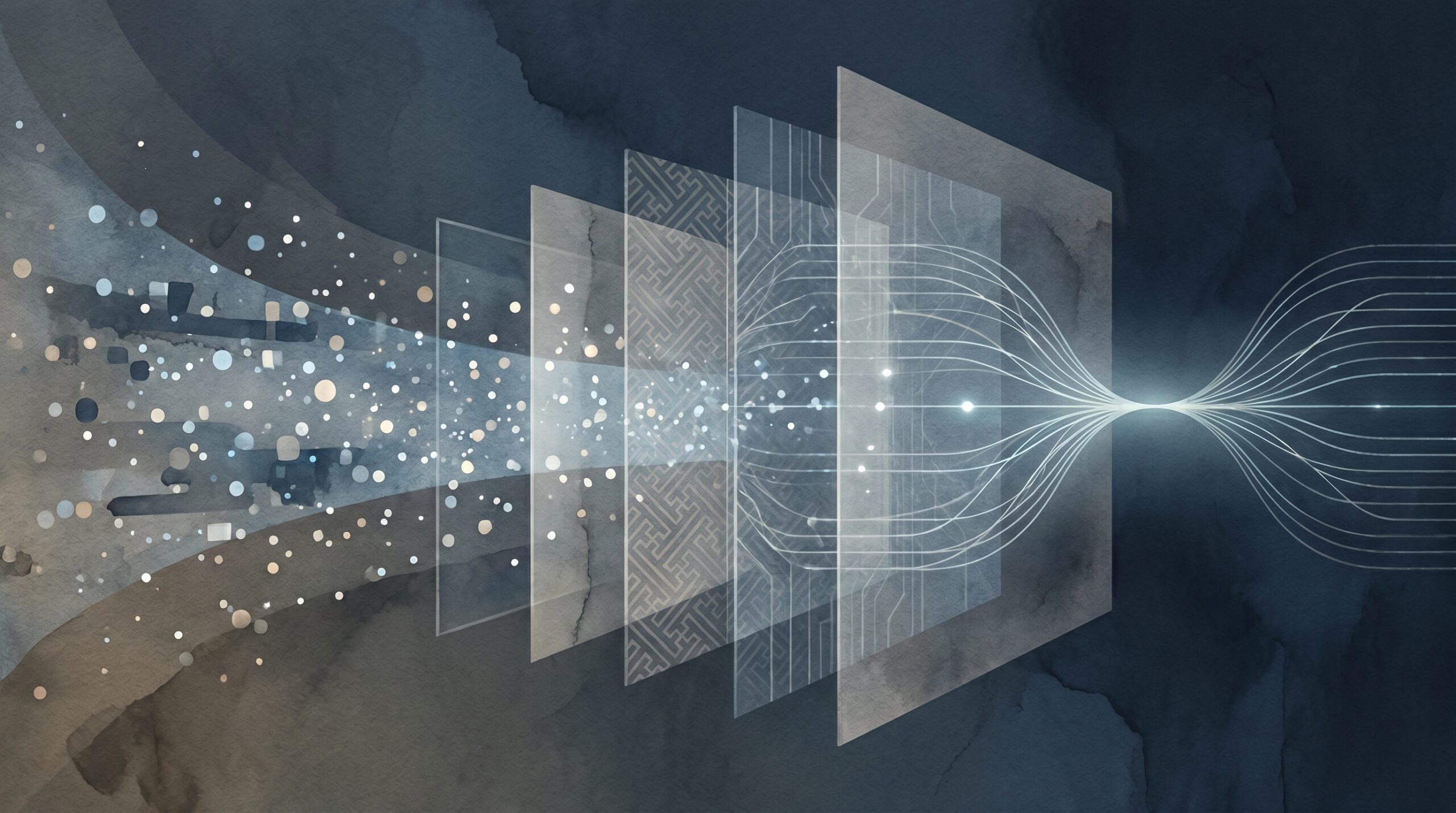

こうした課題に対し、グローバルなAI開発の現場では様々なプロンプト(AIへの指示文)の工夫が共有されています。中でも有効なのが、AI自身に自らの回答の「不確実性」や「論理の弱さ」を問い直させるアプローチです。

具体的には、単純に回答を求めるだけでなく、「回答を生成する前に、その根拠が十分か、不確実な点がないかを自己検証してください」といった指示を追加します。また、「推測に基づく回答は避け、情報が不足している場合は『分からない』と明記してください」とルール化することも重要です。このように、AIに自らの出力プロセスを客観視(自己評価)させることで、情報の飛躍や捏造を一定レベルで抑え込むことが可能になります。

実務における限界とシステム全体でのリスク対応

一方で、プロンプトの工夫だけでハルシネーションを完全にゼロにすることは、現在のLLMの仕組み上不可能です。AIを実際の業務フローやプロダクトに組み込む際は、AIが間違えることを前提としたシステム全体でのフェイルセーフ(障害発生時にも安全を保つ設計)が求められます。

実務においては、RAG(検索拡張生成:外部のデータベースから正確な情報を検索し、それを元にAIに回答させる技術)を組み合わせて根拠となる社内規定やマニュアルを参照させることが基本となります。さらに、最終的な意思決定の前に人間が内容を確認するプロセス(ヒューマン・イン・ザ・ループ)を設けるなど、AIの限界を人間やシステムで補完する業務フローの再設計が不可欠です。

日本企業のAI活用への示唆

これまでの考察から、日本企業がAIのハルシネーションリスクに向き合い、実務での活用を進めるための要点は以下の通りです。

1. 「分からない」と言えるAIを設計する:完璧な回答を強要するのではなく、自己検証プロンプトを用いて、情報が不足している場合には素直に「分からない」と出力するようAIを制御することが、コンプライアンス対応とリスク管理の第一歩となります。

2. 100%の精度を求めず、適材適所で活用する:顧客への直接的な自動応答などリスクが高い領域から始めるのではなく、まずは社内のアイデア出し、会議事録の要約、開発の壁打ちなど、人間が必ずレビューを行う業務から段階的に導入し、組織のAIリテラシーを育てるべきです。

3. プロンプトとシステムの多層的なガバナンス:プロンプトによる精度向上策に加え、RAGによる情報源の統制や、人間による確認プロセスを組み合わせた多層的な防御策を構築することが、日本の厳格な商習慣においても信頼されるAIプロダクトを実現する鍵となります。