生成AIブームが一巡し、企業の関心は「AIとどう話すか」から「AIにどう仕事をさせるか」へと移行しつつあります。2026年に向けて最大の焦点となる「エージェント型AI(Agentic AI)」の動向を解説し、日本の商習慣や組織構造において、この技術をどのように業務プロセスへ組み込み、リスクを管理すべきかを考察します。

「チャットボット」から「エージェント」へ

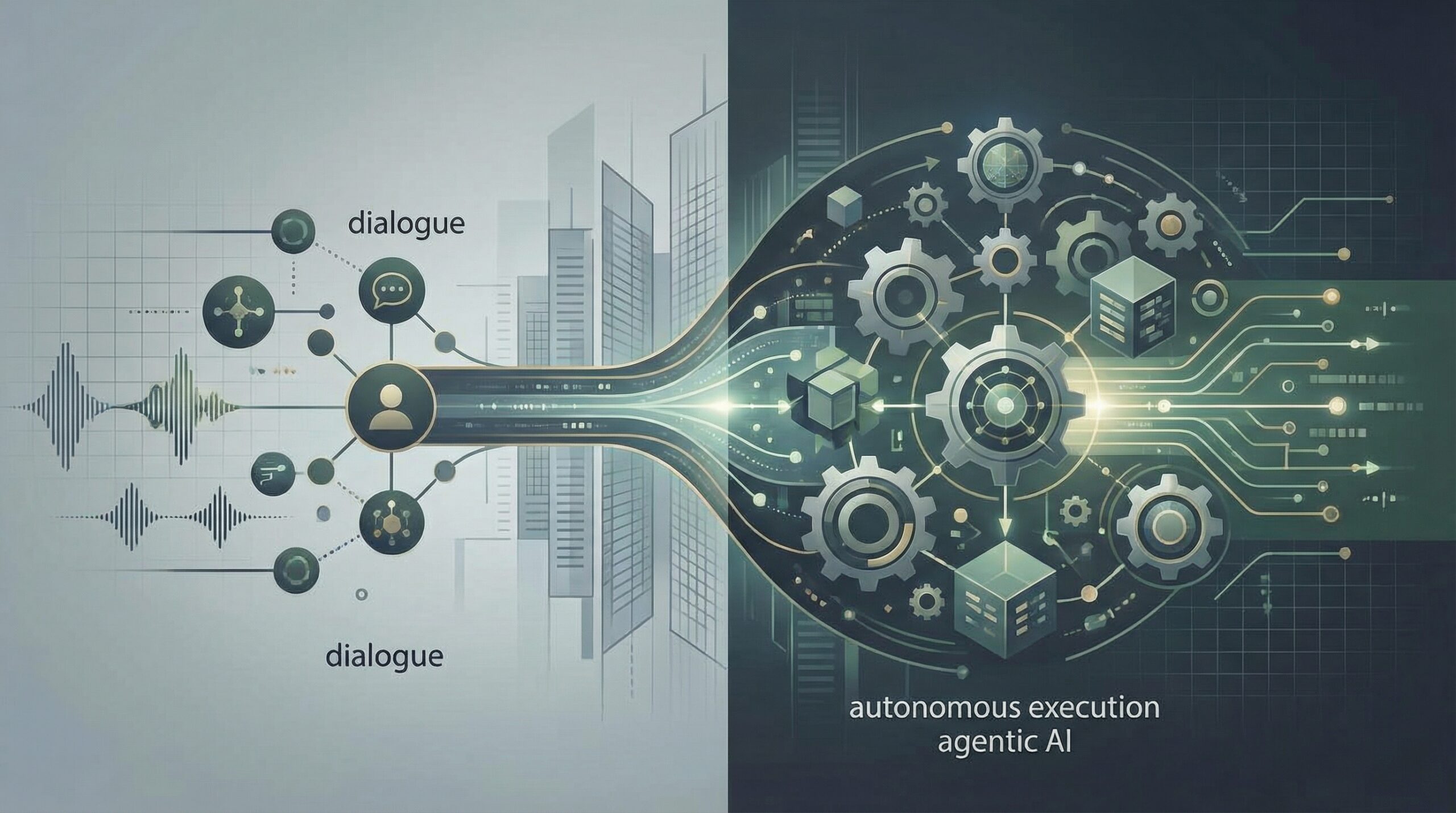

現在の生成AI活用の多くは、人間が質問しAIが答えるという「対話型(チャットボット)」が中心です。しかし、2026年に向けて潮流は明確に変化しており、AIが自律的に計画を立て、ツールを使い、タスクを完遂する「エージェント型AI(Agentic AI)」が主役になりつつあります。

元記事でも触れられているMeta Platformsの事例は、この変化を象徴しています。Metaは、中小企業向けに「ソーシャルメディア広告マネージャー」の役割を果たすAIエージェントの開発を進めています。これは単に広告文案を生成するだけでなく、ターゲット選定、予算配分、出稿手続きといった一連のプロセスを、人間の専門家を雇う代わりに行うことを目指しています。

この「AIに役割(ロール)を与える」という考え方は、今後のシステム設計の根幹となります。単なる検索や要約の補助ツールではなく、業務フローの一部を担う「デジタル社員」としての運用が現実味を帯びてきています。

日本国内の課題と「自律実行」の親和性

日本市場において、このエージェント型AIは極めて高い親和性を持っています。深刻な人手不足が続く中、特に中小企業や大企業の特定部門において、専門職の採用難は経営リスクとなっています。AIエージェントが、マーケティング担当、経理処理の一次対応、あるいはカスタマーサポートの複雑な処理を「代行」できるようになれば、労働力不足に対する強力なソリューションとなり得ます。

一方で、日本の組織文化において「AIに勝手に行動させる」ことへの心理的・実務的なハードルは低くありません。稟議(りんぎ)制度や根回しといった、合意形成を重視する日本のビジネスプロセスにおいて、AIが自律的に外部へメールを送信したり、決済を実行したりすることは、大きなリスクと捉えられます。

リスクコントロールと「Human-in-the-loop」

エージェント型AIの実装において、最も重要なのは「ガバナンス」です。AIが自律的に動くということは、ハルシネーション(もっともらしい嘘)が単なる誤情報として画面に表示されるだけでなく、誤った発注や不適切な顧客対応という「実害」につながることを意味します。

したがって、今後の開発・導入においては、AIが完全に自律するのではなく、重要な意思決定ポイントで必ず人間が確認を行う「Human-in-the-loop(人間が関与するループ)」の設計が不可欠です。例えば、AIが広告プランを作成し、入稿データまで準備するが、最終的な「出稿ボタン」は人間が押す、といったプロセス設計です。日本の現場では、こうした責任分界点を明確に定義することが、AI導入の成否を分けるでしょう。

日本企業のAI活用への示唆

2026年のトレンドを見据え、日本企業のリーダーや実務担当者は以下の点に着目して準備を進めるべきです。

- 「チャット」からの脱却と業務分解:

「何を聞くか」ではなく「どの業務プロセスを任せるか」という視点で業務フローを見直してください。定型業務かつ判断基準が明確なタスクから、エージェント化の検討を始めるべきです。 - ガバナンスとガードレールの整備:

AIが自律行動する際の権限範囲(アクセス権限、予算上限など)を技術的・規定的に制限する仕組みが必要です。日本企業の強みである「品質管理」の思想を、AIの出力管理にも適用することが求められます。 - データ整備の重要性再認識:

エージェントAIが正しく働くためには、社内マニュアルや過去の意思決定データが整理されている必要があります。AIに「判断」をさせるための、信頼できる参照データの整備(データガバナンス)が、これまで以上に重要になります。