生成AIの進化に伴い、単一のAIモデルに依存するのではなく、目的やコストに応じて複数のモデルを使い分ける「マルチモデル」アプローチが主流になりつつあります。本記事では、複数モデルへのアクセスを一元管理する「AIゲートウェイ」の役割と、日本企業が直面するガバナンス課題への処方箋を解説します。

生成AIの実装は「単一モデル依存」から「適材適所のマルチモデル」へ

OpenAIのGPTシリーズだけでなく、AnthropicのClaude、GoogleのGemini、あるいは各種オープンソースモデルや国内ベンダーが提供する国産LLMなど、企業が利用できるAIモデルの選択肢は急速に拡大しています。グローバル市場ではすでに、特定のベンダーに依存しない「モデルアグノスティック(特定の技術やモデルに縛られない状態)」なアプローチがトレンドとなっており、業務の特性や求める応答速度、コスト要件に応じて最適なモデルを使い分ける運用が始まっています。

たとえば、高度な論理的推論や精緻な日本語出力が求められる社内文書の作成には高性能なモデルを利用し、大量の定型データ処理やリアルタイム性が求められる顧客対応チャットボットには軽量で安価なモデルを採用する、といった適材適所の組み込みが求められています。

「AIゲートウェイ」とは何か? 複数モデルを統合するハブの役割

しかし、複数のAIモデルを自社のプロダクトに組み込んだり、社内の各部門に提供したりする場合、運用上の大きな課題が生じます。各モデルで異なるAPI仕様の吸収、部門ごとの利用コストのトラッキング、そして何よりセキュリティやアクセス権の管理が極めて煩雑になるためです。

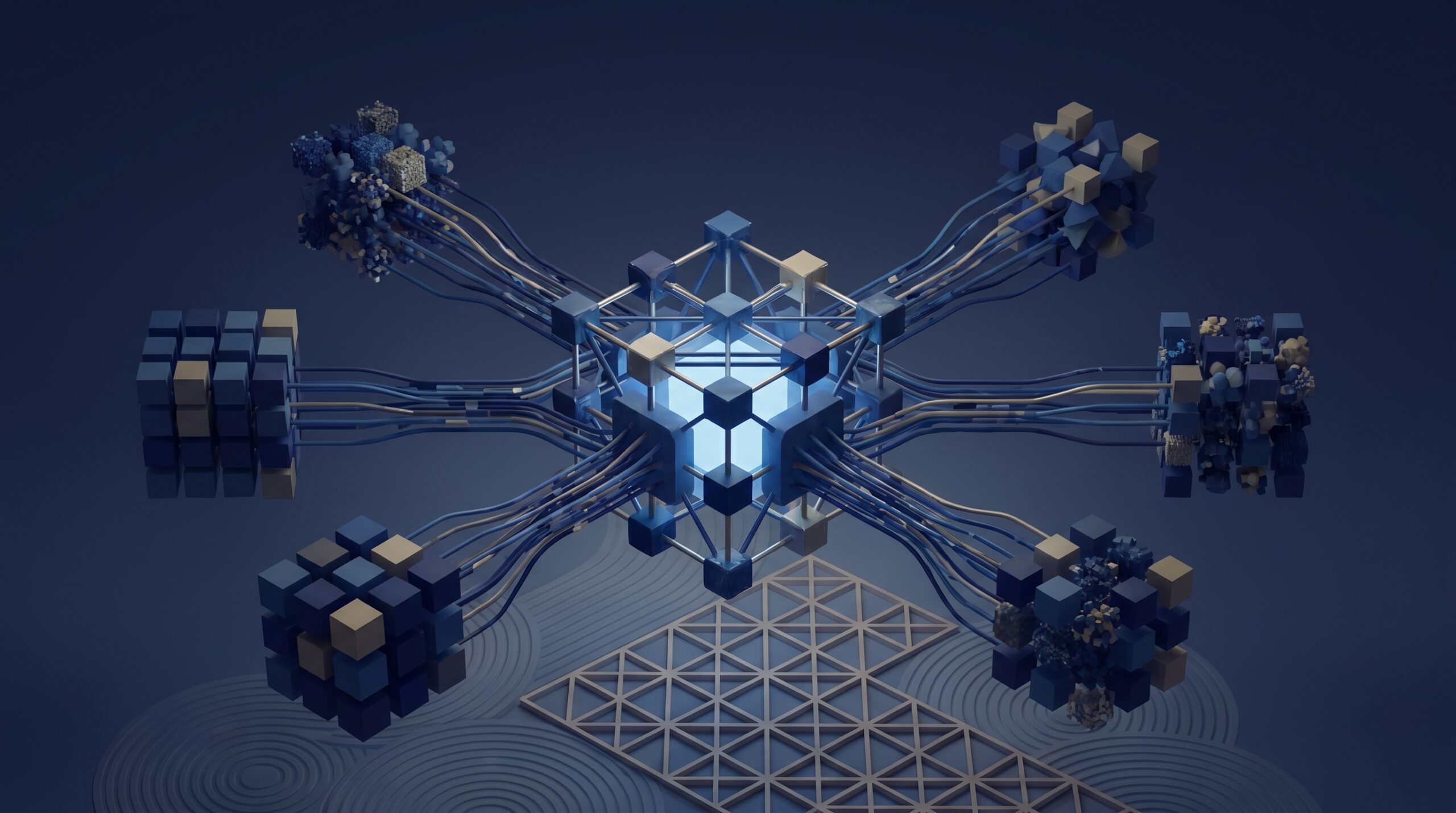

ここで注目されているのが「AIゲートウェイ」というアーキテクチャです。クラウドやインフラプロバイダーのドキュメントにも見られるように、AnthropicやOpenAIといったサードパーティ製のモデルへのアクセスを、単一のエンドポイント(接続口)に集約・仲介する仕組みを指します。これにより、アプリケーションやユーザーはゲートウェイにリクエストを送るだけで、裏側で稼働する様々なモデルに柔軟かつ統一的な方法でアクセスできるようになります。

日本企業の組織文化とガバナンス要件への親和性

このAIゲートウェイの仕組みは、とりわけ内部統制やコンプライアンス要件が厳格な日本企業にとって重要な意味を持ちます。日本企業では、各部署が現場主導で外部のSaaSやAPIを導入する「シャドーIT(情報システム部門が把握していないITツールの利用)」が、重大なセキュリティリスクとして捉えられる傾向があります。AIの文脈における「シャドーAI」を防ぐためには、一律に利用を禁止するのではなく、安全で使い勝手の良い環境を会社として提供するアプローチが不可欠です。

AIゲートウェイを導入することで、情報システム部門やAI推進組織(CCoEなど)は「誰が、どのモデルを、どれくらい利用しているか」を中央でモニタリングし、監査ログを確実に保存することが可能になります。また、個人情報や機密情報を含むプロンプトが外部に送信されないよう、ゲートウェイ層でフィルタリングやマスキングをかけるといったコンプライアンス対応の実装も容易になります。

導入におけるリスクと実務上の留意点

一方で、AIゲートウェイの導入にはリスクや限界も存在します。まず、すべてのAIリクエストがゲートウェイを経由するため、このシステム自体が「単一障害点(SPOF:そこが停止するとシステム全体が機能不全に陥る箇所)」になるリスクがあります。そのため、ゲートウェイの選定・構築にあたっては、可用性やパフォーマンスに高い水準が求められます。

また、複数の異なるモデルのAPIを共通の仕様に抽象化して扱う性質上、特定のモデルが発表したばかりの最新機能(独自のマルチモーダル機能や特殊なパラメータなど)を、即座には利用できないタイムラグが発生する場合があります。最新機能をいち早くプロダクトに組み込みたい新規事業開発の現場と、安定・統制を重視する管理部門との間で、どこまでを標準化し、どこからを個別最適とするか、運用ルールの擦り合わせが実務的な課題となるでしょう。

日本企業のAI活用への示唆

1. 特定ベンダーへの依存(ロックイン)の回避:特定のAIモデルにシステム全体を最適化しすぎると、別のモデルが技術的な優位性を持った際の移行コストが跳ね上がります。初期段階からAIゲートウェイの導入や、それに類する中間層の設計を検討し、モデルの切り替えを容易にする柔軟なアーキテクチャを構築することが推奨されます。

2. 統制とアジリティ(俊敏性)の両立:監査ログの取得や利用コストの可視化は、稟議文化や説明責任を重んじる日本の組織において、本格的なAI展開の強力な後押しとなります。ただし、管理を厳格化しすぎて開発や業務効率化のスピードを落とさないよう、検証環境と本番環境でゲートウェイの制限レベルを変えるなどの実務に即した運用設計が必要です。

3. 継続的なモデル評価体制の構築:マルチモデル環境を整備した後は、「どの業務・どのプロダクト機能に、どのモデルが最適か」を定量的に評価するMLOpsの視点が不可欠になります。精度の向上とコスト対効果を常に検証し、自社のビジネス要件に合わせたAIの適材適所を追求していくことが、長期的な競争力に繋がります。