複数の生成AIモデルを最適に使い分ける「LLMルーター」の導入が進む一方で、中継層におけるコマンド改ざんや認証情報漏洩のリスクが指摘されています。本記事では、最新のセキュリティ動向を踏まえ、日本企業が安全にマルチLLM環境を運用するための実務的なアプローチを解説します。

マルチLLM環境を支える「LLMルーティング層」の台頭

企業における生成AI(LLM)の活用が本格化する中、単一のモデルに依存するのではなく、目的やコストに応じて複数のモデル(OpenAIのGPT-4、AnthropicのClaude、GoogleのGeminiなど)を動的に切り替える「マルチLLM戦略」が主流になりつつあります。この切り替えを自動化し、統合的なAPIエンドポイントを提供するのが「LLMルーター(ルーティング層)」と呼ばれるミドルウェアやサービスです。LLMルーターを導入することで、企業はベンダーロックインを回避し、システムの可用性向上やコスト最適化といった恩恵を受けることができます。

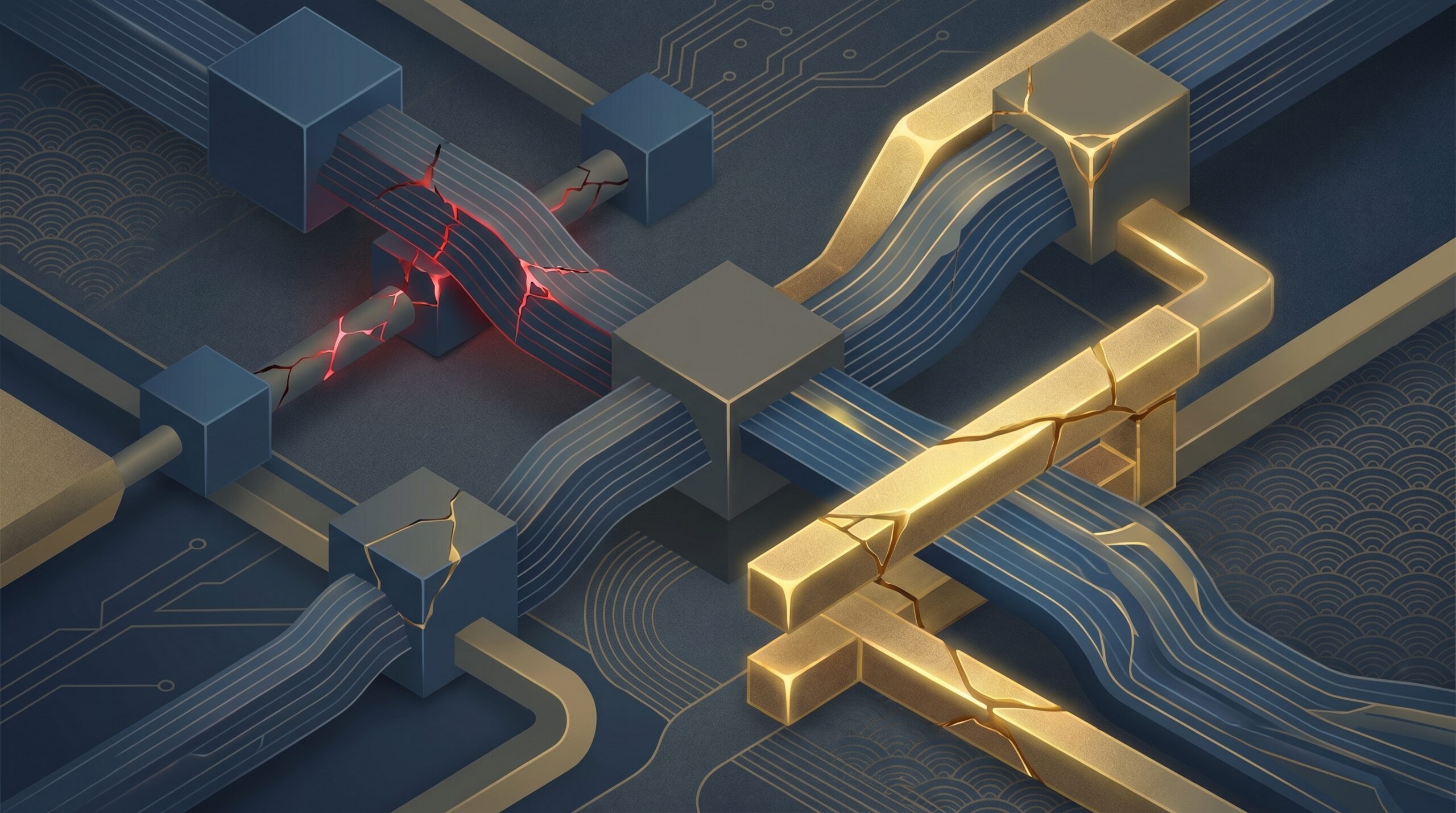

ルーティング層に潜む「コマンドの改ざん」と「機密情報漏洩」のリスク

一方で、LLMルーターという新たな中継層が追加されることで、特有のセキュリティリスクも浮上しています。海外のセキュリティ専門メディアの指摘によると、無料・有料を問わず一部のLLMルーティングサービスにおいて、AIエージェントに対する指示(コマンド)の完全性が損なわれるリスクや、機密性の高い認証情報が漏洩する脆弱性が確認されています。

これは、ユーザーやシステムから送信されたプロンプトがルーターを経由する過程で意図せず変更されたり、悪意のある第三者によってプロンプトインジェクションの経路として悪用されたりする可能性があることを意味します。また、複数のLLMにアクセスするためのAPIキーがルーター層に一元化されるため、この層がサイバー攻撃を受けた場合、重要な認証情報が奪われ、深刻な情報漏洩や不正利用による莫大なクラウド課金(経済的損失)につながる恐れがあります。

日本の法規制と組織文化を踏まえたガバナンスの課題

日本企業においてAIを業務利用・プロダクトへ組み込む際、個人情報保護法への対応や、顧客データ・営業秘密の厳格な管理が求められます。特に、社内規定で「入力データをAIの学習に利用させない(オプトアウト)」ことを必須としている企業は多いでしょう。

しかし、利用するLLM本体のオプトアウト設定は徹底していても、中継地点であるLLMルーティングSaaSのデータ取り扱いポリシー(ログの保存期間や二次利用の有無など)は見落とされがちです。もしルーティング層でプロンプトの内容が侵害されたり、システム連携用の認証情報が漏洩すれば、自社で構築したセキュリティ基準を根本から揺るがす事態となります。

安全なルーティングインフラを構築するための実務的アプローチ

このようなリスクを低減しつつマルチLLMの利点を享受するためには、アーキテクチャ全体での多層的な防御が必要です。第一に、サードパーティのルーティングSaaSを利用する場合は、セキュリティ認証の取得状況やデータ処理契約の内容を精査することが不可欠です。機密性が極めて高い業務データを扱う場合は、オープンソースのルーターを利用し、自社の閉域網内(VPC等)でセルフホストする選択肢も検討すべきでしょう。

第二に、プロンプト内への機密情報の混入を防ぐ仕組みです。ルーターへリクエストを送信する手前に、個人情報や機密データを検知・マスキングするデータ保護層を設けることで、万が一ルーティング層に不備があっても被害を最小限に抑えられます。第三に、認証情報の厳格な管理です。ルーターに設定するAPIキーには最小権限の原則を適用し、シークレット管理サービスを活用してセキュアに保持・定期更新する運用が求められます。

日本企業のAI活用への示唆

マルチLLM戦略は今後の企業AI活用において避けて通れない道ですが、アーキテクチャの複雑化に伴い「新たな攻撃面(アタックサーフェス)」が生じることを認識する必要があります。

実務への示唆として、開発チームとセキュリティ部門は、LLM本体の安全性だけでなく「データが通る経路全体(ルーター、APIゲートウェイ、プロキシ)」のリスクを評価するプロセスを構築すべきです。

また、外部のAPIやSaaSを選定する際は、日本の商習慣で求められる厳格なデータガバナンスを満たせるかという視点を持ち、自社ホストとSaaS利用のメリット・リスクを冷静に比較検討することが、持続可能で安全なAIプロダクト開発の鍵となります。