経営陣を感嘆させたLLMのデモが、なぜ本番環境では使い物にならなくなるのか。海外で指摘される「モニタリングのギャップ」を紐解き、日本企業が本番運用を成功させるための具体的な品質管理とLLMOpsのあり方を解説します。

「デモでは完璧だったのに」本番運用でLLMアプリが直面する壁

大規模言語モデル(LLM)を活用した新規事業や社内業務効率化のプロジェクトにおいて、「プロトタイプ(デモ)の段階では素晴らしい成果が出たのに、本番運用に乗せた途端に問題が続出する」という声が後を絶ちません。海外の技術メディア等でも指摘されている通り、LLMアプリケーションの開発において、デモの成功と本番環境での安定稼働の間には見えない高い壁が存在します。

特に、日本国内の企業は品質に対する要求水準が高く、顧客向けのサービスや社内の重要業務にLLMを組み込む際、少しでも不正確な回答や不適切な表現があるとプロジェクト全体がストップしてしまう傾向があります。この壁を乗り越えるための鍵となるのが、「モニタリング(監視)のギャップ」を理解し、適切に対処することです。

従来のシステム監視とLLM監視の「決定的なギャップ」

従来のソフトウェア開発における可観測性(オブザーバビリティ:システム内部の状態を外部から把握・監視する能力)は、主にエラー率、レイテンシ(応答遅延時間)、サーバーの負荷といったITインフラ側の指標に依存していました。「システムがダウンしていないか」「エラー画面が出ていないか」が重要だったのです。

しかし、LLMアプリケーションにおいては、これら従来の指標だけでは不十分です。システムとしては正常に応答していても、そのテキスト内容が事実無根(ハルシネーション)であったり、ユーザーの意図を完全に外していたりするケースが多発します。つまり、従来のITインフラ監視と、LLM特有の「出力品質の監視」の間には、埋めるべき大きなギャップが存在するのです。

日本の商習慣・組織文化における「LLMの品質リスク」

日本企業がLLMを自社プロダクトや顧客対応チャットボットなどに組み込む場合、このギャップは事業リスクに直結します。日本の商習慣においては、ブランドイメージを損なうような不適切な発言や、コンプライアンスに抵触するような回答は極端に嫌われる傾向があります。

また、個人情報保護の観点や各種業界ガイドラインに照らし合わせた際、入力されたプロンプトや出力されたデータがどのように処理されているかを後から追跡・監査できる状態にしておくことは、AIガバナンスの観点からも必須です。「システムは動いているが、いつ誰にどんな回答をしたか分からない」というブラックボックス状態を放置することは、深刻なコンプライアンス違反を招く恐れがあります。

LLMOps時代の新しい監視アプローチ

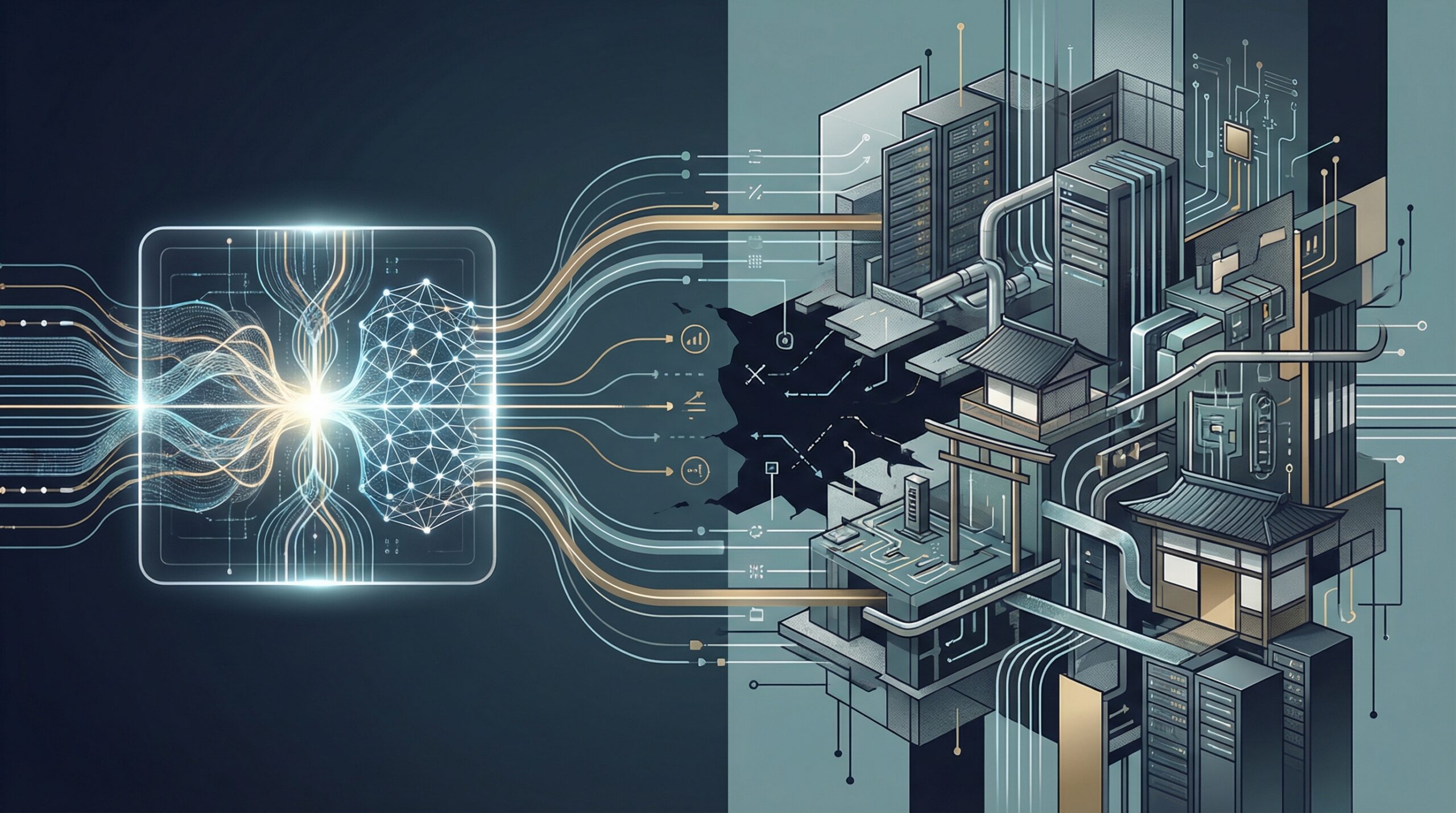

この課題に対処するためには、LLMOps(機械学習の運用基盤であるMLOpsをLLM向けに拡張した概念)における新しい監視アプローチを取り入れる必要があります。具体的には、システムの稼働状況に加えて「LLMの振る舞い」を継続的に評価・監視する仕組みです。

例えば、LLM自身に別のLLMの回答を評価させる手法(LLM-as-a-Judge)や、ユーザーからの「Good/Bad」フィードバックの継続的な収集、RAG(検索拡張生成:外部データベースの情報を参照して回答させる仕組み)における検索精度の監視などが挙げられます。また、プロンプトが入力されてから回答が生成されるまでのプロセスを可視化する「トレース」を導入することで、問題が発生した際の原因究明を迅速に行うことが可能になります。

日本企業のAI活用への示唆

LLMアプリケーションを「実証実験(PoC)」で終わらせず、実務で価値を生むシステムへと昇華させるためには、以下の点に留意する必要があります。

第一に、「LLMは間違えるもの」という前提に立ち、システムが正常稼働しているかだけでなく、出力される「内容の品質」を監視する体制を設計段階から組み込むことです。従来のエラー監視だけでは、ビジネスリスクを防げません。

第二に、品質の揺らぎに対する社内的な許容度(どこまでの誤りなら許容できるか、クリティカルな誤りをどう防ぐか)について、経営陣や法務・コンプライアンス部門と事前に目線を合わせておくことです。AIに完全無欠を求めるのではなく、リスクベースでの現実的な判断が求められます。

第三に、継続的な改善サイクルの構築です。本番環境で収集したユーザーの入力とLLMの出力、そしてその評価データを蓄積し、プロンプトの改善やRAGの精度向上に活かすLLMOpsの運用体制を整えることが、長期的なAIビジネス活用の成功を左右します。