大規模言語モデル(LLM)の実務導入が進む中、莫大なインフラコストとGPU調達難が企業の課題となっています。本記事では、LLMの効率的なデプロイを可能にする「モデル圧縮技術」のメカニズムと、日本特有のセキュリティ・業務要件を満たすための実践的なアプローチを解説します。

大規模言語モデル(LLM)の実用化を阻むインフラ課題

昨今、生成AIやLLMを自社のプロダクトや社内システムに組み込む動きが加速しています。しかし、モデルのパラメータ数が巨大化するにつれて、推論環境の維持にかかるコストも急増しています。クラウドベースのAIサービスを利用する場合、利用量に応じたランニングコストが事業を圧迫するケースが少なくありません。一方、情報セキュリティやデータ主権の観点から自社環境(オンプレミス)でLLMを稼働させたいと考える日本企業は多いものの、高性能なGPUの調達難と莫大なインフラコストが実用化の大きな障壁となっています。

リソースの制約を打破する「AIモデル圧縮」

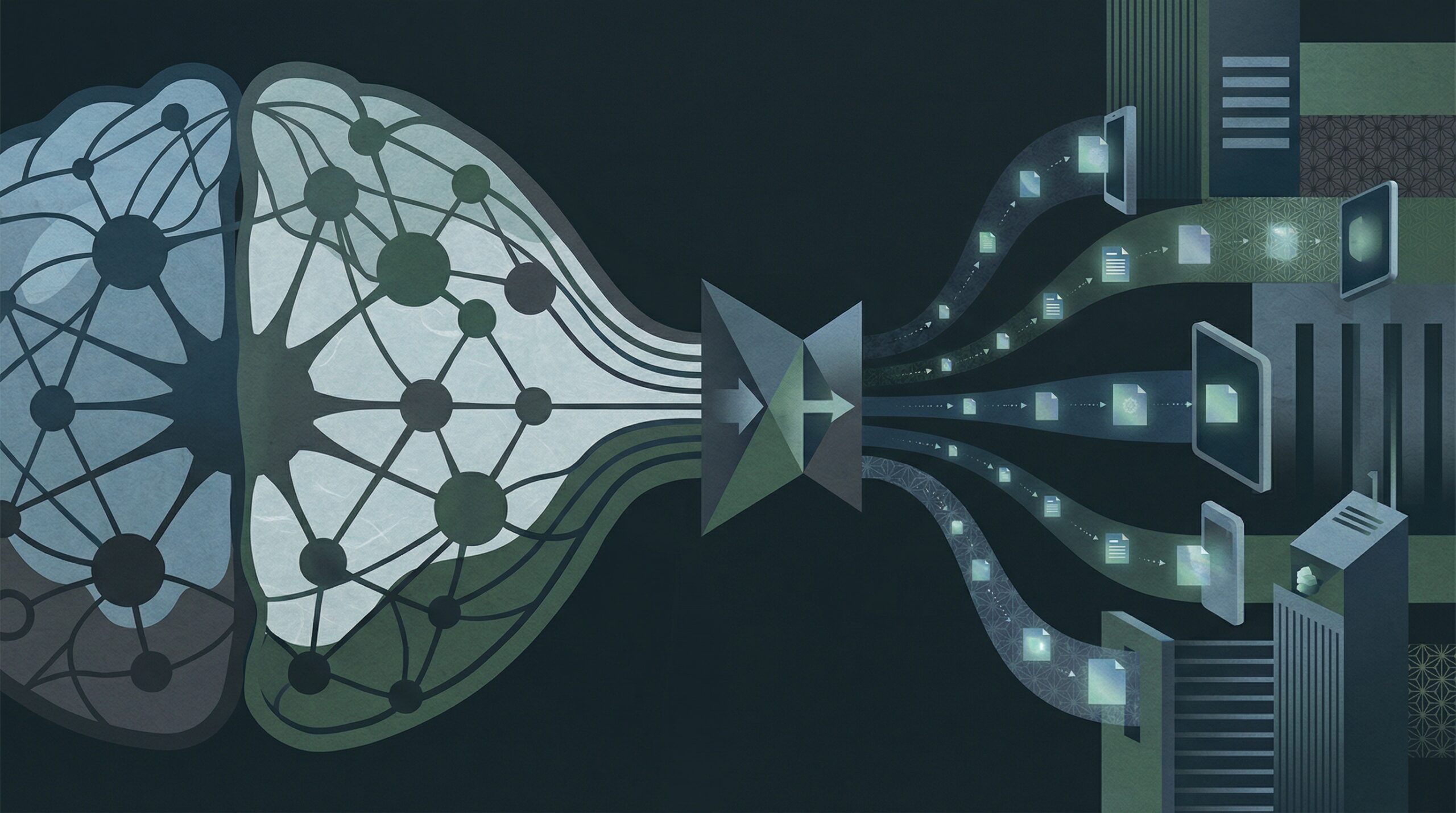

このような課題の解決策として注目されているのが「AIモデル圧縮」です。これは、AIモデルの性能を極力維持したまま、データサイズと計算量を削減する技術の総称です。代表的な手法として、パラメータのデータ精度を落としてメモリ使用量を減らす「量子化」、推論への影響が少ない内部の接続を削除する「枝刈り」、巨大で高性能なモデルの振る舞いを小規模なモデルに学習させる「知識蒸留」などがあります。これらの技術を活用することで、高価なサーバー用GPUがなくても、より安価な汎用ハードウェアでLLMを高速に動作させることが可能になります。

日本のビジネス環境における活用シナリオ

AIモデルの圧縮技術は、日本の産業構造や組織文化において重要な意味を持ちます。例えば、製造業の生産ラインでは、通信の遅延やネットワーク障害を避けるため、工場内のエッジ端末(現場の機器)で自律的に動作するAIが求められます。また、金融機関や官公庁など、厳格なコンプライアンスやガバナンスが求められる組織では、機密データを外部のクラウドに送信できないケースが多々あります。圧縮技術によって軽量化されたLLMを自社の閉域網内で運用できれば、データ漏洩のリスクを根本から排除しつつ、業務効率化や新しいサービスの創出を進めることができます。

精度とのトレードオフと運用上のリスク

一方で、モデル圧縮には注意すべきリスクも存在します。モデルを過度に軽量化すると、推論の精度が低下したり、もっともらしい嘘を出力する「ハルシネーション」が増加する傾向があります。特に、日本語は英語に比べて文字や単語の処理が複雑であるため、圧縮による文章理解力や表現力の劣化が顕著に表れる場合があります。実務に導入する際は、すべての業務に軽量化モデルを適用するのではなく、処理速度重視の単純作業には軽量モデルを、高度な論理的思考が必要な業務には高精度な大型モデルを使用するといった、適材適所のシステム設計が不可欠です。

日本企業のAI活用への示唆

第一に、モデル圧縮技術は、コストとセキュリティを両立させるための強力な手段となります。自社専用のLLMを運用するハードルが下がり、オンプレミスやエッジ環境でのAI活用がより現実的になります。

第二に、業務要件に応じたモデルの使い分けが重要です。自社の業務において許容できる精度の低下とインフラ制約を天秤にかけ、どの業務にどの規模のモデルを適用すべきかを見極める必要があります。

第三に、継続的な精度のモニタリング体制の構築です。運用開始後も、日本語特有のニュアンスの欠落やハルシネーションが発生していないかを監視し、必要に応じてモデルを再調整する運用基盤(MLOps)を整備することが、AIガバナンスの観点からも強く求められます。