LLMを低コストかつ高速に運用するための「量子化(軽量化)」技術が普及する一方で、モデル内部の「外れ値」が原因で深刻な精度劣化を引き起こすリスクが指摘されています。本記事では、最新の知見をもとに、日本企業がセキュアなローカルLLMなどを活用する際に押さえておくべき、コストと精度のトレードオフ管理について解説します。

LLMの社会実装に不可欠な「量子化」技術

近年、生成AIや大規模言語モデル(LLM)を自社の業務システムやプロダクトに組み込む日本企業が増加しています。特に、機密情報の漏洩リスクを考慮して、クラウドAPIではなく自社専用のオンプレミス環境やエッジデバイス上で「ローカルLLM」を稼働させたいというニーズは、日本の厳格なコンプライアンスや組織文化を背景に根強く存在します。ここで課題となるのが、LLMの膨大な計算コストとメモリ使用量です。

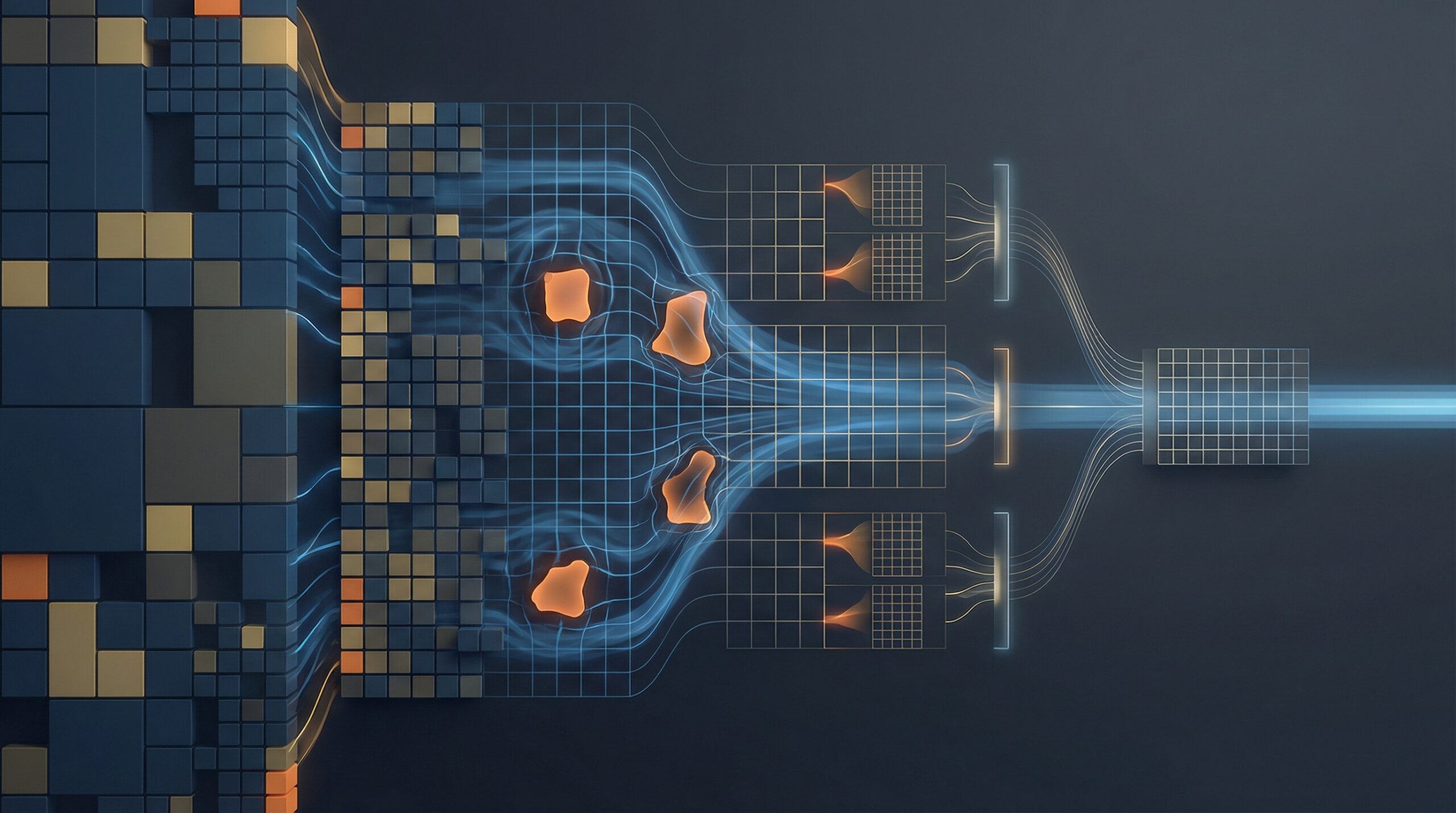

この課題を解決する技術として「量子化(Quantization)」が広く用いられています。量子化とは、モデルの計算に使う数値の精度(情報量)をあえて下げることで、モデルサイズを圧縮し、推論(AIが回答を生成するプロセス)を高速化する技術です。通常16ビットや32ビットで表現されるデータを8ビットや4ビットに圧縮することで、運用コストを大幅に削減できます。

量子化の精度を左右する「外れ値(Outliers)」の影響

一方で、量子化には「精度劣化」という避けられないリスクが存在します。データサイエンス領域で注目を集めている最新の解説記事などでも指摘されている通り、その精度の低下はモデル内部に存在する「外れ値(Outliers)」に大きく起因しています。

LLMの内部には数十億以上のパラメータ(重みや活性化値)が存在しますが、その中には極端に大きな値を持つ「外れ値」が少数ながら含まれています。単純な手法でモデル全体を一律に量子化(圧縮)してしまうと、この外れ値が持つ重要な情報が切り捨てられたり、歪められたりしてしまいます。結果として、LLMの推論能力が著しく低下し、文脈を無視した回答や不自然な言語生成を引き起こす原因となるのです。

日本語LLMにおけるリスクと最新の対策

日本企業が日本語に特化したLLMや多言語モデルを量子化して業務に利用する場合、この外れ値による影響には特に注意が必要です。日本語はトークン化(テキストをAIが処理できる最小単位に分割する処理)の構造が複雑であり、特定の文脈や敬語などのニュアンスを保持するために、一部の重要なパラメータに強く依存している可能性があります。業務効率化のための社内QAボットや、顧客向けのカスタマーサポートに組み込んだ際、量子化による精度劣化が致命的な誤案内につながるリスクも考慮しなければなりません。

この問題に対処するため、AI開発の現場では単純な量子化ではなく、外れ値を特定してそこだけは高い精度(16ビットなど)を保ち、それ以外の大部分を低精度(4ビットなど)に圧縮するような高度な量子化手法(LLM.int8()やAWQなど)が標準になりつつあります。実務においては、こうした最新手法を適切に選択できるエンジニアリング体制や、技術選定の知見が求められます。

日本企業のAI活用への示唆

LLMの量子化によるコスト削減は魅力的ですが、外れ値がもたらす精度劣化のリスクを理解し、適切にコントロールすることがプロジェクト成功の鍵となります。日本企業が実務でLLMを活用・運用する上での重要な示唆は以下の通りです。

第1に、コストと精度のトレードオフを可視化する「独自の評価パイプライン」を構築することです。量子化されたモデルを導入する際は、自社の実際の業務データ(過去の問い合わせ履歴や社内マニュアルなど)を用いて、量子化前後の回答精度を定量・定性の両面から検証するプロセスが不可欠です。

第2に、過度な軽量化(4ビット未満の極端な圧縮など)への依存を避けることです。インフラ投資を惜しむあまり、業務要件を満たせないレベルまでモデルを圧縮しては本末転倒です。必要に応じて、軽量化されたローカルモデルと、高精度なクラウドAPIのモデルをタスクの重要度によって使い分ける「ハイブリッド型」のアーキテクチャも有効な選択肢となります。

AIの民主化が進む中、モデルを動かすインフラの効率化は避けて通れません。技術のメリットと限界を冷静に見極め、自社のビジネス要件とガバナンス基準に合致した最適な運用方針を策定することが、意思決定者には求められています。