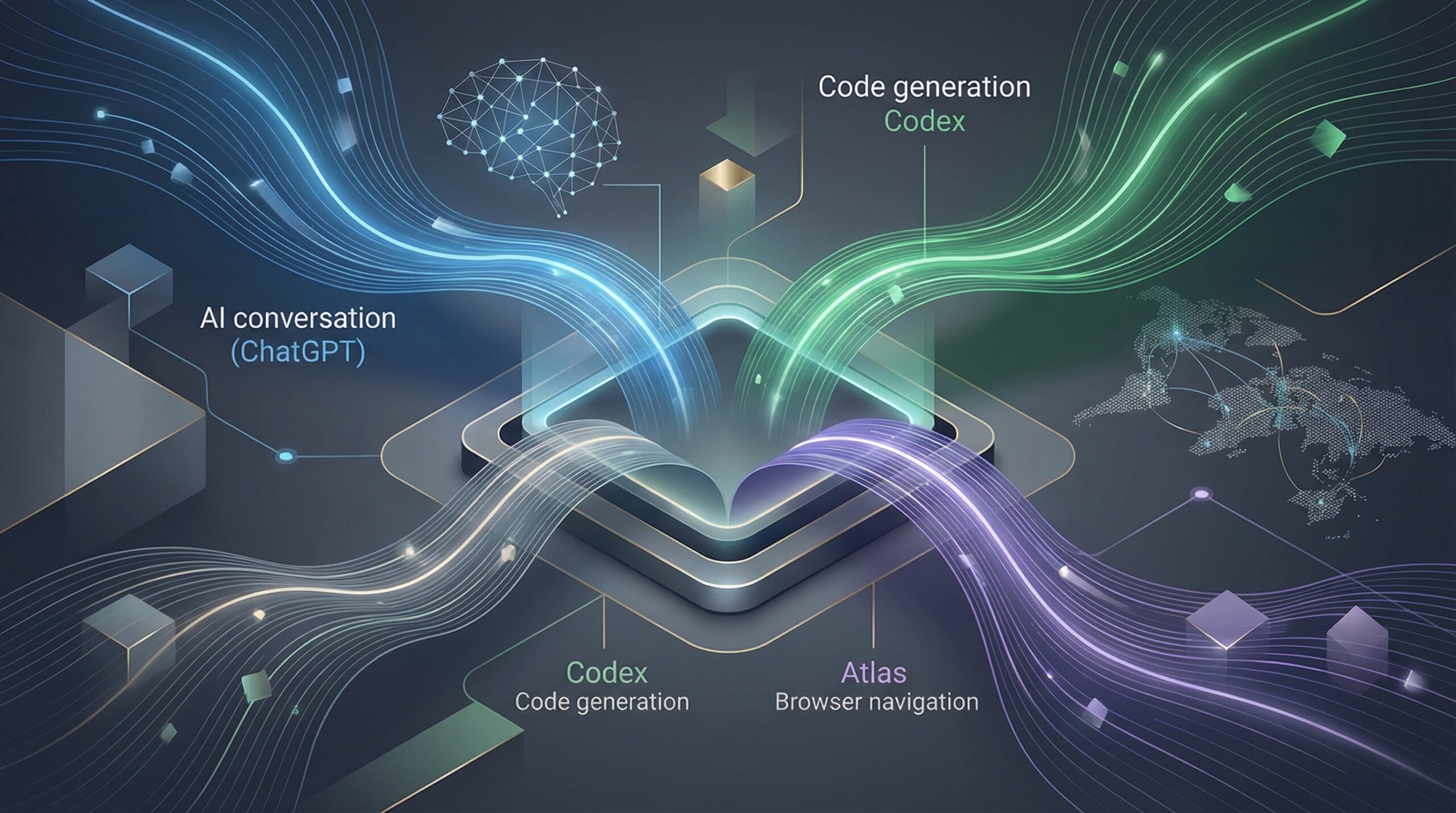

OpenAIが対話型AI「ChatGPT」、コード生成「Codex」、ブラウザ「Atlas」を統合した新アプリのローンチを計画しているとの報道がありました。この統合が日本企業の業務や開発現場にもたらす変革と、プラットフォーム化に伴うガバナンス上の留意点について解説します。

チャットから「統合プラットフォーム」への進化

海外メディアの報道によると、OpenAIは主力サービスである「ChatGPT」、プログラミング支援に特化した「Codex」、そしてWebブラウザ機能を持つとされる「Atlas」を統合した「スーパーアプリ」の開発を計画しています。Anthropicなど強力な競合他社が台頭する中、OpenAIは単なる対話型AIの提供にとどまらず、情報収集からコード実装、ドキュメント作成までをシームレスに行える統合プラットフォームへと舵を切ろうとしています。

この動きは、ユーザーが複数のツールをまたぐことなく、一つのインターフェース上で複雑な業務を完結できることを意味します。これまで「ChatGPTで要件をまとめ、別のエディタでコードを書き、さらにWebで最新の技術仕様を検索する」といった分断されていたプロセスが統合され、作業効率が飛躍的に向上する可能性があります。

日本企業の業務効率化とプロダクト開発へのインパクト

このスーパーアプリ構想は、日本国内の企業が推進するDX(デジタルトランスフォーメーション)や新規事業開発において、強力な追い風となるでしょう。たとえば、プログラミングの専門知識を持たない事業部門の企画担当者が、最新の市場データをブラウザ機能(Atlas)で収集しつつ、その分析や社内向けツールのプロトタイプ作成(Codex)を自然言語の対話(ChatGPT)を通じて実行できるようになります。

これにより、IT人材の慢性的な不足に悩む日本企業において、非エンジニアによる「業務の自動化」や「社内ツールのローコード開発」の敷居が大きく下がります。また、エンジニア組織にとっても、定型的なコーディングやAPI調査の時間が大幅に削減され、アーキテクチャ設計やシステムの品質保証といった、より高度な業務にリソースを集中できるようになります。

プラットフォーム化に伴うガバナンスとリスク管理

一方で、あらゆる業務が一つのアプリに集約されることは、情報セキュリティやAIガバナンスの観点から新たなリスクを生み出します。稟議プロセスが長く、ツールの導入に慎重な日本企業の組織文化に照らし合わせると、いくつかの懸念事項に事前に対処する必要があります。

第一に、機密情報や独自のソースコード、顧客データがAIの学習に利用されるリスクです。多様な機能が統合されることで、意図せず重要なデータがアプリ内に入力されてしまう可能性が高まります。第二に、生成されたコードや収集されたWebデータにまつわる著作権侵害のリスクです。日本国内の著作権法(特に機械学習時の権利制限規定)を踏まえつつも、生成物をそのまま商用プロダクトに組み込む際の法務チェックプロセスを確立することが求められます。

これらのリスクに対し、「とりあえず使用を全面禁止する」というアプローチは、企業の生産性向上を阻害し、かえってシャドーIT(会社が許可していないツールを従業員が隠れて使うこと)を誘発しかねません。むしろ、入力データが学習に利用されないエンタープライズ向け契約の導入を進め、安全に利用できる環境を従業員に公式に提供することが実務的な解決策となります。

日本企業のAI活用への示唆

OpenAIのスーパーアプリ化に向けた動きは、AIが単なる「便利なツール」から「企業活動のオペレーション基盤」へと進化しつつあることを示しています。日本企業がこの波を捉え、安全かつ効果的に活用するために、以下の3点に取り組むことをお勧めします。

1. 安全な利用環境の全社整備:前述の通り、法人向けライセンス契約(ChatGPT Enterpriseなど)を活用し、情報漏洩や学習利用リスクを根本から絶つ安全な環境を迅速に提供する。

2. 非エンジニア層へのAIリテラシー教育:コード生成やWeb検索の統合機能を十分に引き出すためには、業務要件を正確に言語化するスキルが不可欠です。事業部門に対するプロンプトエンジニアリングの基礎教育を体系化する。

3. AIガバナンスガイドラインの継続的なアップデート:機能が急速に統合・拡張されることを前提に、特定のツール名に依存するルールではなく、「どのようなデータなら入力してよいか」「生成物の権利と責任の所在はどうするか」という原則ベースでの社内ルールを整備・運用する。