世界のAI開発競争が激化する中、かつて優先されていた「安全性」が後回しにされつつあるという懸念が高まっています。グローバルな開発競争が「速度重視」へとシフトする現状は、AIを活用する日本企業にとって何を意味するのか。本記事では、海外の最新論調を踏まえつつ、日本企業が取るべきリスク管理とガバナンスのあり方を解説します。

「安全性」よりも「速度」が優先されるグローバルの現状

かつて、主要なAI開発企業は「責任あるAI(Responsible AI)」を最優先事項として掲げ、規制への協力姿勢をアピールしていました。しかし、ここ最近の風向きは明らかに変化しています。WIREDなどの海外メディアが指摘するように、開発競争が「軍拡競争(Arms Race)」の様相を呈するにつれ、リリースのスピードと性能向上が最優先され、安全性へのコミットメントが形骸化しつつあるという懸念が生じています。

この背景には、他社に先駆けて市場シェアを獲得したいという商業的な圧力に加え、国家間の技術覇権争いという地政学的な要因も絡んでいます。その結果、本来であれば数ヶ月かけて行うべき「レッドチーミング(攻撃者の視点で行う安全性テスト)」の期間が短縮されたり、安全対策チームの人員が縮小されたりといった事象が、シリコンバレーの一部で観測されています。

日本企業が直面する「輸入されたリスク」

多くの日本企業にとって、この動きは対岸の火事ではありません。国内のAI活用、特に生成AI(GenAI)の導入においては、OpenAIやGoogle、Microsoftといった米国の基盤モデルを利用するケースが大多数を占めます。開発元が「速度」を優先して安全性のガードレールを緩めた場合、そのリスクはそのまま利用企業である日本企業に「輸入」されることになります。

具体的には、以下のようなリスクが顕在化しやすくなります。

- ハルシネーション(もっともらしい嘘)の増加:十分なファインチューニングや事実確認プロセスを経ずにモデルがリリースされる可能性。

- バイアスと不適切発言:多様性や公平性に関するフィルタリングが不十分なまま、実務に投入されるリスク。

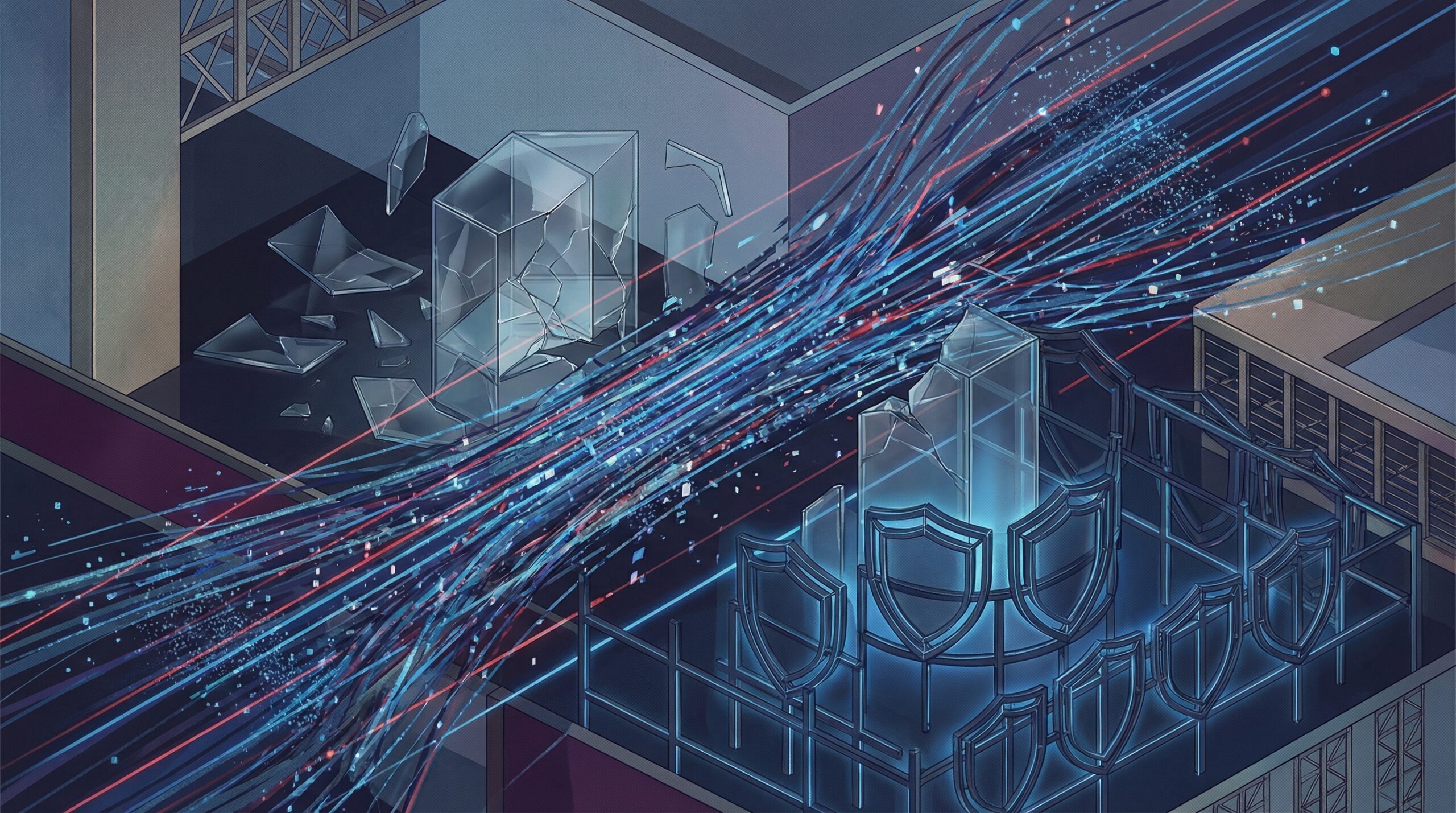

- セキュリティの脆弱性:プロンプトインジェクション(AIを騙して不適切な出力をさせる攻撃)への対策が後手に回る懸念。

日本企業の勝ち筋:厳格な品質評価と「人間中心」の運用

欧米がスピード重視で突き進む中、品質と信頼性を重んじる日本の商習慣は、一見するとAI活用における足かせのように見えるかもしれません。しかし、この「慎重さ」こそが、これからのフェーズでは強みになります。

モデル自体の安全性が100%保証されない前提に立つならば、企業は独自の「評価(Evaluation)」と「ガードレール」を構築する必要があります。単にAPIを繋いで終わりにするのではなく、RAG(検索拡張生成)技術を用いて社内規定に基づいた回答のみを許可する仕組みや、出力結果を日本国内のコンプライアンス基準で再チェックする中間層(ミドルウェア)の実装が不可欠です。

また、日本では「業務効率化」や「人手不足解消」がAI導入の主目的となることが多いですが、AIに全権を委ねるのではなく、「Human-in-the-loop(人間が判断プロセスに介在する)」体制を維持することが、結果として最大のリスクヘッジとなります。

日本企業のAI活用への示唆

グローバルのAI開発競争が過熱し、安全性が二の次になる可能性がある現状を踏まえ、日本の意思決定者やエンジニアは以下の3点を意識すべきです。

1. モデルプロバイダーへの過信を捨てる

「大手テック企業のモデルだから安全」という神話は崩れつつあります。基盤モデルはあくまで「部品」であり、完成品ではありません。自社のプロダクトや業務フローに組み込む際は、必ず自社の基準で徹底的な検証(ポイズニングテストやバイアス評価など)を行ってください。

2. 国内法規制とソフトローへの準拠

日本政府はAI事業者ガイドラインなどを通じて、リスクベースのアプローチを推奨しています。欧州のような厳格な罰則付き規制(ハードロー)ではありませんが、企業の社会的責任としてこれらのガイドラインに準拠することは、炎上リスクや法的責任を回避するための防波堤となります。

3. 「AIガバナンス」を経営課題に据える

AI活用は現場のツール導入レベルを超え、経営リスクに直結する課題です。法務、セキュリティ、事業部門が連携したAIガバナンス体制を構築し、「どこまでAIに任せ、どこから人間が責任を持つか」の境界線を明確に定義することが、持続可能なAI活用の鍵となります。