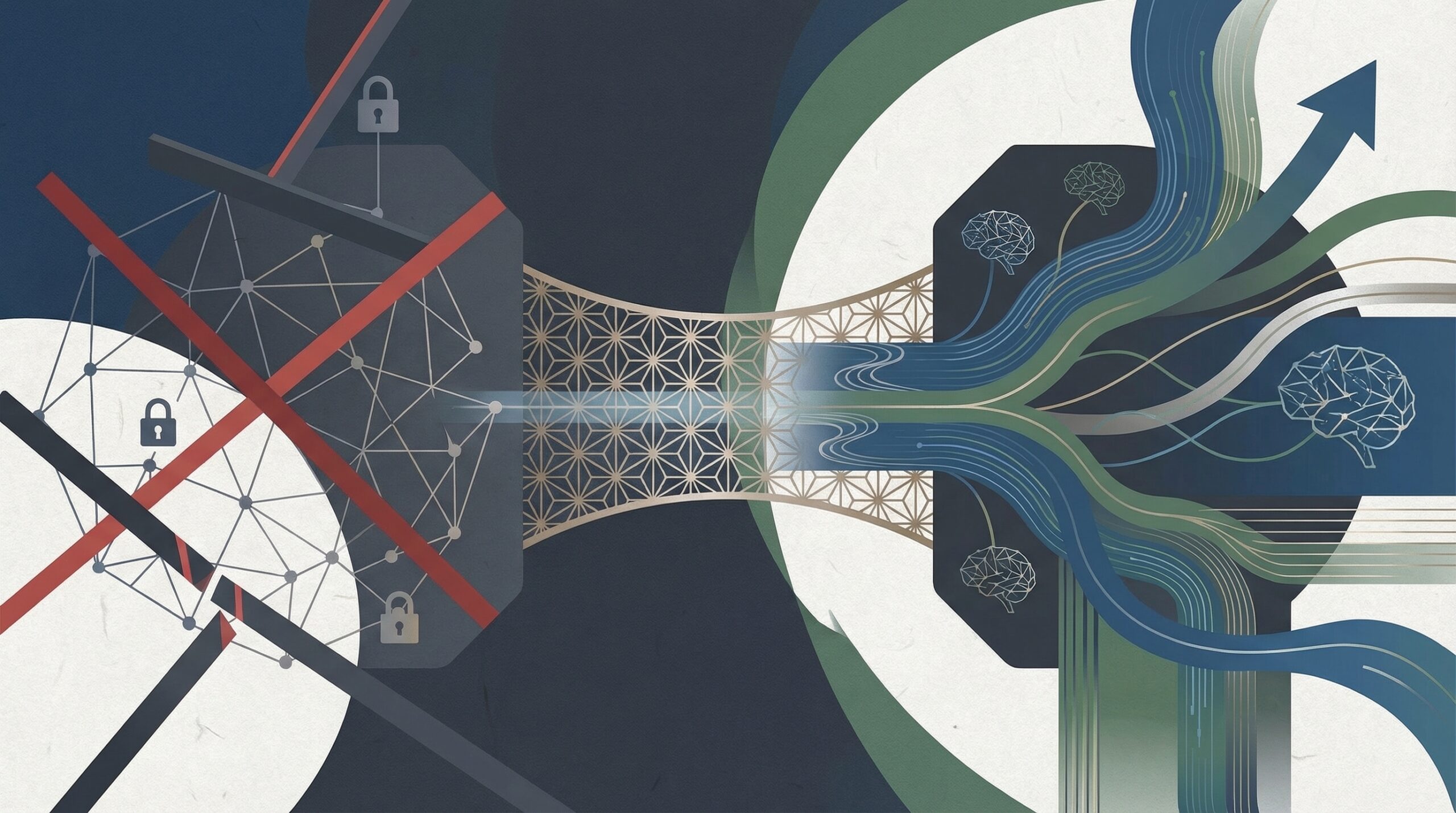

「セキュリティ上の懸念からChatGPTを削除・禁止する」という動きが、一部の海外組織や企業で見受けられます。しかし、イノベーションの源泉を完全に遮断することは、競争力の低下という別のリスクを招きます。本記事では、グローバルなセキュリティ懸念の背景を整理し、日本の法規制や組織文化に即した「禁止」ではない「安全な活用」への道筋を解説します。

「削除」に至るセキュリティ懸念の正体

「ChatGPTを削除する」「アクセスを禁止する」という判断が下される背景には、主に「入力データがAIモデルの再学習(トレーニング)に利用されることによる情報漏洩」への恐怖があります。初期のChatGPT(特にコンシューマー向けの無料版)では、ユーザーが入力したプロンプトがデフォルトでモデルの改善に使われる仕様であったため、機密情報や個人情報、独自のソースコードなどが意図せずAIの知識として取り込まれ、他社への回答として出力されるリスクが指摘されました。

実際に、グローバル企業の一部では、エンジニアがデバッグのために社外秘コードを入力してしまった事例などが報じられています。こうした事態を受け、防衛策として「利用禁止」や「アプリ削除」を選択する組織が現れるのは、リスク管理の観点からは一定の合理性があると言えます。

「全面禁止」が招くシャドーAIのリスク

しかし、日本企業が安易に「全面禁止」を選択することには慎重であるべきです。組織として公式にツールを提供・許可しない場合、従業員が業務効率化のために個人のスマートフォンや自宅のPCで生成AIを利用する「シャドーAI(Shadow AI)」のリスクが高まるからです。

シャドーAIの状態では、企業側が「誰が、どのようなデータを、どのサービスに入力したか」をログとして追跡することが不可能です。これは、管理された環境でAIを利用させるよりも、遥かに深刻なガバナンス上の欠陥となります。特に日本の組織文化では、現場が「良かれと思って」業務改善のためにツールを導入するケースが多く、禁止令だけでは実態を抑え込めないのが現実です。

コンシューマー版とエンタープライズ版の明確な区別

意思決定者やエンジニアが理解すべき重要な事実は、現在提供されているAIサービスの多くが「データを利用しない(オプトアウト)」設定や、エンタープライズ向けの契約を用意しているという点です。

OpenAIのAPI利用や、Azure OpenAI Serviceなどのクラウドベンダー経由での利用、あるいはChatGPT Enterpriseなどの法人向けプランでは、入力データがモデルの学習に使われないことが契約および技術仕様で保証されています。セキュリティ懸念の多くは「無料のコンシューマー版を、業務データをマスクせずに使った場合」に起因するものであり、適切なアーキテクチャと契約形態を選定すれば、リスクは大幅に低減可能です。

日本企業のAI活用への示唆

グローバルな「ChatGPT削除」のニュースを表層的に捉え、国内での活用を萎縮させるのは得策ではありません。日本企業が取るべきアクションは以下の通りです。

1. ツールではなく「データ」に着目したルール策定

「ChatGPTを使ってよいか」ではなく、「どのレベルの機密情報(個人情報、顧客データ、インサイダー情報等)を入力してよいか」というデータ区分に基づいたガイドラインを策定してください。日本の個人情報保護法や著作権法改正の文脈を踏まえ、社内弁護士や法務部門と連携したルール作りが求められます。

2. 安全な「サンドボックス」の提供

従業員の「使いたい」というニーズに応えるため、API経由で構築した社内専用チャットボットや、入力データが学習されないセキュアな環境を会社側が公式に提供することが、シャドーAI対策として最も有効です。

3. リテラシー教育の徹底

システム的なガードレール(PII除去フィルタなど)も重要ですが、最終的な防衛線は「人」です。生成AIが得意なこと・苦手なこと(ハルシネーションなど)、そして入力してはいけない情報について、継続的な教育を行うことが、組織全体のAI活用能力(AIリテラシー)を高めます。

結論として、「削除」ではなく「統制下の活用」こそが、人口減少による労働力不足に直面する日本企業にとっての解となるでしょう。