米国の政治的混乱の中で報じられた、国防総省によるAnthropic社製AI(Claude)の軍事利用疑惑。この事例は、国家レベルの禁止令ですら現場の技術利用を即座に制御できないという「ガバナンスの限界」と、民間AIモデルが抱える「デュアルユース(軍民両用)」のリスクを浮き彫りにしました。日本企業が海外製AIモデルに依存する際のリスク管理と、実効性のあるガバナンス体制について解説します。

民生用AIの軍事転用とベンダー方針の矛盾

報道によると、米軍がイランへの攻撃において、Anthropic社のAIモデル「Claude」を利用した可能性が指摘されています。ここで注目すべきは、Anthropic社が創業以来「Constitutional AI(憲法AI)」を掲げ、安全性や倫理、そして兵器利用の禁止を強く打ち出してきた企業であるという点です。

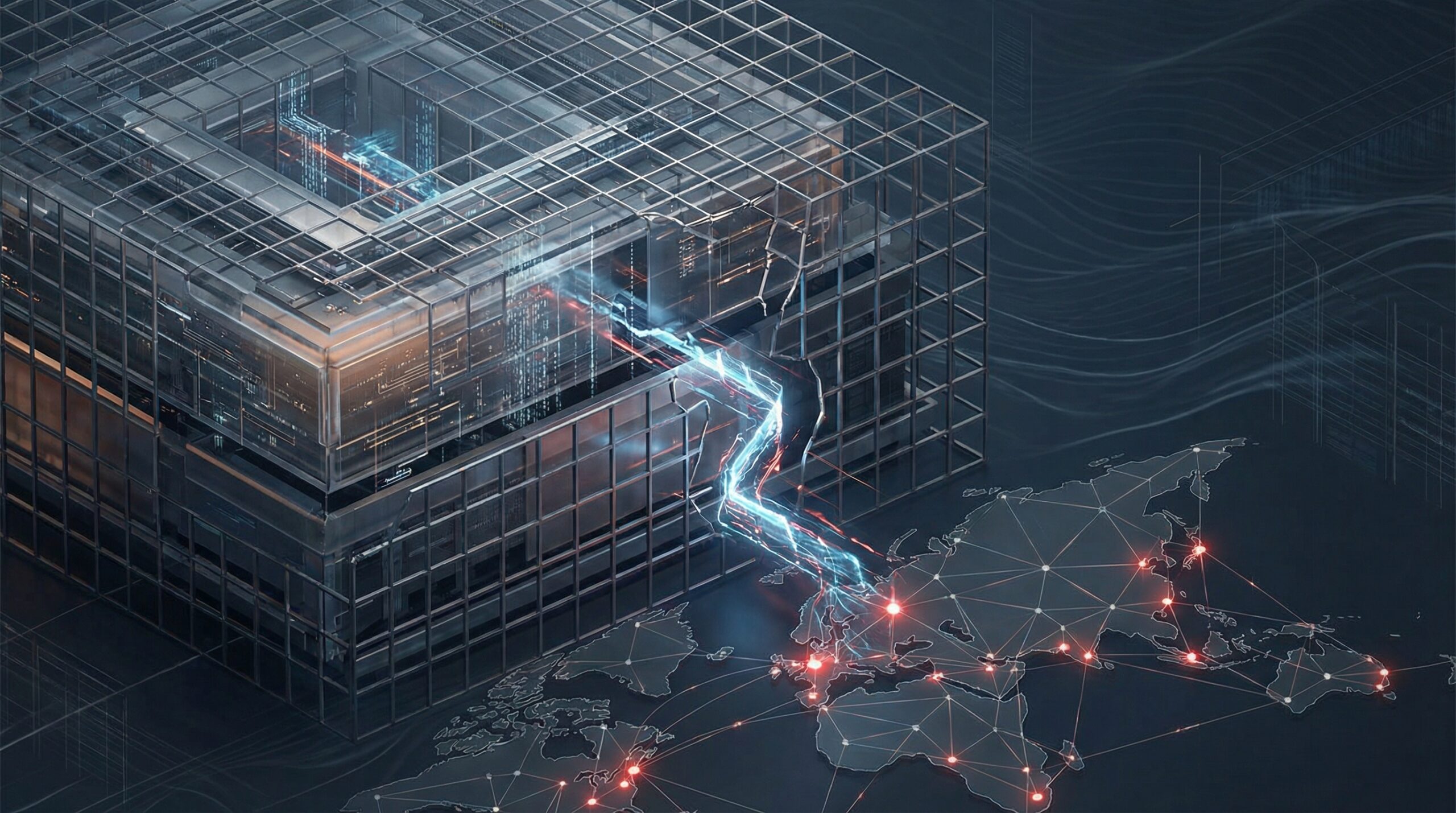

通常、生成AIの利用規約(AUP)では、生命に関わる判断や軍事攻撃への利用は厳格に禁止されています。しかし、API経由やローカル環境へのデプロイが進んだ現代のシステムにおいて、ベンダー側がすべての利用実態をリアルタイムで監視・遮断することは技術的に困難です。今回の事例は、いかにベンダーが高潔な理念を掲げていても、ユーザー側(この場合は軍)がその能力を「兵器」として組み込んでしまえば、事実上の軍事転用が可能であることを示唆しています。

トップダウンの禁止令と「シャドーAI」の現実

さらに衝撃的なのは、この利用が「トランプ政権によるAnthropic禁止令」の直後に行われたとされている点です。これは企業ガバナンスの観点から非常に深刻な問題を提起しています。

組織の意思決定者(大統領や経営層)が「特定ツールの使用禁止」を通達しても、現場のオペレーションやシステムに深く組み込まれたAIを即座に排除することは極めて困難です。日本企業においても、経営層が「セキュリティ懸念から〇〇の使用を禁止する」と決めたにもかかわらず、現場部門が業務効率を優先して無断で使い続ける「シャドーAI」の問題が頻発しています。今回の米軍の事例は、物理的な兵器システムとAIが一度統合されてしまうと、政治的な決定だけではシステムを停止できないという「技術的負債」と「依存の深さ」を物語っています。

日本企業における「経済安全保障」としてのAI選定

このニュースは、日本企業にとっても対岸の火事ではありません。現在、国内の多くの企業がOpenAIやAnthropic、Googleなどの米国製モデルを基盤としてサービス開発や業務効率化を進めています。しかし、米国の政治情勢や規制方針が変われば、ある日突然、特定のAIベンダーが利用できなくなったり、逆に軍事利用の論争に巻き込まれたりするリスクがあります。

特に金融、インフラ、ヘルスケアなどの重要産業においては、単一の海外ベンダーに依存することは、事業継続計画(BCP)上の重大なリスクとなり得ます。米国政府の方針転換一つでAPIが停止する、あるいはブランド毀損のリスクが生じる可能性を考慮し、マルチモデル対応や国産LLMの併用といった「AIのサプライチェーン多重化」が求められるフェーズに入っています。

日本企業のAI活用への示唆

今回の事例から、日本のビジネスリーダーやエンジニアが学ぶべき教訓は以下の通りです。

1. ガバナンスは「通達」ではなく「技術的制御」で行う

「禁止」と口で言うだけではAIの利用は止まりません。APIキーの集中管理、ゲートウェイによるプロンプト監視、MLOps基盤での利用ログの可視化など、システム的にガバナンスを効かせる体制が必要です。

2. 特定ベンダーへのロックイン回避とBCP策定

海外の政治的・法的不確実性に備え、LangChainなどのオーケストレーションツールを活用し、バックエンドのLLMを柔軟に切り替えられるアーキテクチャを採用することを推奨します。また、機密性の高い業務には、自社環境で動作するオープンソースモデルや国産モデルの活用も検討すべきです。

3. 利用規約(AUP)違反リスクの再点検

自社が開発するプロダクトが、意図せずAIベンダーのAUPに抵触していないか、あるいはエンドユーザーが悪用可能な状態になっていないかを確認する必要があります。ベンダー側からAPIを停止されるリスク(バン・リスク)は、サービス停止に直結するためです。