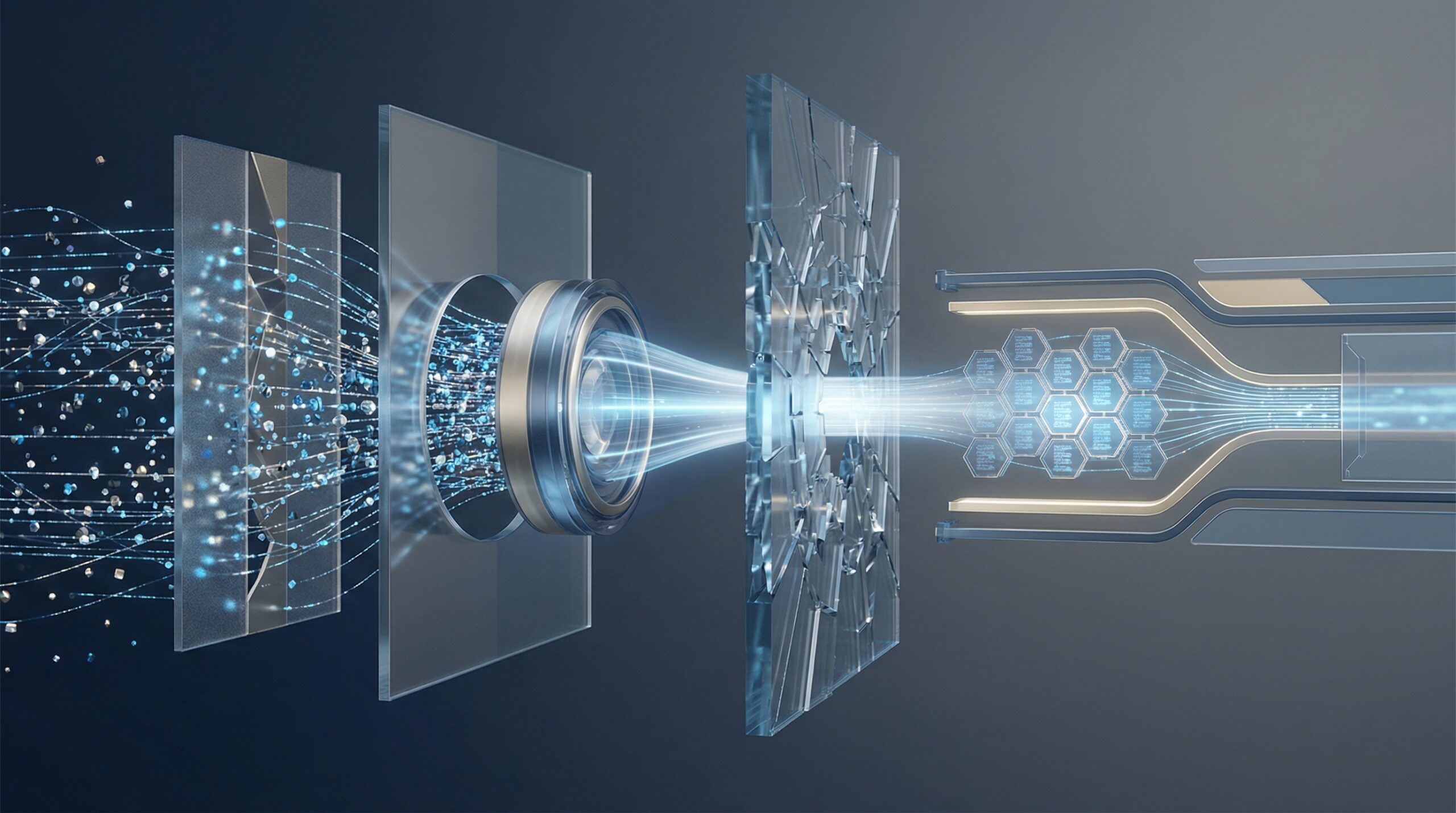

国内企業でもRAG(検索拡張生成)の実装が進む中、「回答精度が上がらない」「運用コストが想定より高い」という課題が浮き彫りになっています。本稿では、RAGの失敗要因の多くがLLMそのものではなく「検索(Retrieval)」プロセスにあるという事実に基づき、実務的な解決策としての「セマンティックキャッシュ」導入と、継続的なMLOpsの重要性について解説します。

RAGの失敗は「生成」ではなく「検索」で起きている

生成AIの導入において、多くの日本企業が自社データを活用するためにRAG(Retrieval-Augmented Generation)アーキテクチャを採用しています。しかし、PoC(概念実証)から本番環境へ移行する段階で、「期待した回答が得られない」という壁に直面するケースが後を絶ちません。

HackerNoonの記事でも指摘されているように、RAGの失敗の多くは、LLM(大規模言語モデル)の推論能力不足ではなく、「検索(Retrieval)」の品質に起因しています。具体的には以下の4点が主なボトルネックとなります。

- 不適切なチャンキング(Bad Chunking): 文脈を分断する形でテキストを分割してしまい、LLMに必要な情報が届かない。特に日本語はトークン区切りが難しく、文脈を考慮した分割設計が不可欠です。

- メタデータの不足(Weak Metadata): 日付、部署、文書種別などのタグ付けが不十分で、適切なフィルタリングができず、ノイズの多い情報を参照してしまう。

- エンベディング・ドリフト(Embedding Drift): 時間経過やモデルの変更により、ベクトルの意味空間がズレてしまい、検索精度が低下する現象。

- インデックスの陳腐化(Stale Indexes): 最新の社内規定やマニュアルが反映されず、古い情報に基づいて回答してしまう。

「モデルをGPT-4などの高性能なものに変えれば解決する」と考えがちですが、ゴミを入力すればゴミが出力される(Garbage In, Garbage Out)という原則は変わりません。まずはデータ前処理と検索ロジックの見直しが先決です。

コストとレイテンシを劇的に改善する「セマンティックキャッシュ」

RAGの実運用において、もう一つの大きな課題が「コスト」と「レイテンシ(応答速度)」です。毎回LLMに問い合わせを行うと、API利用料が嵩むだけでなく、ユーザーを待たせる時間が長くなります。ここで有効なのが「セマンティックキャッシュ(意味的キャッシュ)」の導入です。

従来のキャッシュシステムは「完全に一致する質問」に対してのみキャッシュを返していましたが、AI活用においては、ユーザーが「経費精算の方法は?」と聞くこともあれば、「交通費はどう申請する?」と聞くこともあります。これらは表現が異なりますが、意図(意味)は同じです。

セマンティックキャッシュは、質問の意味(ベクトル)が類似している場合に、過去の生成結果を再利用する仕組みです。これにより、以下のメリットが生まれます。

- コスト削減: LLMへのAPIリクエスト回数を減らし、従量課金コストを抑制できる。

- 高速化: LLMの推論をスキップできるため、瞬時に回答を提示できる。

- 回答の一貫性: 同じような質問に対して、揺らぎのない統一された回答を提供できる(ガバナンスの観点からも重要)。

特に社内ヘルプデスクや定型業務のサポートなど、似たような質問が繰り返されるユースケースでは、セマンティックキャッシュの実装はROI(投資対効果)を最大化する鍵となります。

ベクトルデータベースの「鮮度」と運用上のリスク

一方で、キャッシュや検索インデックスにはリスクも伴います。最大の懸念点は情報の「鮮度」です。元記事でも「Stale Indexes(陳腐化したインデックス)」が指摘されていますが、例えば社内規定が改定されたにもかかわらず、キャッシュや検索用データベースが古いままでは、AIは自信満々に嘘(古いルール)を回答してしまいます。

日本企業、特に金融や製造業などコンプライアンスが重視される業界では、誤情報は致命的です。そのため、以下のMLOps(機械学習基盤の運用)的なアプローチが必要になります。

- キャッシュの無効化戦略: 元データが更新された際、即座に関連するキャッシュを破棄する仕組み。

- 定期的な再インデックス: データの追加・更新に合わせてベクトルデータベースをメンテナンスするパイプラインの構築。

- ドリフト検知: 検索精度が時間の経過とともに落ちていないか、定期的に評価セットを用いてテストする。

日本企業のAI活用への示唆

以上のグローバルトレンドと技術的な課題を踏まえ、日本の意思決定者やエンジニアは以下の点に留意してプロジェクトを進めるべきです。

1. LLM選びより「データ整頓」への投資を

魔法のようなモデルを探すよりも、日本語特有の文書構造(PowerPointが多い、縦書き・横書き混在など)を正しくテキスト化し、意味のある単位で分割(チャンキング)する前処理エンジニアリングにリソースを割くべきです。

2. キャッシュ戦略を初期設計に組み込む

サービス開始後に「コストが高いから」と後付けでキャッシュを検討するのではなく、設計段階からセマンティックキャッシュを導入し、ランニングコストと応答速度の目標値を設定してください。

3. 「回答の責任」を担保する運用体制

RAGはシステムを作って終わりではありません。データが古くなっていないか、キャッシュが誤った情報を返し続けていないかを監視する運用体制(Human-in-the-loop)が、日本企業が求める「安心・安全なAI」には不可欠です。