生成AIの活用は、単なる対話型から自律的にタスクを遂行する「AIエージェント」へと急速に進化しています。これに伴い、AIが社内システムや外部サービスと連携する際のセキュリティリスクも増大しています。本稿では、AIエージェントに固有のIDを付与し、既存のAPI管理基盤を用いて統制を行う最新のアプローチについて、日本企業のシステム環境やガバナンス要件に即して解説します。

「チャット」から「エージェント」への進化とリスクの変質

生成AIの利用形態は、人間が入力したプロンプトに対して回答を返すだけの「チャットボット」から、人間の指示に基づいて自律的に外部ツールを使いこなし、タスクを完遂する「AIエージェント」へとシフトしています。例えば、顧客からの問い合わせ内容を分析し、在庫管理システムを検索し、適切な発送手続きをAPI経由で実行するといった一連の動作です。

この進化は業務効率化の観点で大きなメリットをもたらしますが、同時にセキュリティリスクの質を大きく変えます。これまでは「誤った情報を出力する(ハルシネーション)」が主な懸念でしたが、エージェント化により「誤った(あるいは悪意ある)操作を実行してしまう」というリスクが顕在化します。もしAIが不適切な権限で社内データベースにアクセスしたり、意図しない外部送金APIを叩いたりすれば、その被害は甚大です。

AIエージェントを「First-Class Identity」として扱う

こうしたリスクに対し、API管理やアイデンティティ管理の分野でグローバルに展開するWSO2などのプレイヤーは、AIエージェントをシステム上の「First-Class Identity(第一級のアイデンティティ)」として扱うアプローチを提唱しています。

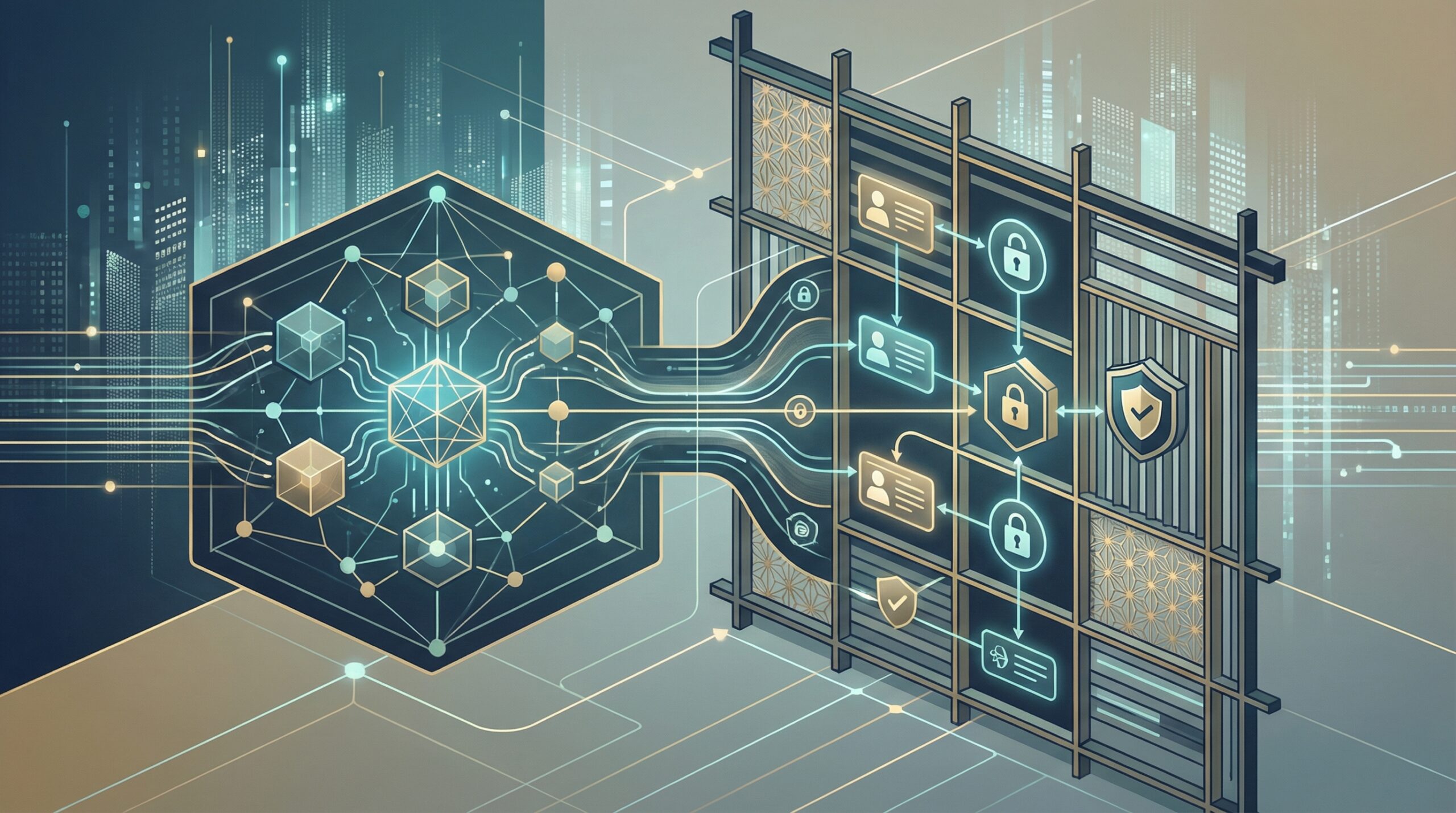

これは、AIエージェントを「ユーザーの代理」として曖昧に扱うのではなく、AIそのものに固有の「ID(身分証明)」を発行し、従業員と同様に認証・認可のプロセスを経させるという考え方です。具体的には、AIエージェントがシステムにアクセスする際、以下の制御を行います。

- 個別のID付与:どのAIエージェントがアクセスしているかを明確に識別する。

- 最小権限の原則:そのエージェントが遂行するタスクに必要なAPIやデータへのアクセス権のみを付与する。

- トレーサビリティ:「誰(どのAI)」が「いつ」「何をしたか」をログとして記録する。

APIゲートウェイを「AIの統制点」として再利用する

日本企業の多くは、すでにDX(デジタルトランスフォーメーション)の一環として、社内外のシステム連携のためにAPIゲートウェイやAPI管理基盤を導入しています。AIガバナンスにおいて、この既存資産が強力な武器になります。

AIエージェントの振る舞いは、技術的に見れば「APIコールの連続」です。したがって、既存のAPIゲートウェイを通過させることで、流量制限(レートリミット)、認証、アクセス制御といった従来のセキュリティポリシーをAIにも適用できます。これにより、AI専用の新しい高価なセキュリティツールをゼロから導入せずとも、既存のインフラを拡張する形で、現実的かつ堅牢なガバナンスを構築できる可能性があります。

日本企業のAI活用への示唆

グローバルの潮流と日本の実務環境を照らし合わせると、今後日本企業がAIエージェントを導入する際には、以下の3点が重要な意思決定ポイントとなります。

1. AIに対する「ID管理」の整備

日本企業は厳格な職務分掌やID管理の文化を持っています。AIを導入する際も、AIを「得体の知れないブラックボックス」として特別扱いするのではなく、「デジタル従業員」として定義し、既存のID管理システム(IDaaSなど)に組み込むことを検討すべきです。これにより、J-SOX(内部統制報告制度)などの監査対応もスムーズになります。

2. 既存のAPI基盤の活用

AI活用基盤を更地に構築するのではなく、自社が持つAPIゲートウェイ環境がAIエージェントの制御(ガードレール)として機能するかを確認してください。APIレベルでの制御は、プロンプトインジェクションによってAIが騙された場合でも、最終的なシステム実行段階で不正アクセスを食い止める「最後の砦」となります。

3. 「人とAI」の責任分界点の設計

技術的な制御に加え、業務フロー上での承認プロセスも重要です。決済や個人情報へのアクセスなど、クリティカルな操作については、AIが準備までを行い、最終実行は人間が承認するといった「Human-in-the-loop(人間が介在する)」設計を、APIの権限設定とセットで実装することが推奨されます。