自律型AIエージェントの業務導入が進む中、複数のAIが同時に稼働することで生じる「エージェント衝突(Agent Collision)」という新たな課題が浮上しています。本記事では、この衝突問題の背景やその技術的な解決策を紐解きながら、日本企業が安全かつ効果的にAIエージェントを運用するためのガバナンスや実務的なポイントを解説します。

自律型AIエージェントの普及と「マルチエージェント」の現実味

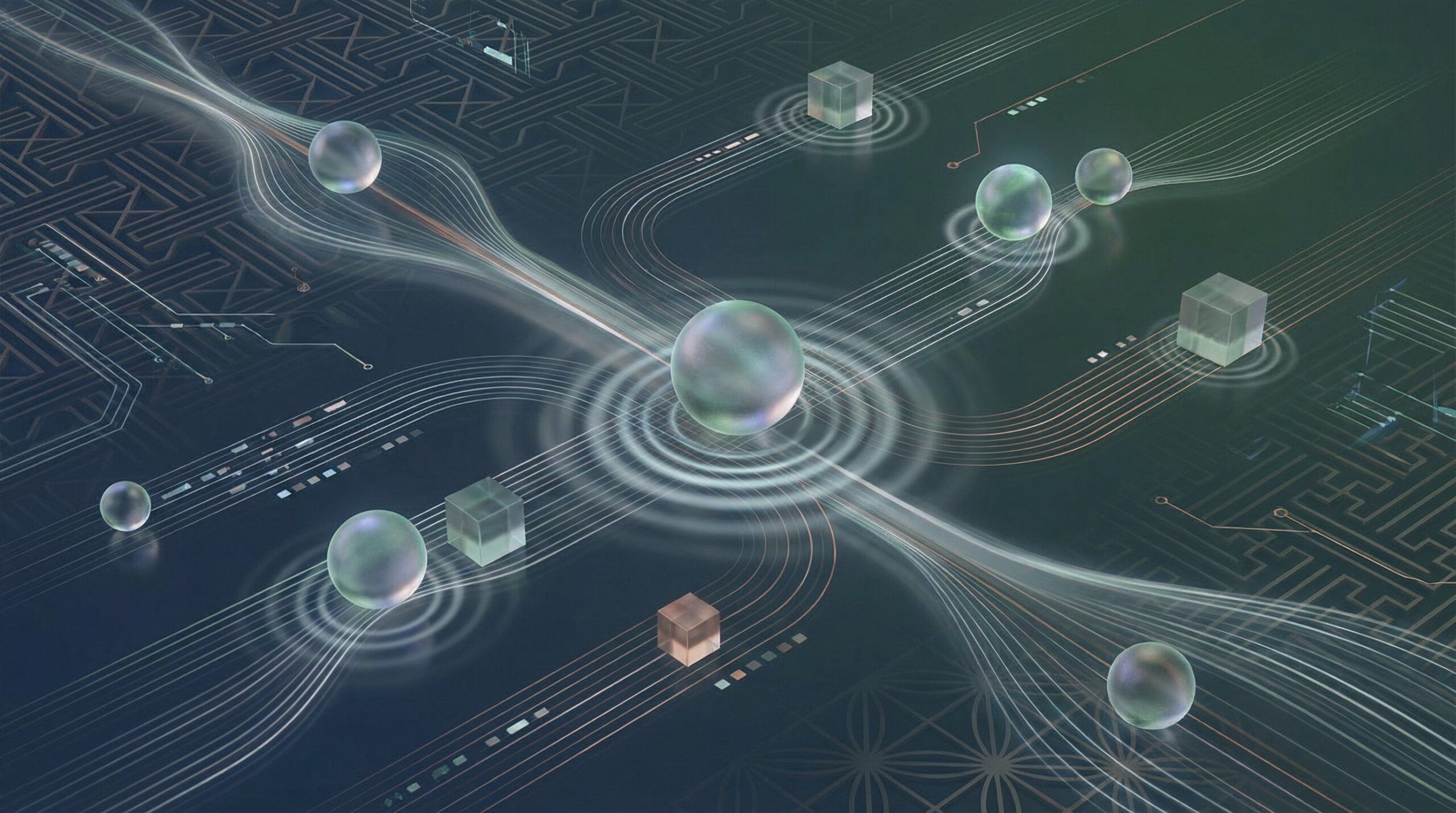

大規模言語モデル(LLM)の進化により、AIは単なるチャットボットから、ユーザーに代わって自律的にリサーチやシステム操作などを行う「AIエージェント」へと進化を遂げています。たとえば、あるエージェントが競合調査を行い、別のエージェントがデータ分析を並行して実行するといった、複数のAIが同時に稼働する「マルチエージェント」の環境が現実のものとなりつつあります。米国のテックメディアの記事でも、近い将来、1台のワークステーション上で数十ものAIエージェントが並列稼働するシナリオが描かれています。

新たな技術的課題「エージェントの衝突」とは

しかし、複数のAIエージェントが同じシステム環境下で自律的に動作するようになると、新たな問題が発生します。それが「エージェントの衝突(Agent Collision)」です。例えば、複数のエージェントが同じ画面(GUI)やマウス、キーボードのコントロールを奪い合ったり、同じファイルやアプリケーションに同時にアクセスして処理を競合させたりするリスクです。日本のオフィスで広く普及しているRPA(ロボティック・プロセス・オートメーション)であれば、事前に厳密に定義されたシナリオ通りに動くため制御が容易でした。しかし、状況に応じて柔軟に動くAIエージェントの場合、予期せぬ干渉による業務プロセスの停止やエラーが深刻な影響をもたらす可能性があります。

環境分離による解決アプローチの台頭

この課題に対し、海外では「Screenbox」に代表されるような新たなアプローチが注目されています。これは、各AIエージェントに独立した画面(スクリーン)や仮想環境を割り当て、エージェント同士の物理的・ソフトウェア的な干渉を防ぐ技術です。コンテナ技術や仮想化技術を応用し、エージェントごとに隔離された安全な実行環境(サンドボックス)を構築することで、互いに干渉することなく並列処理を可能にします。こうした仕組みは、効率的なタスク実行を支えるだけでなく、システムリソースの競合を防ぐ意味でも非常に重要です。

日本企業に求められるガバナンスとセキュリティの視点

日本企業がAIエージェントを実務やプロダクトに組み込む際、この「実行環境の分離」は単なる技術的な利便性にとどまらず、ガバナンスやコンプライアンスの観点からも極めて重要です。日本の組織文化では、権限の厳格な管理や、インシデント発生時の責任の所在(監査対応)が強く求められます。複数のAIが同じ環境で混在して動くと、「どのAIがどのデータを参照し、どのような操作を行ったのか」を追跡(トラッキング)することが困難になり、情報漏洩や不正アクセスの温床になりかねません。したがって、各エージェントの実行環境を分離し、それぞれに適切なアクセス権限を付与するとともに、独立した監査ログの仕組みを設けることが、セキュアなAI運用の大前提となります。

日本企業のAI活用への示唆

AIエージェントを活用し、業務効率化や新規事業開発を推進するにあたり、日本企業の実務担当者や意思決定者は以下のポイントを意識することが求められます。

第一に、複数エージェントの並列稼働を前提としたインフラ設計です。AIの自律性が高まるほど、エージェント同士の干渉やシステムへの過負荷が懸念されます。PoC(概念実証)の段階から、仮想環境の活用やエージェントごとの独立したリソース割り当てを検討すべきです。

第二に、従来のRPAとAIエージェントの性質の違いを理解したガバナンスの構築です。柔軟な判断ができるAIエージェントは強力ですが、予期せぬ挙動へのフェイルセーフが必要です。エージェントごとにアクセス可能なデータや操作権限を最小限に絞り込む「ゼロトラスト」の考え方を取り入れることが推奨されます。

第三に、業務プロセス全体の再設計です。AIエージェントの導入は単なる作業の代替ではなく、人間と複数のAIが安全に協調する新しい働き方を意味します。日本企業の強みである緻密な業務フローとAIの自律性をいかに組み合わせるか、安全かつスケーラブルな環境作りが今後の競争力に直結するでしょう。