GitHub Copilot CLIが独自のAPIキー(BYOK)やローカル環境で稼働するLLMの利用に対応しました。本記事では、このアップデートが日本企業の開発現場にもたらすセキュリティやコスト管理のメリットと、実務導入における注意点を解説します。

開発現場におけるAI活用のジレンマとCLIツール

エンジニアの開発体験を向上させるツールとして、コーディング支援AIの導入が進んでいます。近年では、エディタ上でのコード補完にとどまらず、CLI(コマンドラインインターフェース:テキストベースでOSに命令を送る画面)上でのコマンド生成やエラー解決をAIが支援する機能も普及しつつあります。

しかし、日本企業、特に金融機関や製造業、あるいは大規模なシステム開発を担うSIerにおいて、ターミナル環境でのAI活用には高いハードルがありました。ターミナルの実行履歴やエラーログには、社内システムの構成情報や機密性の高い環境変数が含まれることが多く、これらを外部のAIプロバイダーに送信することへのセキュリティ・コンプライアンス上の懸念が根強いためです。

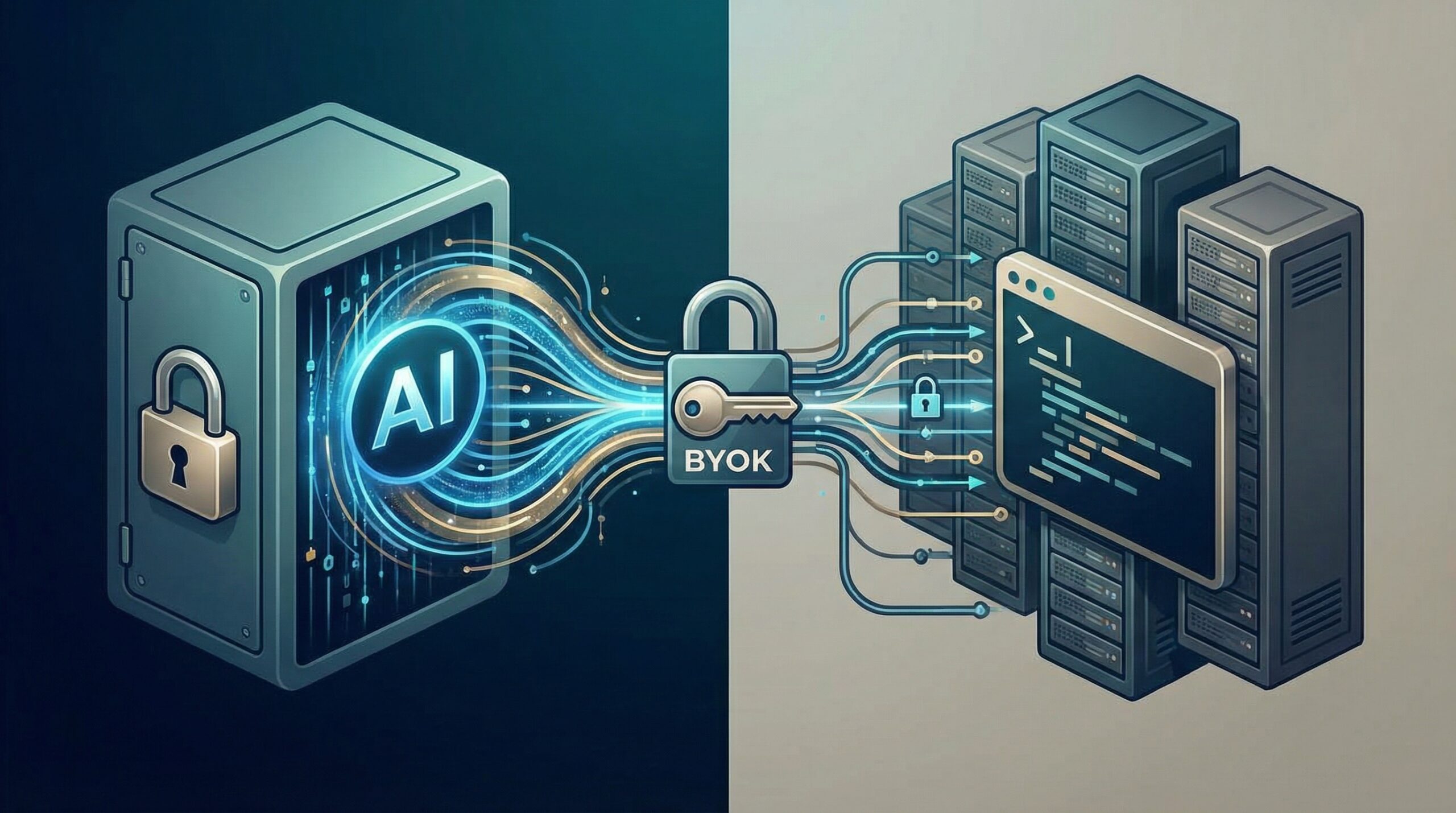

BYOK(Bring Your Own Key)によるガバナンスとコストの最適化

今回のアップデートで注目すべき機能の一つが、BYOK(Bring Your Own Key:利用者が自ら契約したAPIキーを持ち込んで利用する仕組み)への対応です。これにより、開発者はCLI上でAzure OpenAIやAnthropicなど、任意のモデルプロバイダーを設定・接続できるようになりました。

日本企業にとって、このメリットは非常に大きいです。多くの企業では、すでに社内データがAI学習に二次利用されない閉域網ライクな環境(Azure OpenAI Serviceなど)を構築し、厳しい社内セキュリティ審査を通過させています。BYOKを利用すれば、この「すでにガバナンスが効いているセキュアなAI環境」をそのままCLIツールでも利用できるため、新たなセキュリティ審査のプロセスを大幅に短縮できます。また、プロジェクトの予算や用途に応じて利用するモデルを柔軟に切り替えることで、LLM(大規模言語モデル)のコスト管理を最適化することも可能になります。

ローカルモデル対応が拓く、高機密環境でのAI支援

もう一つの重要なアップデートが、ローカルモデル(開発者のPCなどの端末内で直接稼働し、外部通信を必要としないAIモデル)のサポートです。

外部ネットワークへの接続が厳しく制限された開発環境や、絶対に情報を外に出せない極秘プロジェクトにおいて、これまではAIの恩恵を諦めざるを得ないケースが多々ありました。しかし、ローカルモデルを活用すれば、端末内で処理が完結するため、情報漏洩のリスクを根本から排除した上でAIによる開発支援を受けることができます。

一方で、実務上の限界も理解しておく必要があります。ローカルモデルの性能は実行するPCのハードウェアスペックに大きく依存します。また、クラウド上で提供される最先端の巨大モデルと比較すると、推論の精度や対応できる複雑なタスクの幅において劣る場合があるため、用途を絞った利用や過度な期待のコントロールが求められます。

日本企業のAI活用への示唆

今回のアップデートを踏まえ、日本企業が開発現場へのAI導入を進める上での要点と実務への示唆を以下に整理します。

第1に、適材適所でのモデル選択とガバナンス方針のアップデートです。すべての開発環境を一律のルールで縛るのではなく、「一般的な開発にはコスト効率の良いモデル」「機密性の高い環境では社内管理のクラウドモデルやローカルモデル」といった形で、リスクベースのアプローチによる柔軟なガイドラインを策定することが重要です。

第2に、BYOK運用に伴うAPIキー管理の徹底です。開発者個人の端末や環境にAPIキーを設定することになるため、キーのハードコード(ソースコード内に直接書き込むこと)の禁止や、漏洩時の迅速な無効化・ローテーションの仕組みといった、運用面のセキュリティ対策がこれまで以上に不可欠となります。

AI技術の進化は、単に「より賢くなる」だけでなく、今回のように「より安全に、より自社の統制下で柔軟に使えるようになる」方向にも進んでいます。自社の組織文化や厳格なセキュリティ要件を理由にAI導入を見送っていた企業にとっても、こうしたアーキテクチャの変化を捉え、安全な範囲から小さく検証を始めていくことが、開発競争力を高めるための第一歩となるでしょう。