ChatGPTやGeminiなど、用途に応じて複数のAIモデルを使い分ける「マルチLLM」の概念が定着しつつあります。複数モデルを一つのプラットフォームで統合管理する最新トレンドを踏まえ、日本企業が直面するガバナンスの課題やコスト最適化、実務への組み込み方について解説します。

LLMの多様化と「単一モデル依存」のリスク

生成AIの進化は著しく、OpenAIのChatGPTをはじめ、GoogleのGemini、AnthropicのClaude、さらにはGrokやオープンソースのモデルなど、企業が利用できる大規模言語モデル(LLM)の選択肢は急速に広がっています。初期のAI導入では特定のモデルに依存するケースが多く見られましたが、実務への実装が進むにつれて「単一モデル依存」のリスクが浮き彫りになってきました。

特定のプロバイダーに依存(ベンダーロックイン)していると、サービス障害時の業務停止リスクや、価格改定によるコスト増に直面する可能性があります。また、モデルごとに「日本語の自然さ」「論理的推論」「処理速度」「コスト」といった強みが異なるため、単一のモデルですべての業務要件を満たすことは困難になりつつあります。

マルチLLMを一元管理するプラットフォームの台頭

こうした課題を背景に、海外を中心に「複数のAIモデルを一つの場所で利用・管理できるプラットフォーム」が注目を集めています。例えば、米国のテックメディアでも紹介されている「1min.AI」のようなツールは、ChatGPTやGemini、その他のモデルを単一のインターフェースに統合して提供しています。

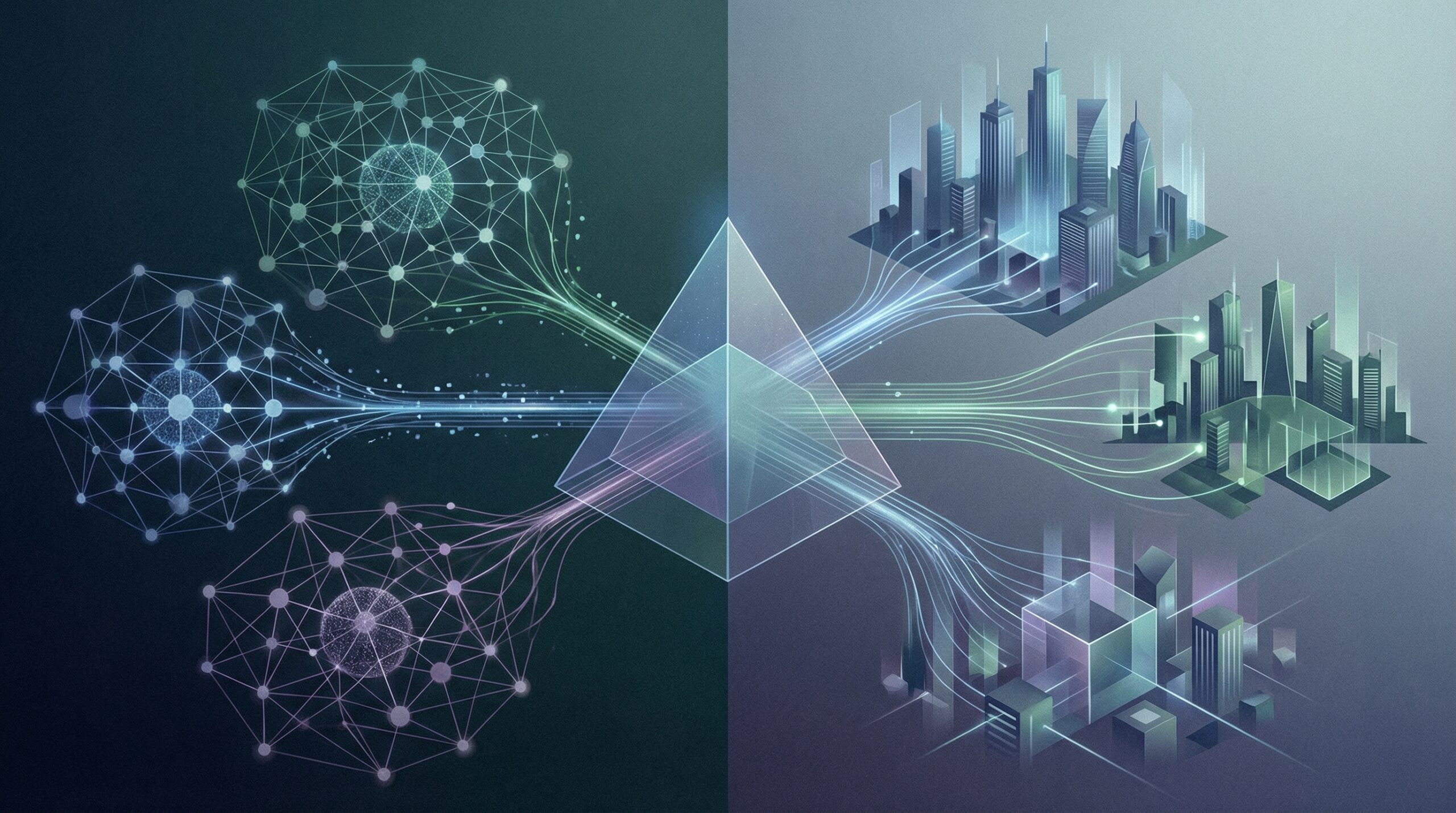

企業がこうした統合型ツールやAPIゲートウェイを導入することで、ユーザーは用途に合わせて最適なモデルをシームレスに切り替えることが可能になります。自社のプロダクト開発においても、複雑な推論用には高度なモデルを採用し、ユーザーへの迅速な応答(チャットボットの一次受けなど)には軽量モデルを割り当てる「マルチLLMアーキテクチャ」が標準的な手法となりつつあります。

日本企業における活用メリットとガバナンス

日本国内でAI活用を進める企業にとって、マルチLLM環境の一元管理は、「現場の利便性向上」と「ガバナンス強化」の両面で大きなメリットをもたらします。

第一に、シャドーAI(会社が許可していないAIツールを従業員が業務で使ってしまうこと)の抑止です。従業員が最新のAIモデルを使いたいがために、個人のアカウントで機密情報を入力してしまうリスクは、多くの日本企業が抱える切実な課題です。複数の最新モデルを社内のセキュアな単一プラットフォームで提供できれば、現場の不満を解消しつつ、情報漏洩リスクをコントロールできます。

第二に、コストの最適化です。社内文書の要約や定型的な翻訳といった日常業務には軽量で安価なモデルを割り当て、新規事業の企画立案や複雑なコード生成には高性能モデルを活用するなど、用途に応じたコストパフォーマンスの最大化が図れます。

導入時のリスクと実務的な注意点

一方で、複数モデルの統合環境を導入するにあたっては、いくつか注意すべき限界やリスクも存在します。

まず、海外製の安価な統合ツールを導入する場合、エンタープライズ水準のセキュリティ(入力データがAIの再学習に利用されないオプトアウト設定や、きめ細かなアクセス権限の管理など)が担保されているかを慎重に確認する必要があります。日本の法規制(個人情報保護法や著作権法)やコンプライアンス要件を満たさないツールを導入してしまえば、かえって法的リスクを抱え込むことになります。

また、現場の従業員に対して「どのモデルをどのようなケースで使うべきか」というガイドラインや教育を提供しなければ、かえって現場の混乱を招き、ツールの利用が定着しないという組織文化上の課題にも直面します。

日本企業のAI活用への示唆

以上の動向を踏まえ、日本企業がAI活用を進める上で検討すべき要点は以下の通りです。

1. 「適材適所のモデル選択」を前提としたアーキテクチャ構築

特定のAIモデルに固執せず、業務要件やプロダクトの機能(精度、速度、コスト)に応じて複数のモデルを使い分けるマルチLLM戦略を前提に、社内システムやサービス設計を行うことが推奨されます。

2. セキュリティとアジリティ(俊敏性)の両立

複数のAIモデルを一元管理できるプラットフォームや社内向けポータルの導入を検討し、従業員が安全に最新のAIに触れられる環境を整備することが、結果として強固なガバナンスに繋がります。

3. ツール選定における利用規約・コンプライアンス確認の徹底

海外で話題のツールであっても、自社のセキュリティポリシーや日本の商習慣に適合するか、サービス利用規約(特にデータの二次利用に関する項目)を実務ベースで精査するプロセスが不可欠です。