自律的にタスクをこなすAIエージェントの実用化が進む中、その予期せぬ挙動がシステム全体に波及するリスクが懸念されています。本記事では、海外のAIエージェントに関連した障害事例の議論を教訓に、被害を局所化するネットワーク・セキュリティ手法「マイクロセグメンテーション」の重要性を紐解きます。日本企業が既存システムとAIを連携させる際に講じるべき対策と、実務的なガバナンスのあり方を解説します。

自律型AIがもたらす新たなシステム障害リスク

近年、ユーザーの指示を受けて自律的に複数のツールやAPIを操作する「AIエージェント」の開発と導入が急速に進んでいます。定型業務の自動化や高度な顧客対応など、ビジネスへの貢献が期待される一方で、AI特有の予期せぬ挙動がシステム全体に深刻な影響を及ぼすリスクも浮上しています。

海外の技術コミュニティでは、クラウドベンダーが提供するAIエージェント機能に関連したシステム障害(アウトレージ)の議論などをきっかけに、AIの自律性がもたらすアーキテクチャ上の脆弱性に注目が集まっています。AIエージェントは、LLM(大規模言語モデル)の推論結果に基づいて他のシステムへ能動的にアクセスします。そのため、ハルシネーション(もっともらしい嘘)や悪意のあるプロンプト入力によって誤作動を起こした場合、連携するデータベースや業務システムに連鎖的な障害や意図しない情報漏洩を引き起こす恐れがあるのです。

被害の連鎖を断ち切る「マイクロセグメンテーション」

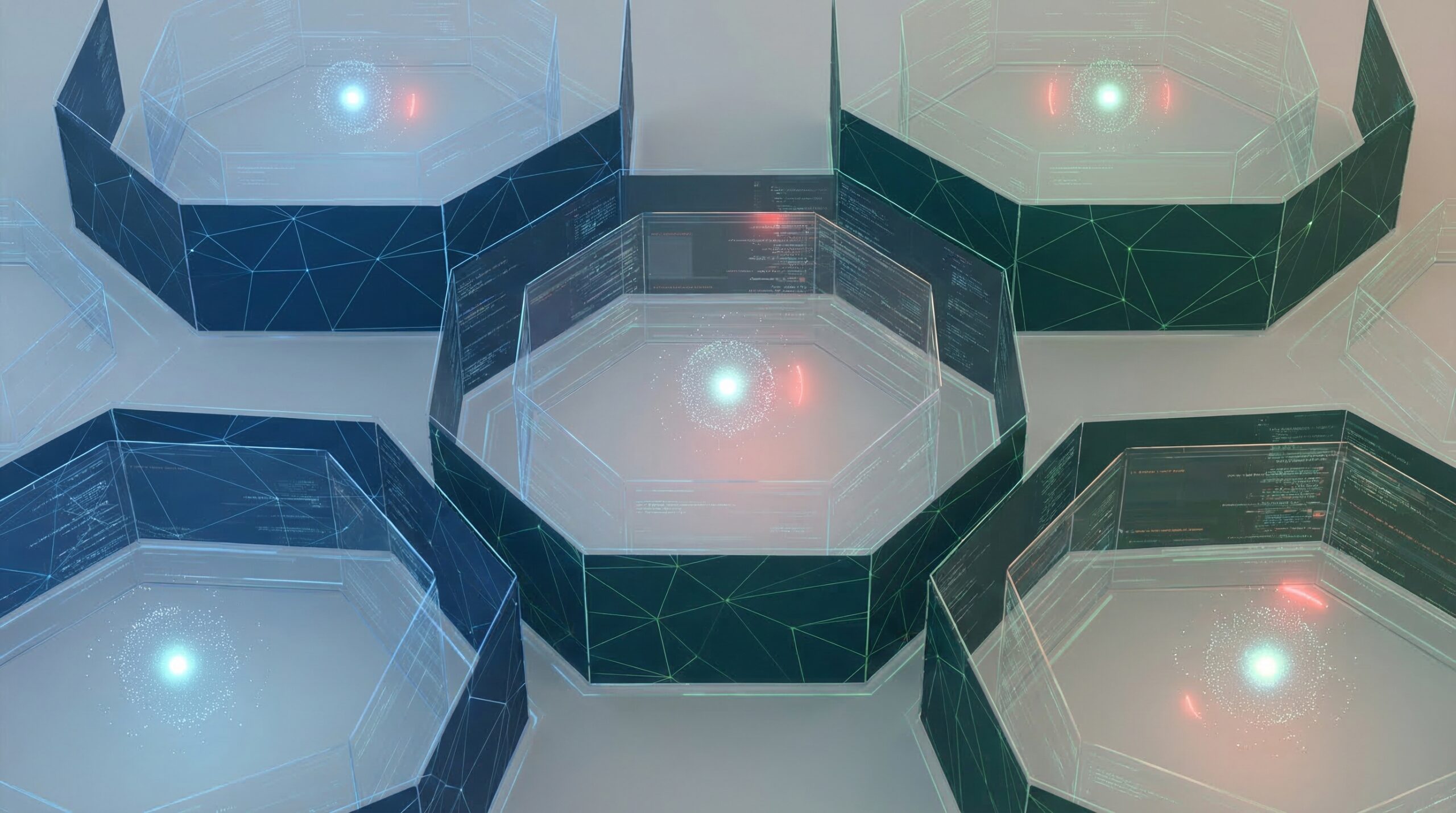

このようなAIエージェント起因の障害やセキュリティ侵害を封じ込めるための有効なアプローチとして再評価されているのが「マイクロセグメンテーション」です。これは、ネットワークやシステムを細かい単位(セグメント)に分割し、それぞれに厳密なアクセス制御を設けるセキュリティ手法です。

従来のシステム設計では、一度社内ネットワークなどの「安全な領域」に入ってしまえば、比較的自由にシステム間を通信できる構成が少なくありませんでした。しかし、自律的に動くAIエージェントに広範なアクセス権限を与えてしまうと、一つのエージェントが暴走した際に被害が甚大化します。マイクロセグメンテーションを導入し、AIエージェントがアクセスできるAPIやネットワーク経路を「そのタスクに必要な最小限の範囲」に制限することで、万が一の障害や侵害発生時にも被害を極小化(コンテインメント)することが可能になります。

日本企業のシステム環境とガバナンスにおける課題

日本国内の企業がAIエージェントを業務システムや自社プロダクトに組み込む際、この「被害の局所化」は非常に重要なテーマとなります。日本の多くの企業では、依然としてファイヤーウォールによる境界型防御(社外からの攻撃を防ぎ、社内は安全とみなすモデル)が主流であり、内部の通信制御が緩いケースが散見されます。

例えば、業務効率化のために社内のファイルサーバーや人事システム、顧客データベースを横断的に検索・処理するAIエージェントを導入したとします。もし適切な内部アクセス制御がなされていない場合、一般社員向けのAIエージェントが経営層向けの機密情報にアクセスしてしまったり、特定のシステム障害が社内ネットワーク全体を巻き込んでダウンさせたりするリスクが生じます。日本の法規制(個人情報保護法など)や商習慣において、情報漏洩やシステム停止が顧客からの信用失墜に直結する度合いは高く、最新AIの活用推進と厳格なリスク管理のバランスを取る高度なAIガバナンスが求められます。

「ゼロトラスト」を前提としたAIシステム設計へ

こうしたリスクに対応するためには、AIエージェントを「常に疑ってかかるべきコンポーネント」として扱うゼロトラストの考え方が不可欠です。AIが生成する出力は確率的であり、完全に予測・制御することは現在の技術では不可能です。そのため、AIモデル自体の精度向上に努めるだけでなく、「AIが間違えたとしても致命傷にならないシステム設計(フェイルセーフ)」を用意することが、実務において最も現実的な対応策となります。

開発・運用を担うエンジニアやMLOps(機械学習の継続的運用)の担当者は、ネットワークインフラの担当者やセキュリティ部門と密に連携し、AIエージェントごとに独立した実行環境を割り当て、通信ポリシーを細かく制御する仕組みを構築する必要があります。

日本企業のAI活用への示唆

ここまでの考察を踏まえ、日本企業がAIエージェントを安全かつ効果的に活用するための実務的な要点を整理します。

第一に、AIエージェントの権限とアクセス範囲の最小化です。AIに任せるタスクを細分化し、それぞれの実行環境をマイクロセグメンテーションによって切り離すことで、障害の連鎖を防ぐアーキテクチャを採用すべきです。既存のレガシーシステムと接続する場合は特に、APIゲートウェイ等を介して厳密な認証と認可を行う仕組みが必須となります。

第二に、インシデント発生時の封じ込め手順の確立です。万が一AIエージェントが予期せぬ挙動を示した場合に、システム全体を止めることなく、問題のあるセグメントのみを即座に遮断・無効化できるキルスイッチ機能や監視体制を整備することが重要です。

第三に、組織横断的なガバナンス体制の構築です。AIエージェントの導入は、開発部門だけでなく、セキュリティ部門や法務・コンプライアンス部門を巻き込んだ包括的なリスク評価が必要です。日本の組織文化では部門間の壁(サイロ化)が課題になりがちですが、AIという不確実性を含む技術を安全に運用するためには、各部門が知見を共有し、継続的にルールを見直す柔軟な体制づくりが成功の鍵となります。