生成AIの活用は「チャット」から、自律的にタスクをこなす「エージェント」へと進化しています。しかし、LLMが社内システムやデータベースへ直接アクセスすることは、セキュリティ上の重大なリスクを伴います。本記事では、AIエージェントとインフラの間に介在し、適切なアクセス制御とガバナンスを担保する「AI Agent Gateway」の概念と、日本企業が実装すべき「最小権限」のアプローチについて解説します。

「対話」から「行動」へ:AIエージェントのリスクと課題

生成AI、特に大規模言語モデル(LLM)の活用フェーズは、単なるテキスト生成や要約といった「対話型(Chat)」から、ユーザーの代わりにツールを使い、APIを叩き、データベースを操作する「エージェント型(Agentic)」へと急速にシフトしています。これは業務効率化の観点で大きな飛躍ですが、同時に企業にとっては新たなセキュリティリスクの出現を意味します。

最大の問題は、LLMが「確率的」に動作する点です。従来のプログラムとは異なり、LLMは同じ入力に対して常に同じ出力を返すとは限りません。もしAIエージェントに社内インフラへの広範なアクセス権を与えてしまった場合、ハルシネーション(もっともらしい嘘)やプロンプトインジェクション攻撃によって、予期せぬデータの削除や機密情報の流出を引き起こす可能性があります。

インフラを守る防波堤「AI Agent Gateway」とは

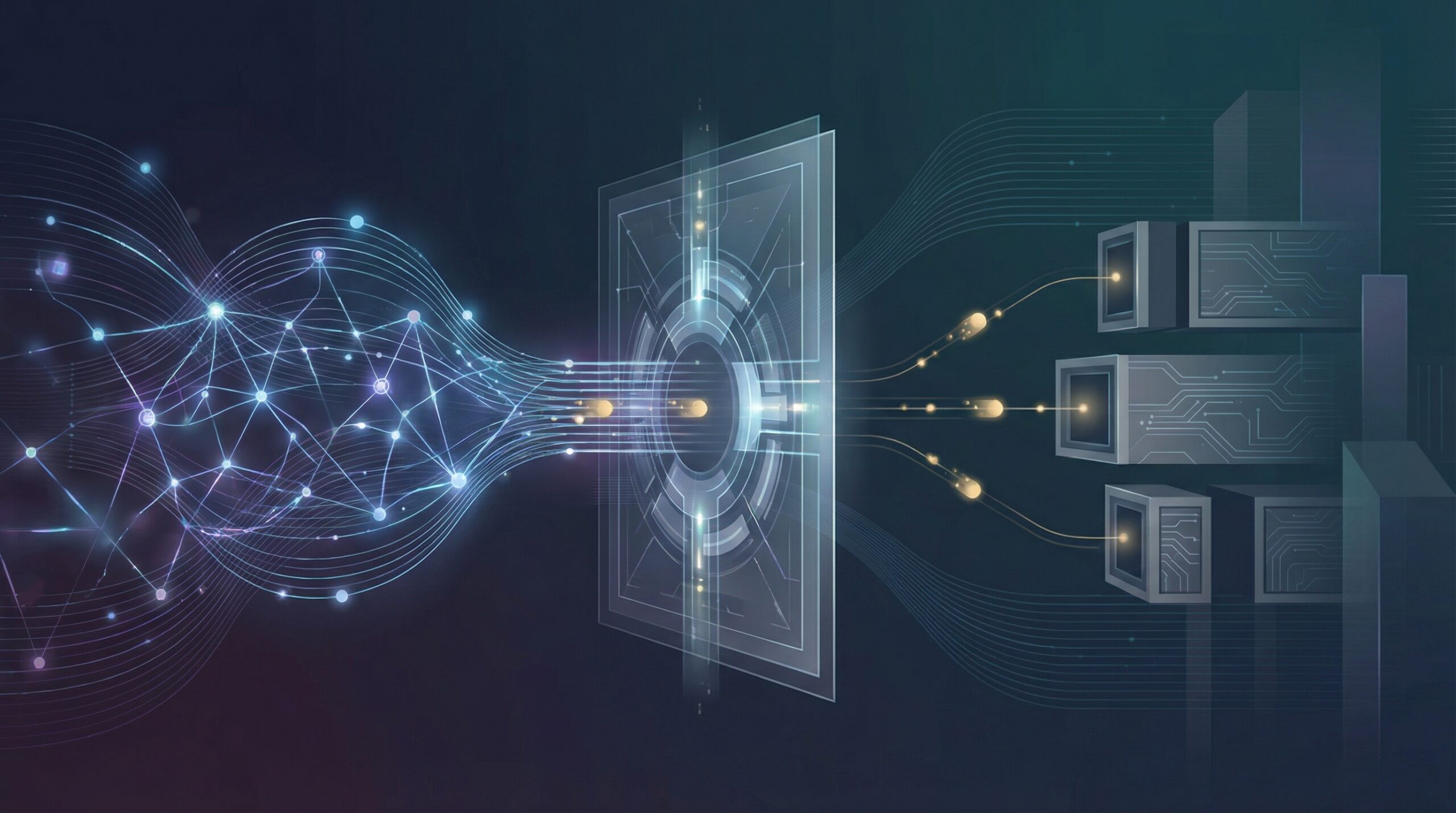

こうしたリスクに対応するために注目されているのが、「AI Agent Gateway(AIエージェントゲートウェイ)」というアーキテクチャ・パターンです。これは、AIエージェントと、それが操作しようとするバックエンドシステム(データベース、クラウドインフラ、社内APIなど)の間に配置される制御レイヤーを指します。

元記事の文脈にあるように、AIエージェントに対してインフラへの直接的なアクセス権(Admin権限など)を与えることは避けるべきです。代わりに、ゲートウェイが仲介役となり、エージェントからのリクエストを検証・認可した上で、許可された操作のみをシステムに伝達します。これにより、万が一AIが暴走したり乗っ取られたりした場合でも、被害を最小限に食い止めることが可能になります。

「最小権限の原則」をAIにも適用する

セキュリティの世界では古くから「最小権限の原則(Principle of Least Privilege)」が鉄則とされてきましたが、これはAIエンジニアリングにおいても極めて重要です。

具体的には、AIエージェントに対して「何でもできる万能な鍵」を渡すのではなく、そのタスクを遂行するために「必要最低限の権限」のみを付与します。例えば、社内ドキュメントの検索を担当するエージェントには「読み取り専用(Read-Only)」の権限のみを与え、データの書き込みや削除機能は一切持たせないといった制御です。

また、この権限管理は「動的」に行われることが理想です。セッションの文脈やユーザーの役職に応じて、AIが実行できるアクションの範囲をゲートウェイ側で動的に制限することで、より堅牢なセキュリティを実現できます。

日本企業のAI活用への示唆

日本企業、特に金融、製造、ヘルスケアなどの規制産業においては、AIの利便性よりも「説明責任」や「安全性」が優先される傾向にあります。AIエージェントの実用化に向けて、意思決定者は以下のポイントを考慮すべきです。

- 「人による承認(Human-in-the-loop)」の組み込み:

書き込みや決済など、影響度の大きいアクションについては、AIが直接実行するのではなく、ゲートウェイ層で一度止めて人間に承認を求めるフロー(日本的なワークフローや稟議に近い形)を設計に組み込むことが有効です。 - 監査ログの徹底:

AIが「いつ、なぜ、どのデータにアクセスし、何を実行したか」をゲートウェイですべて記録する必要があります。これはトラブルシューティングだけでなく、コンプライアンス監査への対応としても必須となります。 - 段階的な権限委譲:

PoC(概念実証)の段階では、AIエージェントには情報の「参照」のみを許可し、信頼性が確認できた段階で、限定的な「更新」権限を付与するというステップ・バイ・ステップのアプローチが、組織的な合意形成を得る近道です。

AIエージェントは強力な武器ですが、それを制御する「手綱」なしに現場に放つことは無謀です。既存のITガバナンスとAI特有の不確実性を埋める「ゲートウェイ」の思想を取り入れることが、日本企業が安全にAI活用をスケールさせる鍵となるでしょう。