生成AIのトレンドは、単なるチャットボットから、複雑なタスクをこなす「AIエージェント」へと移行しつつあります。しかし、実務適用において最大の壁となるのが、外部データの参照精度(RAG Faithfulness)と推論の確からしさです。本記事では、最新のLLM動向を踏まえ、日本企業が直面する品質課題と、それを乗り越えるための実装アプローチについて解説します。

LLM Reasoning:単なる予測から「推論」への進化

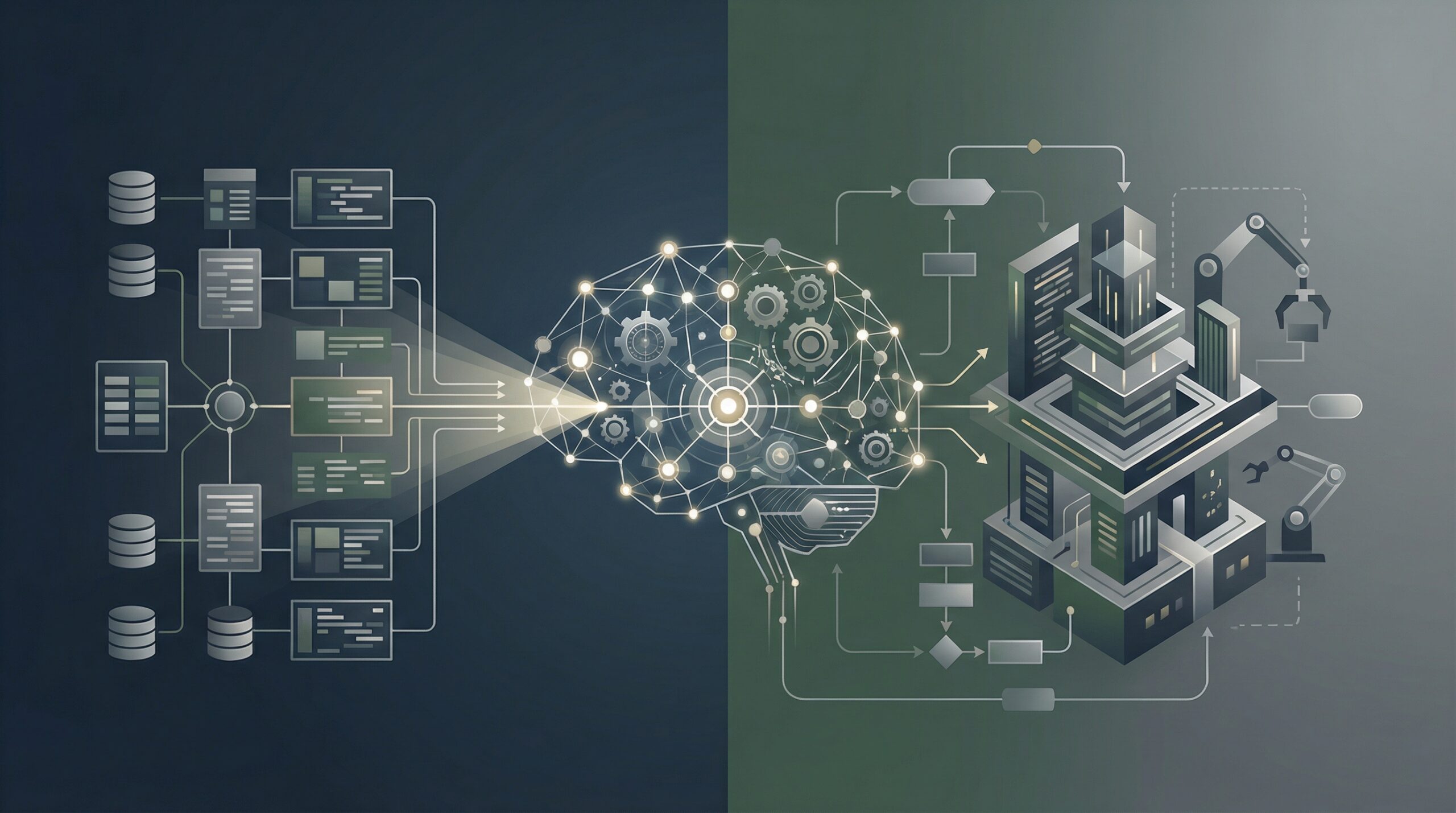

大規模言語モデル(LLM)の技術開発競争は、パラメータ数の拡大による知識量の増加から、より高度な「推論能力(Reasoning)」の強化へとシフトしています。従来のLLMは確率的に「次に来るもっともらしい単語」をつなぎ合わせることに長けていましたが、最新のモデルや手法(Chain of Thoughtなど)は、複雑な問題をステップバイステップで分解し、論理的に答えを導き出す能力を高めています。

この進化により、AIは単なる「検索エンジンの代替」や「要約ツール」を超え、複数のタスクを並行して処理(Multitasking)し、自律的に判断を下す「AIエージェント(LLM Agency)」としての役割を担い始めています。これは、日本のビジネス現場における複雑な業務フロー、例えば稟議書の整合性チェックや、法規制と照らし合わせた契約書の一次レビューといった領域での活用可能性を広げるものです。

RAG Faithfulness:日本企業がもっとも重視すべき指標

企業がLLMを導入する際、社内データを参照させる技術である「RAG(検索拡張生成)」が標準的なアーキテクチャとなっています。しかし、ここで実務上の大きな課題となるのが「Faithfulness(誠実さ・忠実度)」です。

Faithfulnessとは、生成された回答が「検索して取得した根拠ドキュメント(Context)」にどれだけ忠実に即しているか、という指標を指します。たとえ回答が流暢な日本語であっても、参照元の社内規定やマニュアルに基づかない情報を勝手に捏造(ハルシネーション)してしまっては、企業ガバナンスの観点から許容されません。

特に日本の組織文化では、正確性や説明責任(アカウンタビリティ)が強く求められます。「だいたい合っている」では済まされない金融、製造、医療、公共サービスなどの領域では、このFaithfulnessを継続的に計測・監視するMLOps(機械学習基盤の運用)の仕組みが不可欠です。

AIエージェントと「人間参加型(Human-in-the-loop)」の重要性

AIが自律的にタスクをこなす「エージェント化」は業務効率化の強力な武器ですが、同時にリスクも孕みます。エージェントが誤った推論に基づき、誤ったメールを送信したり、誤った発注を行ったりするリスクです。

日本企業がこの技術を安全に取り入れるためには、AIに完全に任せきりにするのではなく、重要な意思決定やアクションの直前に必ず人間が介在する「Human-in-the-loop」の設計が推奨されます。例えば、カスタマーサポートにおいて、回答案の作成と関連情報の収集まではAIエージェントが「マルチタスク」で行い、最終的な送信ボタンは担当者が押す、といった運用です。これにより、AIの推論能力を活用しつつ、最終的な責任の所在を人間に残すことが可能になります。

日本企業のAI活用への示唆

グローバルの技術トレンドと日本の実務環境を踏まえると、意思決定者は以下の3点を意識してAI活用を進めるべきです。

- 評価指標の確立(RAG Faithfulness):AI導入の効果測定において、単に「便利になったか」だけでなく、「参照データに対する忠実度」を定量的・定性的に評価するプロセスを組み込んでください。これにより、コンプライアンスリスクを低減できます。

- 段階的なエージェント化:いきなり全自動化を目指すのではなく、まずは「推論」と「情報収集」をAIに任せ、「実行」は人間が行うプロセスから始めてください。信頼性が確認できた領域から徐々に権限を委譲するのが現実的です。

- 独自のデータガバナンス:RAGの精度は、参照する社内データの質に依存します。AI活用の前段階として、社内文書のデジタル化、構造化、そして最新性の維持(古いマニュアルをAIが参照しないようにする等)という、地道なデータ整備が競争力の源泉となります。