最新の研究により、ChatGPT(特に推論能力を強化したモデル)が超加工食品の分類において高い精度を発揮することが示されました。この事例は、単なるテキスト生成にとどまらず、LLMが専門的なルールに基づく「判断・分類業務」を代替・支援できる可能性を示唆しています。本稿では、このニュースを起点に、日本企業が非構造化データを活用する際の勘所と、ガバナンス上の留意点について解説します。

専門家レベルの分類タスクをこなすLLMの進化

米国で報じられた最新の研究によると、OpenAIの推論モデル(ChatGPT o1など)を含む大規模言語モデル(LLM)が、食品の成分リストに基づいて「超加工食品(Ultraprocessed Foods: UPFs)」を分類するタスクにおいて、高い能力を示したとされています。栄養学の分野では、NOVA分類などの基準を用いて食品を加工度合いで分ける作業が行われますが、これには専門的な知識と、複雑な原材料リストの読み解きが必要です。

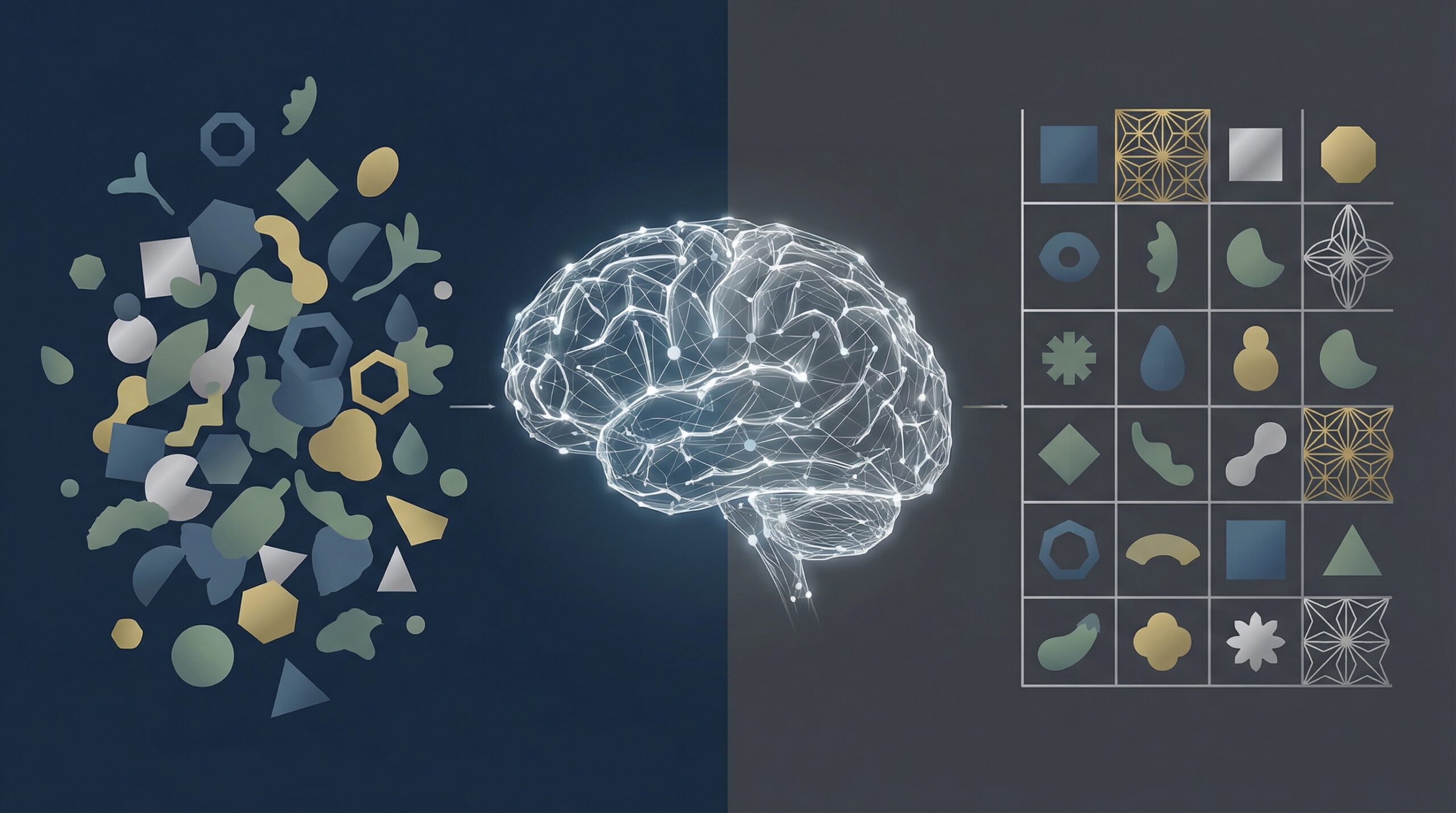

従来、こうしたタスクは人間の専門家が時間をかけて行うか、単純なキーワード一致(正規表現など)によるプログラムで行われてきました。しかし、単純なプログラムでは「名称は似ているが用途が異なる添加物」や「文脈による判断」に対応できません。LLMがここで成果を上げたことは、AIが単に言葉を並べるだけでなく、与えられた複雑な基準(ルール)に照らし合わせて、非構造化データ(成分表)を論理的に処理できる段階に来ていることを意味します。

日本企業における「非構造化データ」活用の可能性

この事例は、食品業界に限らず、多くの日本企業にとって重要な示唆を含んでいます。日本のビジネス現場には、日報、顧客からの問い合わせ、契約書、製造現場の特記事項など、膨大な「非構造化データ(テキストデータ)」が存在します。

例えば、製造業における不具合報告の分類、金融機関におけるコンプライアンスチェック、あるいはカスタマーサポートにおける問い合わせ内容の緊急度判定などは、これまでベテラン社員の「暗黙知」や手作業に依存してきました。今回の食品分類の例は、「明確なガイドラインさえ定義できれば、LLMが一次スクリーニングやタグ付けを代行できる」という可能性を示しています。特に人手不足が深刻化する日本国内において、専門職の業務負荷を軽減する「コパイロット(副操縦士)」としての活用価値は極めて高いと言えます。

精度とリスク:AIガバナンスの観点から

一方で、実務への導入には慎重な設計が求められます。特に日本は、食品表示法や景品表示法など、消費者保護に関わる法規制が厳格です。AIが「加工食品ではない」と誤判定し、その結果として誤った表示で製品が出荷されれば、企業は信用問題だけでなく法的責任を問われます。

LLMは「もっともらしい嘘(ハルシネーション)」をつくリスクを完全には排除できていません。今回の研究でも高い精度が示されましたが、100%ではありません。したがって、企業が導入する際は、「AIによる完全自動化」を目指すのではなく、「AIによる下書き・推奨」を人間が承認するフロー(Human-in-the-loop)を構築することが不可欠です。また、なぜその分類に至ったのかという根拠を出力させるプロンプトエンジニアリングや、RAG(検索拡張生成)による社内規定との照合も、ガバナンス強化の有効な手段となります。

日本企業のAI活用への示唆

今回の事例を踏まえ、日本の意思決定者やエンジニアは以下のポイントを意識してAI実装を進めるべきです。

- 専門業務の棚卸しとルール化: LLMは「曖昧な指示」よりも「明確な基準」で力を発揮します。ベテラン社員の頭の中にある判断基準を明文化(プロンプト化)することが、DXの第一歩です。

- ダブルチェック体制の再構築: AIを導入することで、人間の役割は「作業」から「監査・承認」へとシフトします。AIの判定ミスを見抜くためのスキルセットや業務フローの再設計が必要です。

- 特定ドメインへの特化: 汎用的なモデルだけでなく、社内用語や業界特有の言い回しを学習・参照させたシステムの構築が、実用的な精度を出す鍵となります。

- 法的リスクの所在確認: AIの判断ミスによる損害責任は、AIベンダーではなく利用企業にあります。特に規制産業においては、最終判断を人間が行ったという証跡を残す仕組みがガバナンス上必須です。