ChatGPTなどの生成AIが使う「おそらく」や「可能性が高い」という言葉は、人間がリスクや状況を評価して発する言葉とは根本的に意味が異なります。最新の研究が指摘するこの「認識のズレ」は、ビジネス実装、特に意思決定支援や顧客対応において重大なリスク要因となり得ます。本稿では、AIの「自信」のメカニズムを解き明かし、日本企業がとるべきガバナンスと活用のポイントを解説します。

AIにとっての「言葉」は、確率的なパズルに過ぎない

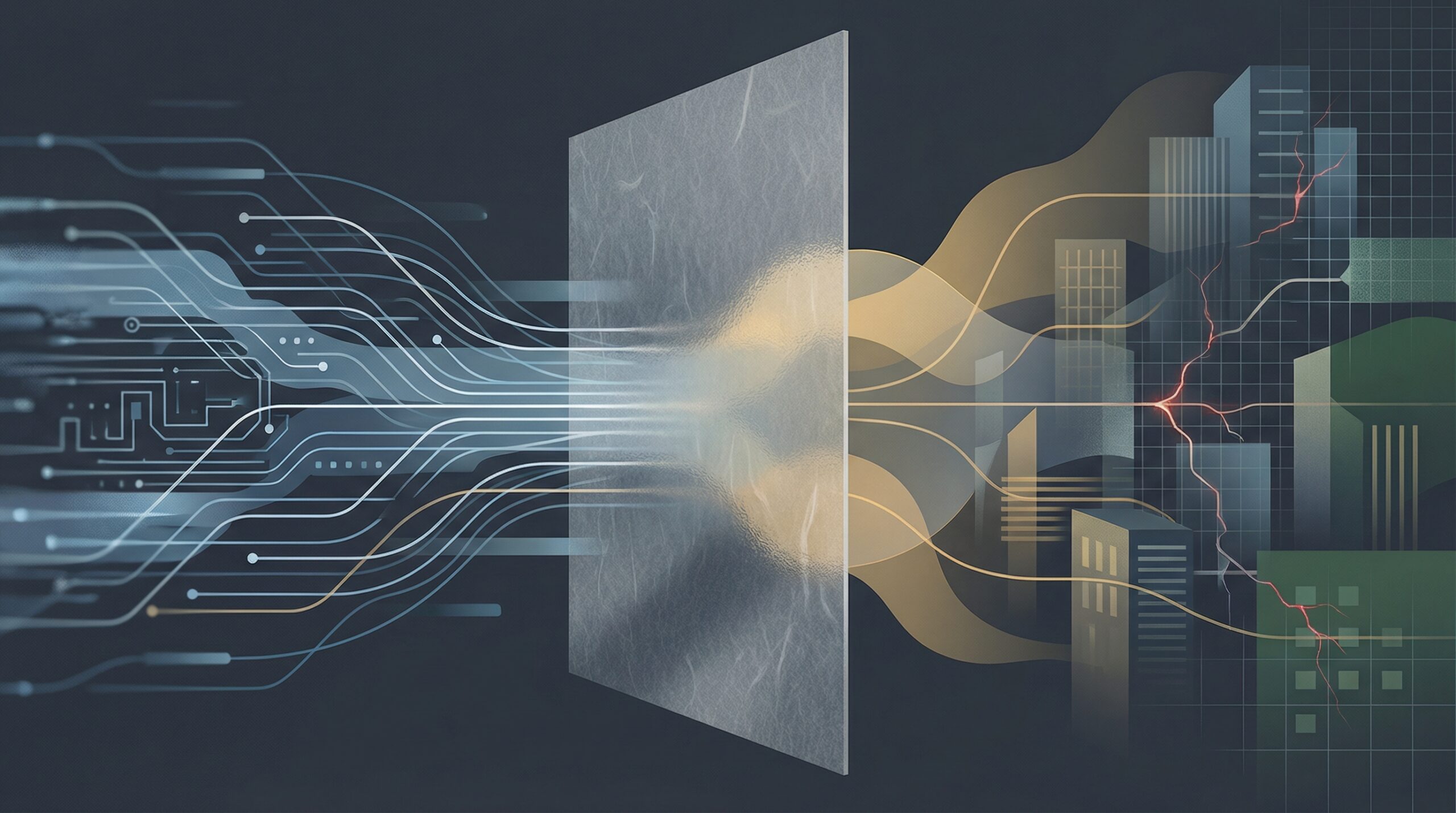

私たちは普段、相手が「おそらくそうでしょう」と言えば、その背景に何らかの根拠や確率的な見積もり(例えば70〜80%程度の確度)が存在すると想定します。しかし、大規模言語モデル(LLM)が同じ言葉を使うとき、そこには人間のような論理的な推論や現実世界の確率計算は存在しません。

The Conversationに掲載された記事でも指摘されている通り、AIにとっての言葉は、あくまで膨大なテキストデータから学習した「単語(トークン)のつながりやすさ」の結果です。AIが「答えは『おそらく』Aです」と出力したとしても、それは「この文脈では『おそらく』という単語が続く確率が高かった」だけであり、情報の真偽に対する自信を表しているわけではないのです。

この「流暢な嘘」や「根拠のない自信」は、AIを実務に組み込む際に最大の落とし穴となります。特にLLMは、事実かどうかにかかわらず、もっともらしい表現で回答を生成するように調整(ファインチューニング)されているため、自信満々に間違える現象――いわゆるハルシネーション(幻覚)――が、確信度を示す言葉と共に現れるリスクがあります。

「自信のありそうなAI」が引き起こすビジネスリスク

日本企業におけるAI活用、特にカスタマーサポートや社内ヘルプデスク、あるいは意思決定支援ツールとしての導入において、この問題は無視できません。

例えば、社内規定を検索するチャットボットが、「この経費精算は『おそらく』承認されます」と回答した場合を想像してください。従業員はその言葉を信じて申請を行いますが、AIは単に過去のデータパターンからそれらしい文章を作っただけで、最新の規定変更を論理的に判断したわけではありません。結果として申請が却下されれば、業務上の混乱やAIシステムへの不信感を招きます。

また、要約タスクにおいても同様です。「会議の合意事項は概ね以下の通りです」とAIが出力した際、その「概ね」がどの程度の網羅性を指すのか、AI自身は理解していません。重要な例外事項が抜け落ちていても、文体が自信に満ちていれば、人間の担当者はダブルチェックを怠る可能性があります。

プロンプトエンジニアリングと「確信度」の可視化

この問題に対処するためには、AIの出力する自然言語の「自信」を鵜呑みにせず、システム側で制御するアプローチが必要です。

一つは、プロンプト(指示文)による制御です。「確信が持てない場合は、『分かりません』と答えてください」という指示は基本ですが、それだけでは不十分です。「回答の根拠となるドキュメントを引用すること」を強制するRAG(検索拡張生成)の仕組みを取り入れることで、AIの「口から出まかせ」を抑制できます。

もう一つは、技術的なアプローチとして、モデルが出力する「トークン確率(Logprobs)」を確認する方法です。API経由で利用する場合、出力された単語ごとの予測確率を取得できるモデルがあります。回答の文章は自信満々でも、裏側の数値的な確率が低い場合は、ユーザーに対して「回答の信頼性が低い可能性があります」と警告を出すUI(ユーザーインターフェース)設計が有効です。

日本企業のAI活用への示唆

グローバルの研究成果や技術動向を踏まえ、日本のビジネス環境において意識すべき点は以下の通りです。

1. AIリテラシー教育の再定義

「AIは嘘をつくことがある」という抽象的な注意喚起から一歩踏み込み、「AIが使う確率的表現(多分、絶対に、恐らく)は、人間の感覚とは異なるメカニズムで生成されている」という具体的事実を、利用者や管理職に教育する必要があります。特に、日本人は文書化された言葉を重く受け止める傾向があるため、AIの言葉を過信しない文化作りが急務です。

2. 「人による判断(Human-in-the-Loop)」の重要性

責任の所在が問われる業務において、AIの「自信ありげな回答」を最終判断として採用するのは避けるべきです。AIはあくまで「草案作成」や「情報抽出」のパートナーと位置づけ、最終的な事実確認や意思決定は人間が行うというプロセスを業務フローに組み込むことが、ガバナンスの観点から不可欠です。

3. 不確実性を受容するUI/UXデザイン

プロダクト担当者は、AIの出力をそのまま表示するのではなく、リスクを明示するデザインを採用すべきです。例えば、根拠資料へのリンクを必ず表示する、回答の信頼度をスコアで示す、あるいは「この回答はAIによって生成されており、正確性を保証するものではありません」といった免責を目立つ場所に配置するなど、ユーザーの期待値を適切にコントロールする設計が求められます。