生成AIの活用は、単一のツールを使う段階から、複数のAIツールを組み合わせる「AIスタック」の構築へと進化しています。海外の最新トレンドであるPerplexity AIやClaudeなどを組み合わせたワークフローを参考に、日本企業が直面するセキュリティ課題や実務への適用方法について解説します。

「単一のAI」から「AIスタック」へのシフト

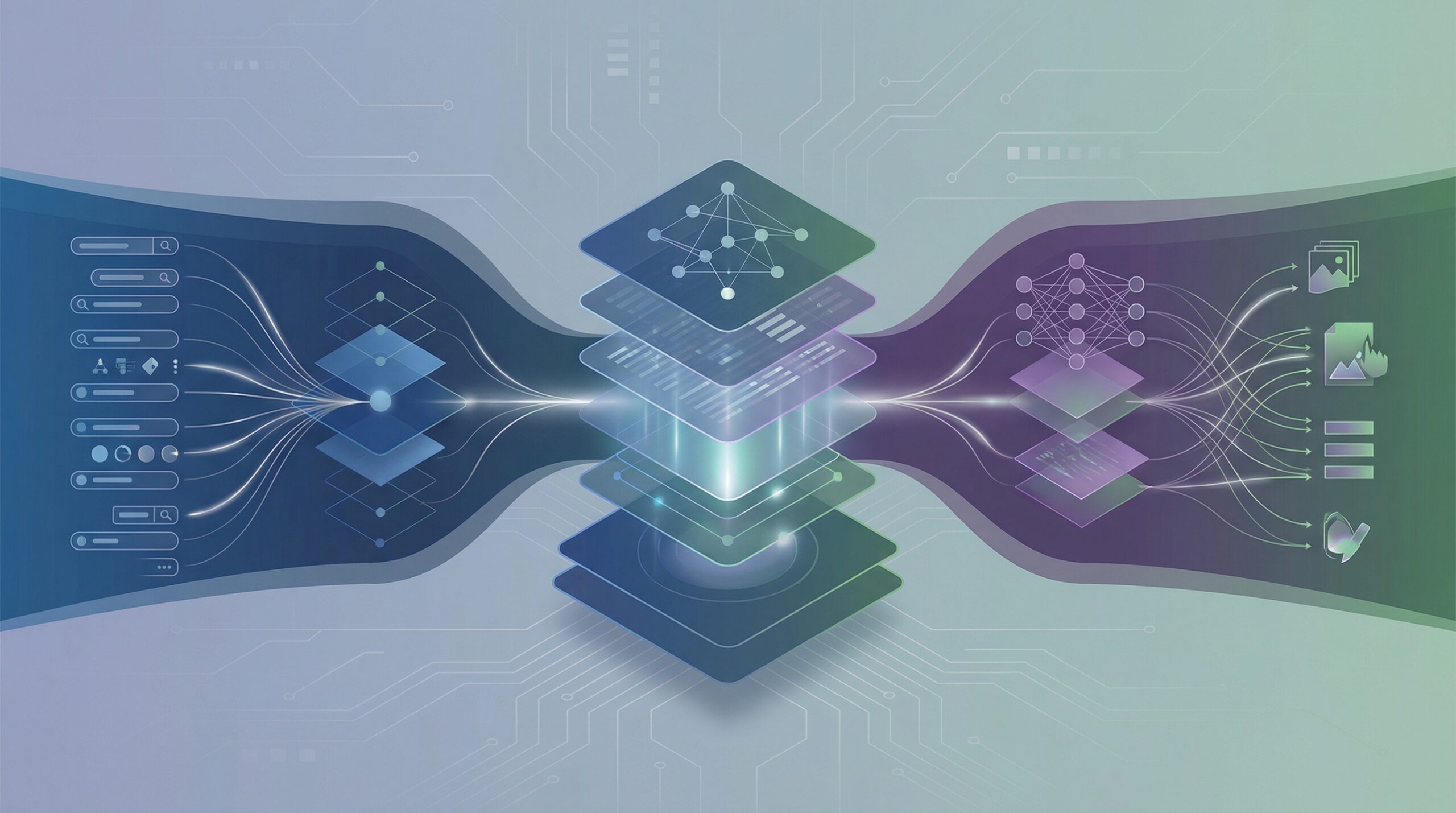

生成AIの登場から時間が経過し、グローバルなAI活用のトレンドは、ChatGPTのような単一のチャットボットに全てを任せるスタイルから、目的に応じて最適なツールを組み合わせる「AIスタック(AI Stack)」という考え方へと移行しつつあります。

例えば、最新の情報を正確に収集したい場面と、長文のビジネス文書を論理的に構成したい場面では、求められるAIの能力が異なります。海外のパワーユーザーの間では、検索に特化したAIと、文章生成や推論に優れたAIを使い分けることで、業務時間を大幅に短縮する事例が増えています。

検索と生成の分業:PerplexityとClaudeの事例

具体的な「スタック」の例として注目されているのが、検索特化型の「Perplexity AI」と、高い日本語処理能力と長文読解を持つAnthropic社の「Claude」の組み合わせです。

従来のLLM(大規模言語モデル)は、学習データが古かったり、事実に基づかない情報を生成(ハルシネーション)したりするリスクがありました。そこで、まずPerplexity AIを用いてWeb上の最新情報をソース付きで収集・整理し、その確かな情報をClaudeに入力して、稟議書やレポートの形式に整えさせるといったワークフローが有効です。

この分業により、「情報の正確性の担保」と「自然な日本語表現」の両立が可能となり、リサーチからアウトプットまでの時間を劇的に短縮できます。これは、情報の裏取りを重視する日本のビジネス習慣とも非常に相性が良いアプローチと言えます。

日本企業における「シャドーAI」リスクとガバナンス

個人の生産性を高めるAIスタックですが、日本企業として導入・推奨する際には注意が必要です。従業員が会社に無許可で様々なAIツールを組み合わせる「シャドーAI」の問題です。

無料版のAIツールは、入力データが学習に利用される規約になっていることが多く、機密情報や顧客情報の漏洩リスクに直結します。特に複数のツールを連携させる場合、データがどこを経由しているかが不透明になりがちです。

したがって、企業は「ChatGPTのみ許可」という一律の制限をかけるのではなく、業務特性(開発、マーケティング、法務など)に応じて許可するツールを選定し、可能な限り学習利用されない「エンタープライズ版」の契約を検討する必要があります。また、利用ガイドラインにおいても「禁止」より「安全な使い分け」に主眼を置くことが、現場の生産性を殺さないポイントとなります。

日本企業のAI活用への示唆

グローバルの潮流である「AIスタック」の概念を日本企業が取り入れるための要点は以下の通りです。

1. 「適材適所」のツール選定と投資

汎用的なAI一つですべてを解決しようとせず、リサーチ(検索系)、ドキュメント作成(文章系)、コーディング支援(開発系)など、業務プロセスごとに最適なツールを組み合わせる視点を持つべきです。これに伴い、複数の有料ツール契約が必要になる場合のコスト対効果を経営層が理解する必要があります。

2. 「入力データ」の重要性への回帰

どれほど優秀なAIモデルを使っても、入力する情報(コンテキスト)が不正確であれば、出力の質は上がりません。社内ドキュメントのデジタル化や整備(ナレッジマネジメント)を進め、AIに「何を読ませるか」を整理することが、他社との差別化要因になります。

3. 従業員のAIリテラシー教育の転換

プロンプトエンジニアリング(指示出しの技術)だけでなく、どのAIツールをどう組み合わせれば最短で成果が出るかという「AIオーケストレーション」のスキル教育が求められます。同時に、出力結果を鵜呑みにせず、必ず人間がファクトチェックを行うというプロセスを業務フローに組み込むことが不可欠です。