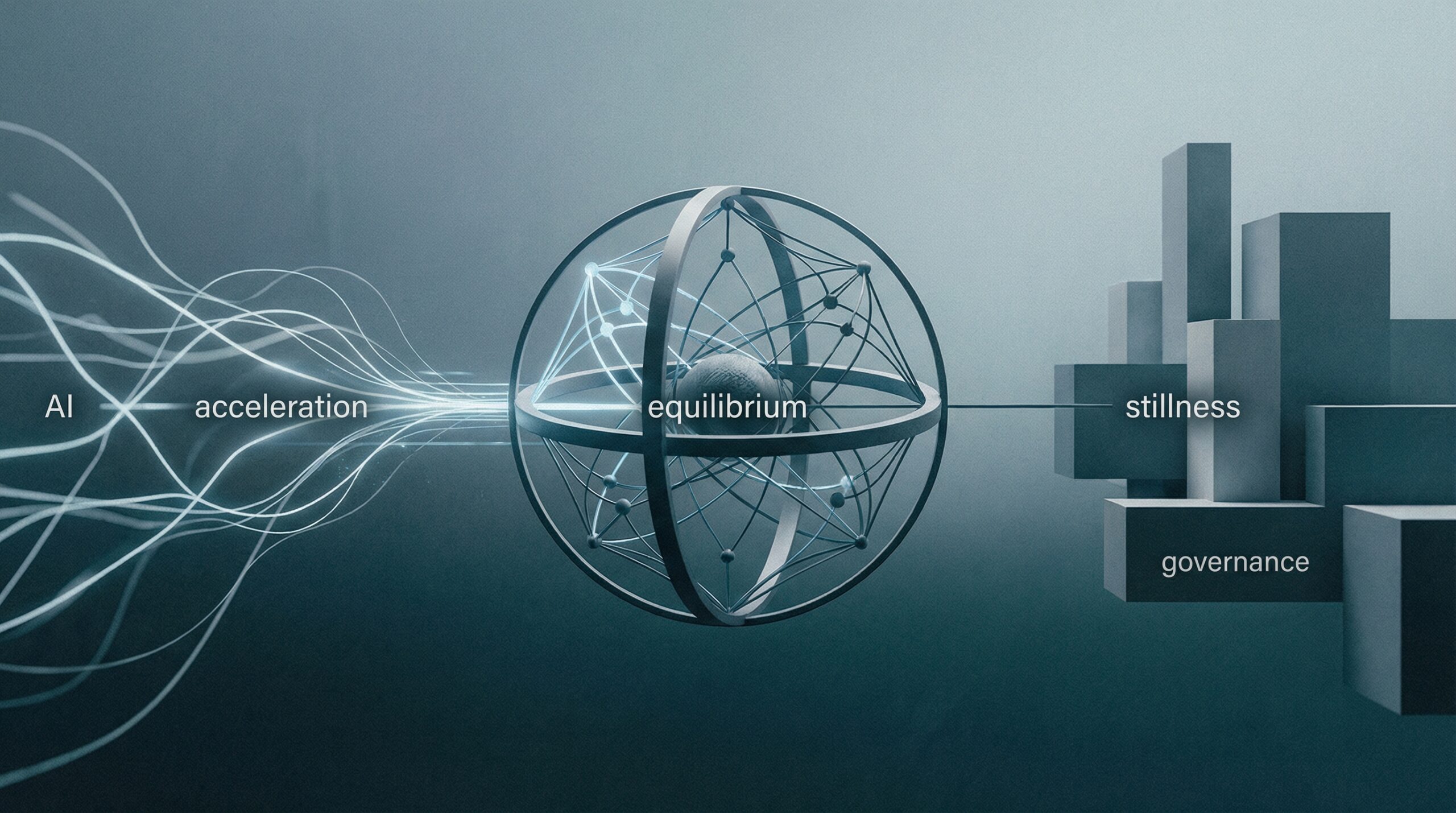

生成AIの技術進化は目覚ましく、GoogleのGeminiをはじめとする最新モデルは、企業の知的生産性を劇的に向上させる可能性を秘めています。しかし、急速な技術導入にはリスクも伴います。本記事では、技術的な「スピード」と、組織として必要な「冷静な判断(Stillness)」のバランスをどう取るべきか、日本企業の商習慣や組織文化を踏まえて解説します。

技術進化のスピードと実務への適用

GoogleのGeminiなどの大規模言語モデル(LLM)は、テキストだけでなく画像や音声も処理するマルチモーダル化が進み、その「知的なスピード(Intellectual Speed)」は日々加速しています。日本企業においても、議事録作成や翻訳といった定型業務だけでなく、複雑なドキュメントの解析やコード生成、顧客対応の自動化など、実務レベルでの適用範囲が拡大しています。

しかし、技術ができることと、ビジネスで安全に使えることの間には依然としてギャップが存在します。特に日本市場では、日本語特有のハイコンテキストなコミュニケーションや、正確性を極めて重視する商習慣があり、海外製のモデルをそのまま導入するだけでは期待通りの成果が出ないケースも散見されます。ベンダーが提示するスペック上の性能を鵜呑みにせず、自社の業務フローでPoC(概念実証)を回し、実効性を検証するプロセスが不可欠です。

「静寂」としてのガバナンスとリスク管理

技術のスピードに対して、企業組織に求められるのは「必要な静寂(Much-Needed Stillness)」、すなわち冷静なガバナンスとリスク管理です。生成AIにはハルシネーション(もっともらしい嘘)や、機密情報の学習利用といったリスクがつきまといます。特にコンプライアンス意識の高い日本企業では、一度事故が起きればブランド毀損の影響は甚大です。

「静寂」とは、イノベーションを止めることではありません。AIが生成したアウトプットに対して、人間が最終確認を行う「Human-in-the-loop」の体制を整えることや、法的規制・著作権のガイドラインを遵守するための安全弁を設けることを指します。欧州のAI規制法案や日本国内のAI事業者ガイドラインなどの動向を注視しつつ、攻めの活用と守りのガバナンスを両立させる体制構築が求められます。

日本特有の組織文化とAIの融合

日本の組織は、現場の改善活動(カイゼン)が得意な一方で、ボトムアップでの抜本的な改革には時間がかかる傾向があります。AI導入においては、トップダウンで「AI活用」を号令するだけでなく、現場レベルで使いやすいユースケースを特定し、小さな成功体験を積み上げることが重要です。

また、日本企業では「責任の所在」が曖昧になりがちですが、AIを活用した業務プロセスの結果責任は常に人間にあります。この原則を明確にし、従業員が安心してAIツールを使えるような社内ルールの策定(利用ガイドラインの整備など)が、普及の鍵となります。

日本企業のAI活用への示唆

Google Gemini等の最新AIモデルを活用する際、日本企業は以下の点に留意すべきです。

- スピードと品質のバランス: AIによる生成速度の向上を享受しつつ、日本品質の正確性を担保するために、必ず人間のレビュー工程を業務フローに組み込むこと。

- データガバナンスの徹底: エンタープライズ版の契約などにより、入力データがモデルの学習に使われない環境を確保し、情報漏洩リスクを遮断すること。

- 組織的なリテラシー向上: 特定のエンジニアだけでなく、ビジネス職がプロンプトエンジニアリングやAIの限界を理解するための教育を行い、組織全体で「AIを使いこなす文化」を醸成すること。

技術の進化に焦ることなく、自社のペースで着実に「使えるAI」を見極め、組織に定着させていく姿勢こそが、長期的な競争優位につながります。