MIT CSAILとAsari AIが発表した新フレームワーク「EnCompass」は、大規模言語モデル(LLM)を用いたAIエージェントの信頼性を高めるために、探索とバックトラックの手法を取り入れています。単なるチャットボットから、自律的に業務を遂行するエージェントへの進化において、この「立ち止まって考え直す」仕組みがなぜ重要なのか、日本企業の導入視点で解説します。

「一発勝負」から「試行錯誤」へ:AIエージェントの進化

生成AIの活用フェーズは、人間がチャット画面で対話する段階から、AIが自律的に複数のタスクをこなす「AIエージェント」の段階へと移行しつつあります。しかし、実務でエージェントを構築しようとしたエンジニアの多くが直面するのが「信頼性」の壁です。LLMは確率的に次の言葉を予測するため、複雑な手順の途中で一度でも判断を誤ると、その後の工程がすべて破綻してしまうことがあります。

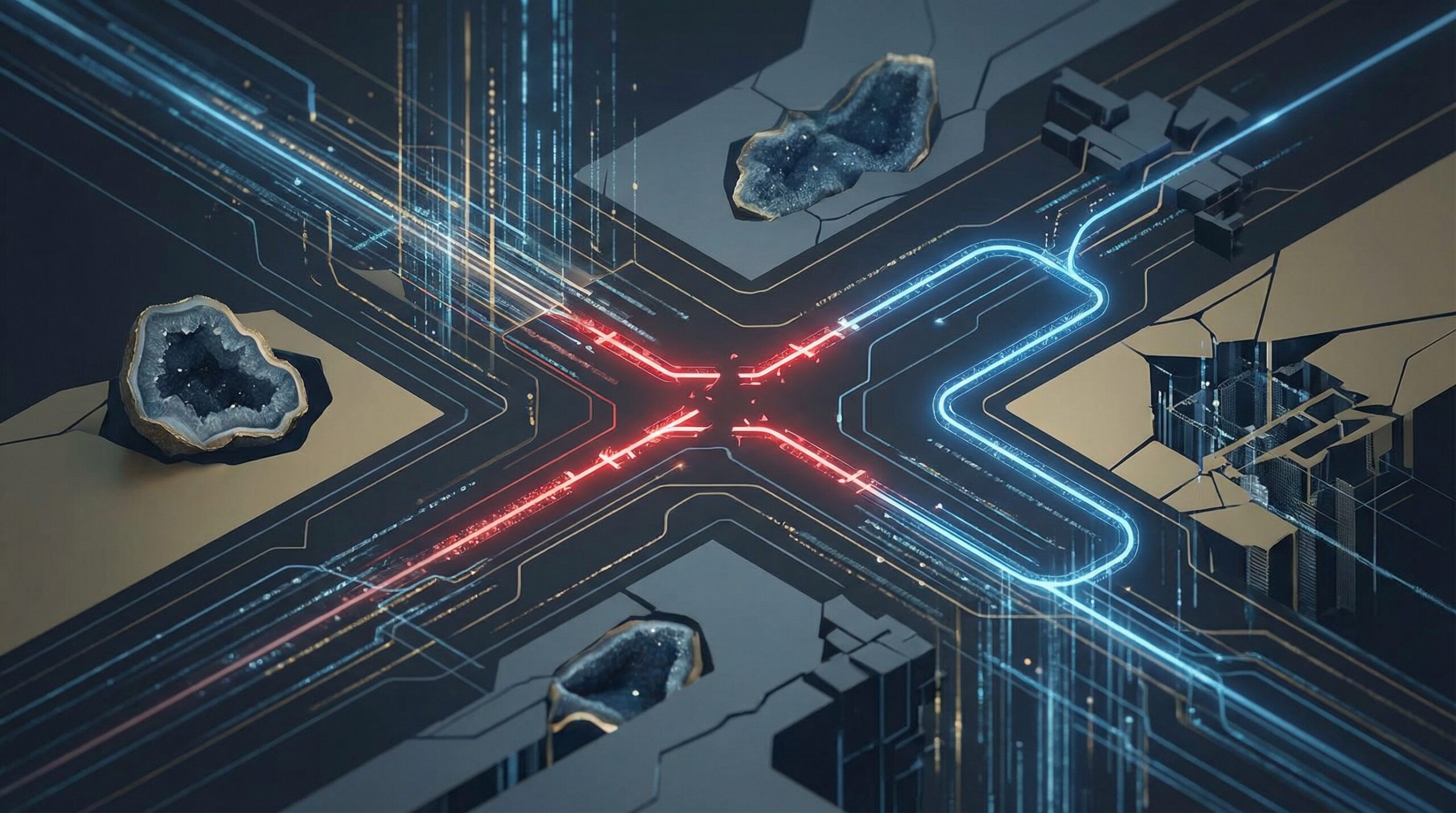

MIT CSAIL(コンピュータ科学・人工知能研究所)らが新たに提案したフレームワーク「EnCompass」は、この課題に対して「探索(Search)」と「バックトラック(Backtracking)」という、古典的なアルゴリズムの概念をLLMに適用することで解決を図ろうとしています。

従来のLLMエージェントが、迷路を猛スピードで突き進み、壁にぶつかってもそのまま進もうとしていたとすれば、この新しいアプローチは「分かれ道で立ち止まり、可能性を検討し、行き止まりなら引き返して別の道を選ぶ」能力をAIに与えるものです。

エラーの連鎖を断ち切る仕組み

AIエージェントが業務プロセス(例えば、市場調査を行い、データを分析し、レポートを作成してメールで送る、といった一連の流れ)を実行する際、最大のリスクはエラーの連鎖です。初期段階でのハルシネーション(もっともらしい嘘)や論理的飛躍が、最終的な成果物を大きく歪めてしまいます。

EnCompassのようなフレームワークが目指すのは、人間が思考するプロセスに近い挙動の実装です。具体的には、タスクをサブゴールに分解し、AI自身が「この手順で正しいか?」を検証しながら進みます。もし間違いを検知したり、期待する結果が得られなかったりした場合、前のステップに戻って(バックトラック)、別の解決策を試みるのです。

これにより、人間が常に横について修正指示を出さずとも、AIエージェントが高い完遂率でタスクをこなせる可能性が高まります。これは、正確性を重んじる日本の商習慣において、AIを基幹業務に近い領域で活用するための重要なステップと言えます。

精度とコストのトレードオフ:実務上の注意点

しかし、このアプローチには明確なトレードオフが存在します。それは「推論コスト」と「レイテンシ(応答時間)」の増加です。

「立ち止まって考え、引き返してやり直す」という処理は、それだけ多くの計算資源(トークン消費)と時間を必要とします。即時性が求められるカスタマーサポートのチャットボットなどには不向きかもしれませんが、時間をかけてでも正確な答えを出してほしい「調査業務」「複雑なコーディング」「法務文書のチェック」などには適しています。

企業は、「速くて不正確なAI」と「遅い(あるいは高コスト)が正確なAI」のどちらを、どの業務に適用するかというポートフォリオ管理が求められるようになります。

日本企業のAI活用への示唆

今回のMITの研究成果は、単なる技術ニュースにとどまらず、日本企業が今後AIエージェントを実装していく上で以下の重要な視唆を含んでいます。

1. 業務プロセスの「やり直し」を許容する設計

AIエージェントを導入する際は、一度の指示で完璧な答えを求めるのではなく、AIが試行錯誤するための「遊び」や「検証ステップ」を業務フローに組み込む必要があります。AIに自己修正させる時間をあらかじめ見積もっておくことが、プロジェクト成功の鍵となります。

2. 人間による「最終確認」の役割変化

AIが自律的にバックトラックできるようになったとしても、最終責任は人間が負う必要があります。しかし、人間が行うべきは「一から十まで監視する」ことではなく、AIが「自信を持って提示してきた複数の選択肢」や「迷った末に出した結論」に対する最終承認を行うことへと変化します。これは、より高度な判断力が現場担当者に求められることを意味します。

3. コスト対効果の再計算

探索とバックトラックを行うエージェントは、API利用料やGPUコストが従来よりも高くなる傾向があります。単純な業務効率化(工数削減)だけでなく、これまで人間でも見落としていたミスを防ぐ「品質向上」や「リスク低減」の価値を含めてROI(投資対効果)を算出する必要があります。

正確性と品質を重視する日本企業にとって、こうした「慎重なAI」の技術トレンドは追い風と言えます。技術の成熟を見極めつつ、まずは失敗が許されないコア業務ではなく、バックオフィスの調査業務や開発支援など、試行錯誤が許容される領域から、自律型エージェントの検証を始めることを推奨します。