Google Cloudが発表した米国公共部門における2025年のマイルストーンは、生成AIが「実験」のフェーズを超え、国家機密を含む極めてセンシティブな領域での実用段階に入ったことを示唆しています。本稿では、FedRAMPやIL6といった厳格なセキュリティ基準をクリアしたAI活用の事例をもとに、日本の金融・医療・公共インフラなど、規制産業におけるAI実装のあり方とガバナンス戦略について解説します。

米国公共部門が示す「機密情報×生成AI」の可能性

Google Cloudの公共部門における最新の振り返り(Karen Dahut氏による2025年のマイルストーンへの言及)において特に注目すべきは、生成AIモデル「Gemini」が米国政府の厳格なセキュリティ要件への対応を加速させている点です。具体的には、米軍や国防総省が定めるセキュリティ基準である「IL6(Impact Level 6)」や、連邦政府のクラウドセキュリティ認証制度「FedRAMP」の認可取得に向けた動きが挙げられます。

IL6は機密(Classified)情報を扱えるレベルを指し、これは民間企業における極秘レベルの研究開発データや、金融機関の決済データ、医療機関の患者データと同等、あるいはそれ以上のセキュリティ強度が求められる環境です。これまで「生成AIは情報漏洩リスクがあるため、機密データには使えない」というのが一般的な慎重論でしたが、ハイパースケーラー(大規模クラウド事業者)側の対応により、その前提が覆りつつあります。

「セキュリティ」はもはやAI導入を阻む壁ではない

米国での動向が日本の実務者に示唆しているのは、「セキュリティ技術そのもの」はすでに高度な要件を満たしうる水準にあるという事実です。Googleに限らず、主要なクラウドベンダーは、インターネットから隔離された環境や、データが学習に利用されない(Zero Data Retention)ポリシーを適用した環境整備を急速に進めています。

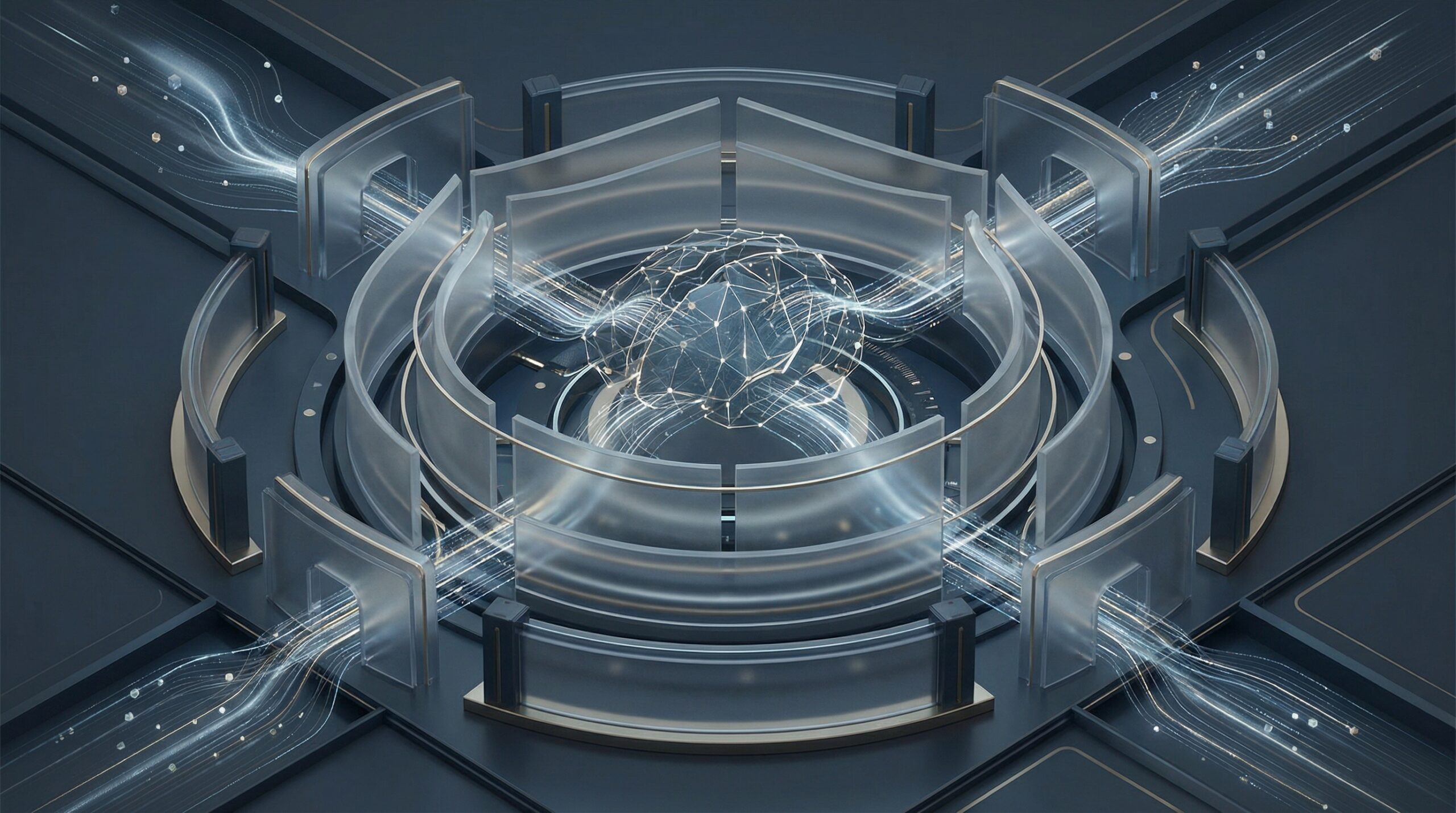

日本企業、特に規制の厳しい業界(金融、ヘルスケア、製造業のR&D部門など)においても、もはや「セキュリティが不安だからAIを使わない」という判断は、技術的な観点からは正当性を失いつつあります。今問われているのは、技術の有無ではなく、「どのデータを、どのレベルの隔離環境で、どのようなガバナンスのもとで処理するか」というデータ分類とアーキテクチャ設計の意思決定です。

日本国内の規制環境と実務への適用

日本国内に目を向けると、政府情報システムのためのセキュリティ評価制度「ISMAP(イスマップ)」がFedRAMPに相当する役割を果たしており、デジタル庁を中心にガバメントクラウドへのAI導入議論が進んでいます。民間企業においても、経済安全保障推進法や個人情報保護法、各業界のガイドラインを遵守しながら、いかにAIを業務プロセスに組み込むかが焦点となっています。

しかし、高セキュリティな環境(例:専用インスタンスやソブリンクラウド)は、導入コストや運用コストが跳ね上がる傾向にあります。すべての業務に最高レベルのセキュリティを適用するのは経済合理的ではありません。したがって、以下のような「データの格付け」に応じた使い分けが、日本のAIプロジェクト成功の鍵となります。

- Level 1(公開情報・一般業務):汎用的なパブリッククラウド上のLLMを活用し、コスト効率と速度を優先する。

- Level 2(社内秘・顧客情報):VPC(仮想プライベートクラウド)内での利用や、入力データが学習されない契約形態のAPIを利用する。

- Level 3(要配慮個人情報・経営機密):IL6相当の隔離環境、あるいはオンプレミスに近い環境での小規模言語モデル(SLM)や、専用にチューニングされたモデルを利用する。

ミッション・インパクトへの転換:要約から意思決定支援へ

元記事で強調されているもう一つの点は、「Mission Impact(任務への実質的な貢献)」です。初期の生成AIブームでは「議事録要約」や「メール下書き」といった効率化が中心でしたが、2025年のマイルストーンとして語られるのは、よりコアな業務への適用です。

日本企業においても、これからは「便利なツール」としてのAIから、「事業競争力を左右するインフラ」への転換が求められます。例えば、熟練技術者のナレッジ継承、複雑な法規制への適合チェック、大規模なシステムログからの予兆検知など、ミスが許されない領域での「人間の判断支援(Augmentation)」としての活用です。ここでは、ハルシネーション(もっともらしい嘘)のリスクを管理するために、RAG(検索拡張生成)による根拠提示や、人間による最終確認プロセス(Human-in-the-loop)の設計が不可欠です。

日本企業のAI活用への示唆

米国公共部門の先進事例は、日本のエンタープライズ領域におけるAI活用の未来図でもあります。以下に、意思決定者と実務者が押さえるべきポイントを整理します。

- 「できない理由」としてのセキュリティ論からの脱却:技術的には機密情報を扱える環境は整いつつあります。セキュリティ部門と連携し、「どうすれば安全に扱えるか」という建設的なアーキテクチャ設計にシフトすべきです。

- データガバナンスの再定義:AIに読み込ませるデータの機密レベルを明確に定義してください。すべてのデータを一律に扱うのではなく、リスクベースアプローチでコストと安全性のバランスを取ることが重要です。

- ベンダーロックインへの注意とマルチモデル戦略:特定のベンダーの環境に過度に依存すると、将来的な技術転換が難しくなります。セキュリティ要件を満たす複数の選択肢を持ち、用途に応じてモデルや基盤を切り替えられる柔軟性を維持することが、長期的なリスク管理につながります。

- 実益重視(ROI)のプロジェクト選定:「とりあえずAIを入れる」フェーズは終了しました。米国の事例同様、組織の「ミッション(本業)」に直結する課題解決にAIを適用し、具体的なROIを追求する段階に入っています。