生成AIの導入がPoC(概念実証)から実運用フェーズへと移行する中で、多くの企業がAPIコストの増大や応答遅延、可用性の確保といった「Day 2」の課題に直面しています。本記事では、これらの課題を解決する鍵となる「インテリジェント・ルーティング(推論ゲートウェイ)」の概念について、海外の最新事例「LLM-D」などの動向を交えつつ、日本企業が採るべきマルチモデル戦略とガバナンスの観点から解説します。

生成AIの実装における「推論の渋滞」問題

日本国内でも大規模言語モデル(LLM)を活用した社内システムや顧客向けサービスの開発が活発化していますが、本番環境での運用規模が拡大するにつれ、エンジニアやプロダクトマネージャーは新たな課題に直面しています。それは「推論(Inference)の渋滞」と、それに伴うコストとレイテンシー(遅延)の問題です。

特定のLLMプロバイダー(例えばOpenAIやAnthropicなど)のAPIにすべてのリクエストを集中させると、プロバイダー側の障害やレート制限(利用頻度制限)によりサービスが停止するリスクがあります。また、非常に単純なタスクに対しても高機能・高価格なモデルを使用し続けることは、ROI(投資対効果)の観点から最適とは言えません。

「AIの管制塔」としてのインテリジェント・ルーティング

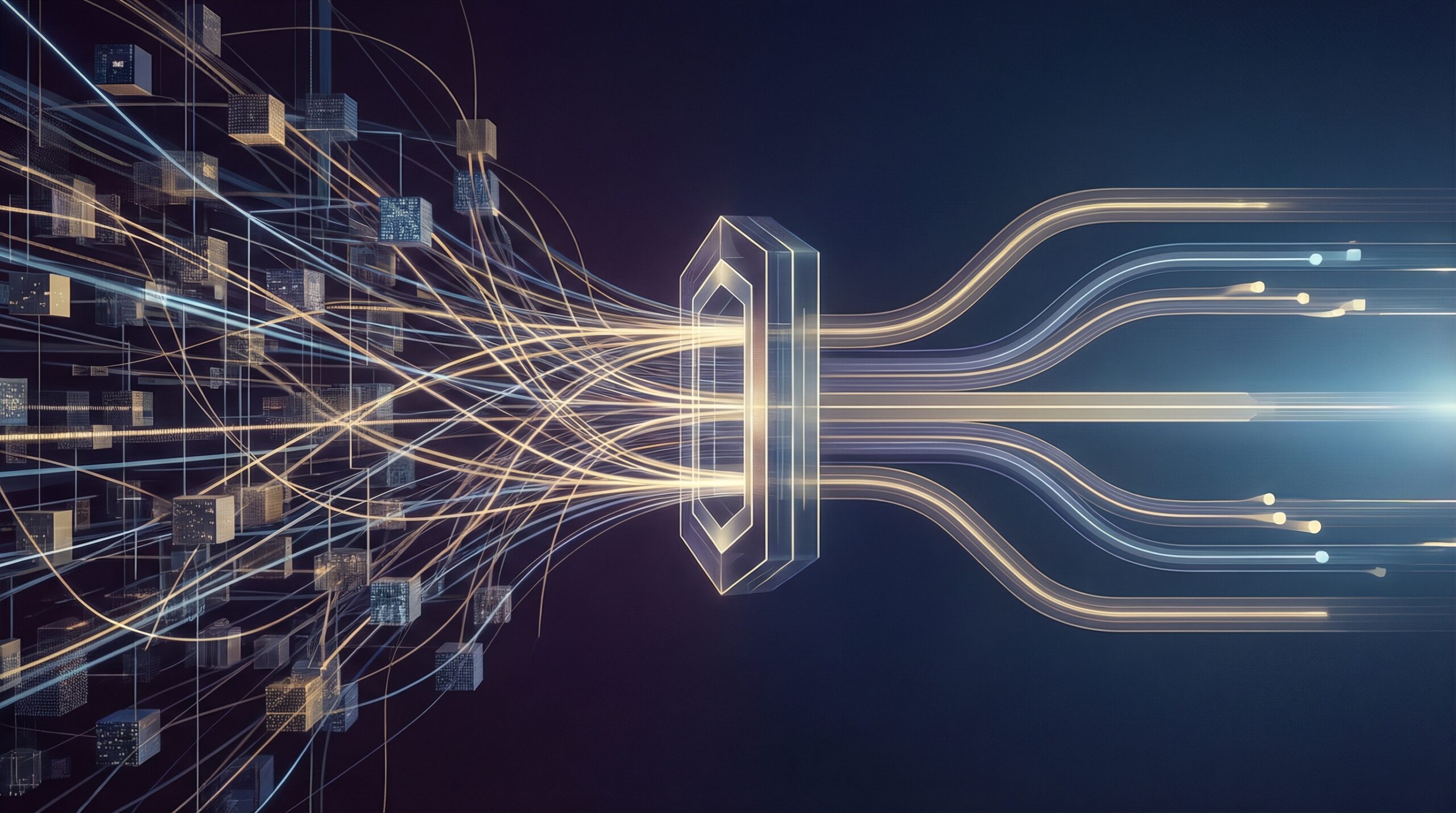

こうした課題に対する解決策として、海外を中心に注目を集めているのが「AIインファレンス・ゲートウェイ(AI Inference Gateway)」や「インテリジェント・ルーティング」と呼ばれる技術です。元記事で紹介されている「LLM-D」などのソリューションは、まさにこの領域に位置づけられます。

これらは、空港の「航空管制官」のような役割を果たします。アプリケーションと複数のLLMの間に立ち、入ってくるリクエストの内容を瞬時に評価し、最適なモデルへと振り分けます。例えば、以下のような動的な制御が可能になります。

・難易度による振り分け:複雑な論理的推論が必要なタスクは「GPT-4」クラスのモデルへ、定型的な要約や分類は軽量で安価なモデル(GPT-3.5やHaiku、あるいは自社ホストのオープンソースモデル)へ送る。

・可用性の確保:メインで使用しているAPIがダウンした場合、即座にバックアップの別モデルへ切り替える(フォールバック機能)。

・レイテンシー要件への対応:リアルタイム性が求められるチャットボットの応答には、最も応答速度が速いモデルを優先的に選択する。

日本企業における「適材適所」のマルチモデル戦略

この技術は、日本企業特有のニーズや商習慣においても極めて重要な意味を持ちます。特に「データの機密性」と「コスト効率」のバランスを取る上で有効です。

多くの日本企業では、機密情報を含むデータを海外サーバーへ送信することに慎重です。インテリジェント・ルーティングを活用すれば、個人情報や機密性の高いデータが含まれるリクエストを自動検知し、外部APIではなく、セキュアな環境に構築された「国産LLM」や「オンプレミスの推論サーバー」にルーティングすることが可能になります。一方で、一般的な情報の検索や翻訳などには、性能の高いグローバルなLLMを利用するといった使い分けが、ユーザーに意識させることなく実現できます。

導入に伴うリスクと考慮事項

一方で、こうしたゲートウェイの導入には留意点もあります。第一に、システム構成が複雑になる点です。単一のAPIを叩くのとは異なり、ルーティングロジックの管理や、複数のモデル間で出力品質のばらつきを吸収するためのプロンプトエンジニアリングの調整が必要になります。

また、ベンダーロックインを避けるためにマルチモデル化を進めた結果、ゲートウェイ自体のベンダーに依存してしまう「新たなロックイン」のリスクも考慮すべきです。オープンソースのゲートウェイ・ソリューション(LangChainやLiteLLMなどのエコシステム)の活用も含め、自社のエンジニアリング体制に見合った選定が求められます。

日本企業のAI活用への示唆

最後に、インテリジェント・ルーティングの動向が日本企業の実務に与える示唆を整理します。

1. 「単一モデル依存」からの脱却とBCP対策

特定のAIベンダー1社に依存するリスクは、サービスの安定供給に関わります。複数のモデルを切り替えられるアーキテクチャを早期に導入することは、事業継続計画(BCP)の観点からも推奨されます。

2. コスト対効果のシビアな管理

「何でも最高性能のモデル」を使うフェーズは終わりつつあります。タスクの難易度に応じたモデルの使い分け(Model DistillationやRouting)を実装することで、運用コストを数分の一に圧縮できる可能性があります。

3. AIガバナンスの実装手段としての活用

セキュリティポリシーに基づき、データをどのモデルに渡すかをシステム的に制御する「ゲートキーパー」としてルーティング技術を活用すべきです。これにより、現場の利便性を損なわずに、全社的なコンプライアンスを遵守する体制が構築できます。