YouTubeがGoogleの最新LLMを活用し、クリエイターがプロンプトを通じてゲームを作成できる機能をテストしていることが報じられました。これは単なるエンターテインメントの話題にとどまらず、生成AIの活用領域が「静的なコンテンツ生成」から、ロジックを伴う「アプリケーション生成」へと拡大していることを示唆しています。

動画プラットフォームが踏み込む「対話型体験」の領域

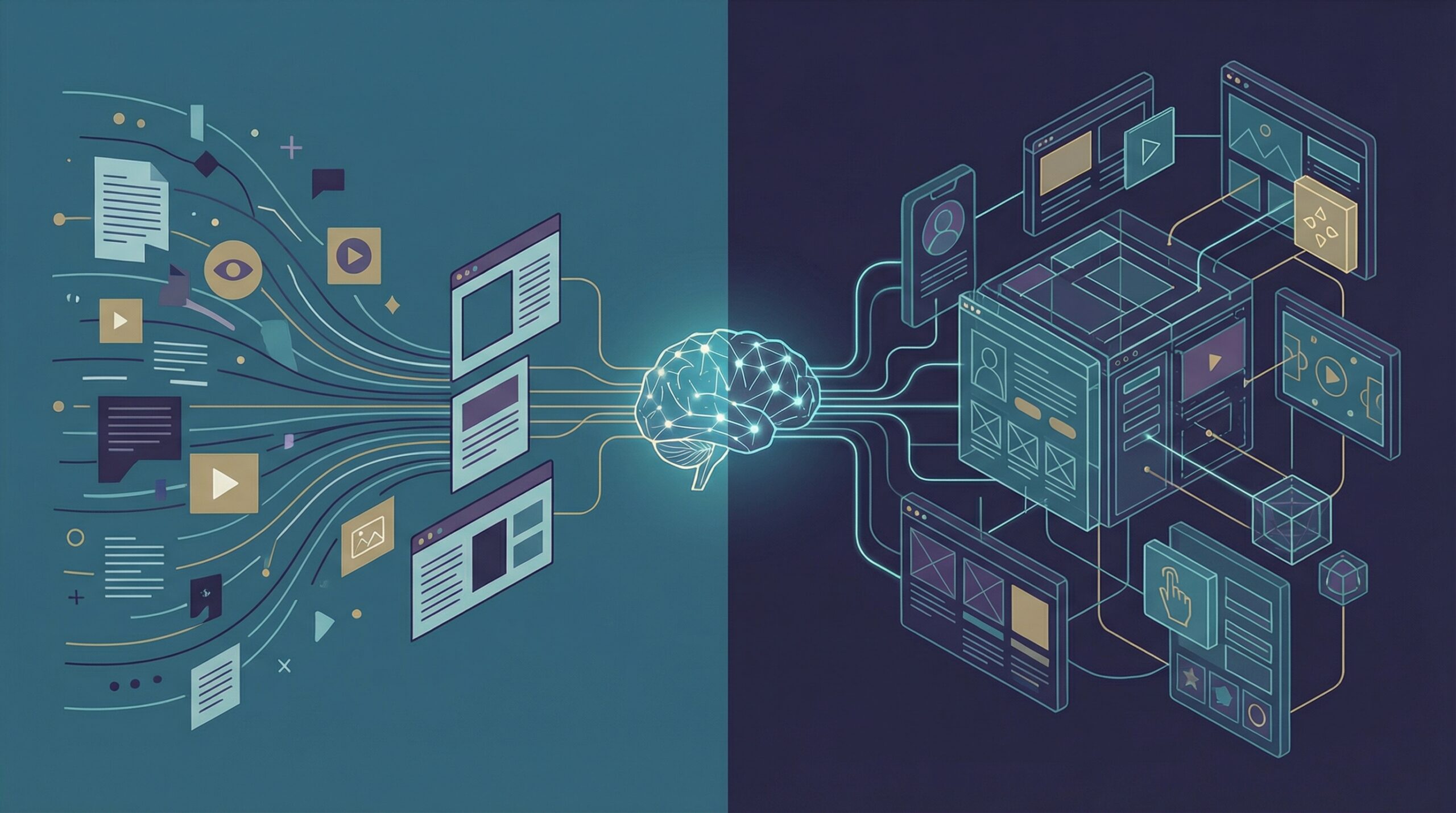

報道によると、YouTubeは一部のクリエイターを対象に、Googleの最新の大規模言語モデル(LLM)を用いてウェブベースのゲームを構築できる機能をテストしています。これまで生成AIといえば、テキスト、画像、動画といった「視聴・閲覧するコンテンツ」の生成が主流でしたが、今回の事例はユーザーの入力に対して応答する「インタラクティブな体験(ゲームやアプリ)」そのものを生成しようとする動きです。

これは技術的には、LLMが自然言語による指示をコードやスクリプトに変換し、即座に実行可能なミニプログラムとして出力していると考えられます。Googleはすでに「Genie」などの研究で、画像やテキストから操作可能な仮想世界を生成する技術を発表していましたが、それをYouTubeという巨大なプラットフォームで実用化に向けた検証を始めた点は注目に値します。

「開発の民主化」と日本企業のチャンス

この技術動向は、日本のビジネス現場においても重要な意味を持ちます。日本企業、特に非IT企業においては、慢性的なITエンジニア不足が課題となっています。もし「自然言語で指示するだけで、簡易的なアプリケーションやシミュレーションが作れる」ようになれば、マーケティング担当者がキャンペーン用のインタラクティブなクイズを作成したり、人事担当者が研修用のロールプレイング・シナリオを構築したりすることが、エンジニアの手を借りずに可能になります。

いわゆる「ノーコード・ローコード」の流れをさらに加速させ、プログラミング知識のない業務担当者が、自らのアイデアを機能的な形に落とし込む「開発の民主化」が、実用レベルで進みつつあると言えるでしょう。

品質保証とガバナンスの課題

一方で、実務への適用を考える際にはリスク管理が不可欠です。LLMによるコード生成やロジック生成には、依然として不確実性が残ります。

- ハルシネーション(もっともらしい嘘)による誤作動:生成されたゲームやアプリが、意図しない挙動や差別的な反応をするリスク。

- セキュリティ脆弱性:生成されたコードにセキュリティホールが含まれている可能性。

- 知的財産権(IP)の問題:既存のキャラクターやゲームシステムに酷似したものが生成された場合の権利関係。

特に日本では、コンプライアンスやブランド棄損に対する意識が高いため、企業がこのような「Text-to-App(テキストからのアプリ生成)」技術を顧客向けサービスに導入する際は、生成物の品質保証(QA)プロセスをどう設計するかが大きな壁となります。

日本企業のAI活用への示唆

今回のYouTubeとGoogleの取り組みは、今後のAI活用の方向性について以下の重要な視点を提供しています。

- 静的コンテンツから動的機能へのシフト:AI活用を記事や画像の作成だけでなく、「簡単な業務ツールや顧客接点ツールの自動生成」まで広げて検討する時期に来ています。

- プロトタイピングの高速化:新規事業開発において、MVP(実用最小限の製品)を作る前の「動くモックアップ」をAIで瞬時に作成し、検証サイクルを回す手法が有効になります。

- ガバナンスの再定義:「誰が作っても一定の品質になる」わけではないため、AIが生成したプログラムの動作検証や、著作権侵害リスクをチェックする体制(Human-in-the-loop)の整備が急務です。

技術の進化は、専門性を不要にするのではなく、専門家に求められるスキルを「実装(コーディング)」から「要件定義(プロンプティングと設計)」へと変化させています。この変化を組織全体で受け入れられるかが、今後の競争力を左右するでしょう。